没有合适的资源?快使用搜索试试~ 我知道了~

CS231n课程笔记翻译:神经网络笔记21

需积分: 0 0 下载量 167 浏览量

2022-08-03

15:47:41

上传

评论

收藏 1.14MB PDF 举报

温馨提示

试读

10页

第一种是先对数据做零中心化(zero-centered)处理,然后每个维度都除以其标准差,实现代码为 X /= 第二种方法是对每个维度都做归一化,使得每个维度的

资源详情

资源评论

资源推荐

CS231n

课

程

笔

记

翻

译

:

神

经网络

笔

记

2

原

文

如

下

内容列表:

设置数据和模型

数据预处理

权重初始化

批量归一化(Batch Normalization)

正则化(L2/L1/Maxnorm/Dropout)

损失函数

小结

设

置

数

据

和

模

型

在上一节中介绍了神经元的模型,它在计算内积后进行非线性激活函数计算,神经网络将这些神经元组织成各个

层。这些做法共同定义了

评

分函

数

(

score function

)

的新形式,该形式是从前面线性分类章节中的简单线性映射

发展而来的。具体来说,神经网络就是进行了一系列的线性映射与非线性激活函数交织的运算。本节将讨论更多的

算法设计选项,比如数据预处理,权重初始化和损失函数。

数

据

预

处

理

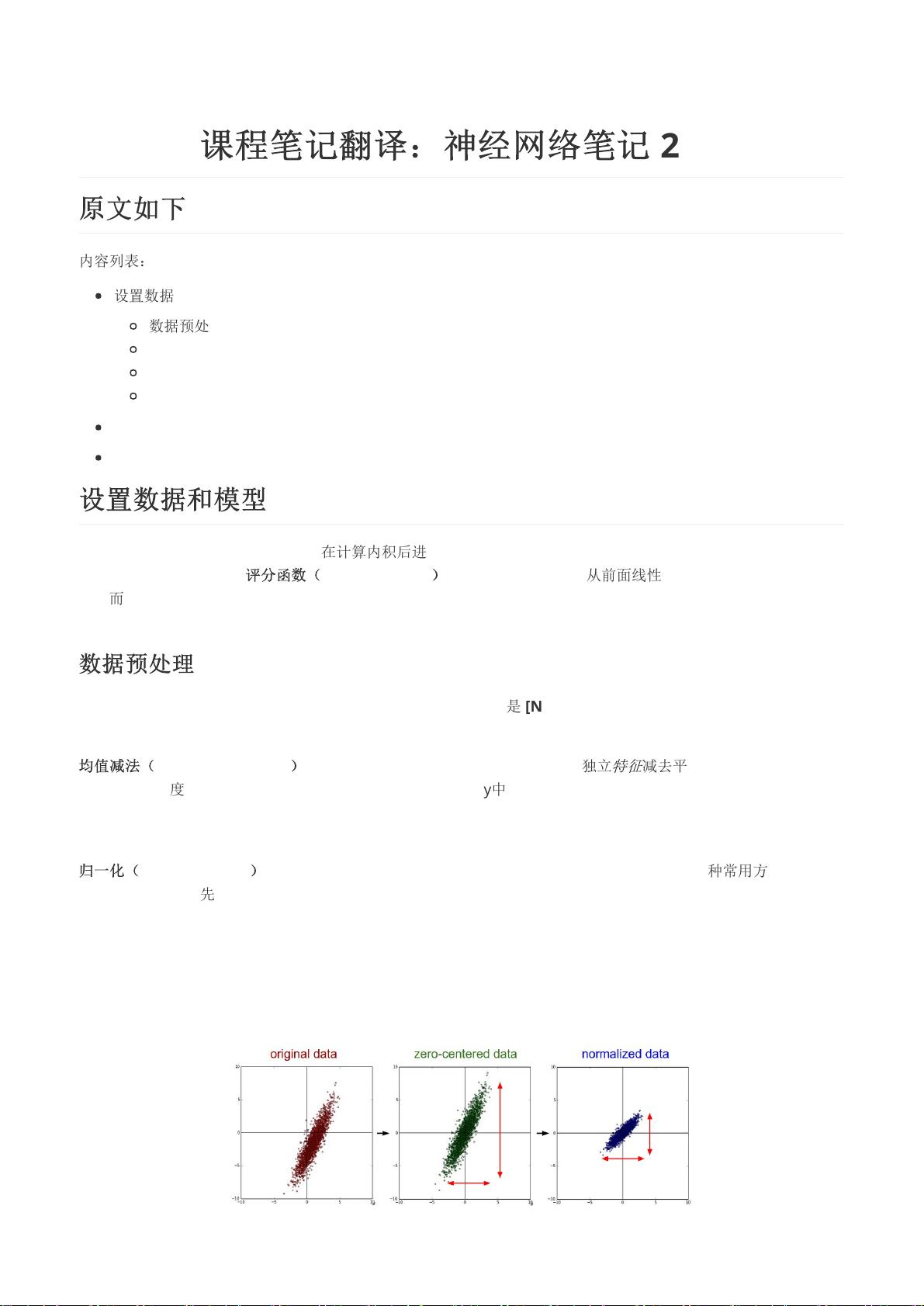

关于数据预处理我们有3个常用的符号,数据矩阵X,假设其尺寸是 [N x D] (N 是数据样本的数量,D 是数据的维

度)。

均

值

减

法

(

Mean subtraction

)

是预处理最常用的形式。它对数据中每个独立

特

征

减去平均值,从几何上可以理

解为在每个维度上都将数据云的中心都迁移到原点。在numpy中,该操作可以通过代码 X -= np.mean(X, axis=0)

实现。而对于图像,更常用的是对所有像素都减去一个值,可以用 X -= np.mean(X) 实现,也可以在3个颜色通道

上分别操作。

归

一

化

(

Normalization

)

是指将数据的所有维度都归一化,使其数值范围都近似相等。有两种常用方法可以实现

归一化。第一种是先对数据做零中心化(zero-centered)处理,然后每个维度都除以其标准差,实现代码为 X /=

np.std(X, axis=0) 。第二种方法是对每个维度都做归一化,使得每个维度的最大和最小值是1和-1。这个预处理操

作只有在确信不同的输入特征有不同的数值范围(或计量单位)时才有意义,但要注意预处理操作的重要性几乎等

同于学习算法本身。在图像处理中,由于像素的数值范围几乎是一致的(都在0-255之间),所以进行这个额外的

预处理步骤并不是很必要。

——————————————————————————————————————————

Orca是只鲸

- 粉丝: 24

- 资源: 317

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0