没有合适的资源?快使用搜索试试~ 我知道了~

资源详情

资源评论

资源推荐

联邦学习隐私保护机制综述

摘要:随着数据孤岛的出现和隐私意识的增强,传统的中心化的机器学习模式遇到了

一系列挑战。联邦学习作为一种新兴的隐私保护的分布式机器学习模型迅速成为一个热门

的研究问题。有研究表明,机器学习模型的梯度会泄露用户数据集的隐私,能够被攻击者

利用以获取非法的利益,因此,需要采用一些隐私保护的机制来保护这种敏感信息。研究

了当前联邦学习系统中采用的隐私保护机制,并根据研究者们采用的隐私保护技术,将联

邦学习中的隐私保护机制主要分为了五类,总结了不同的隐私保护机制的研究思路和研究

进展。通过对当前联邦学习中使用的隐私保护机制的研究,联邦学习系统的设计人员提高

联邦学习系统的安全性,更好的保护数据隐私。

关键词:联邦学习;隐私保护;

Abstract:With the emergence of data islands and the enhancement of privacy awareness,

the traditional centralized machine learning model has encountered a series of challenges.

Federated learning, as a privacy-protected distributed machine learning model, has quickly

become a hot research topic. Studies have shown that the gradient of the machine learning model

will leak the privacy of user data sets and can be used by attackers to obtain illegal benefits.

Therefore, some privacy protection mechanisms are needed to protect this sensitive information.

We studies the privacy protection mechanisms used in the current federal learning system, and

according to the privacy protection technology adopted by the researchers, divides the privacy

protection mechanisms in the federal learning into five categories, and summarizes the ideas of

different privacy protection mechanisms. We want to introduce the current privacy protection

mechanisms used in federated learning to enable designers of federated systems to improve the

security of federated learning systems and protect data privacy.

Keywords:Federated Learning;privacy protection

引言

近年来,机器学习算法在人工智能领

域内迅猛发展,在计算机视觉、自然语言

处理和推荐算法等领域都有良好的表现。这

些机器学习技术的成功,都是通过大量数据

的训练得到的,然而,一方面,随着人工智

能在各个行业的不断落地,人们对于数据安

全和隐私保护的程度也在不断提高,用户开

始更加关注他们的隐私数据是否未经许可,

便被他人处于商业目的而使用。另一方面,

在法律层面,法律制定者和监管机构也出台

了新的法律来规范数据的管理和使用,典型

的例子有中国 2017 年开始实施的《中华人

民共和国网络安全法》和 2018 年欧盟开始

执行的《通用数据保护条例》(General Data

Protection Regulation,GDPR),这些法律的

实施进一步加剧了在不同组织之间收集和分

享数据的困难。因此,各方面原因导致在许

多应用领域,满足机器学习规模的数据量是

难以达到的,人们不得不面对难以桥接的数

据孤岛。

为了解决上述数据孤岛问题,一种可行

的方案是谷歌的 McMahan 等人于 2016 年

提出的联邦学习(Federated Learning)

[1]

。

联邦学习是多个实体(客户端)协作解决机

器学习数据孤岛问题的一种方案,它在一个

中央服务器或服务提供商的协调下进行,每

个客户端的原始数据存储在本地,无法交换

或迁移,满足了隐私保护和数据安全的要

求。谷歌的联邦学习系统能够通过智能手机

的私人数据来更新其 Gboard 系统(一种虚

拟键盘系统)的输入预测模型,所有使用

Gboard 的智能手机的数据都可以被用来优

化模型,而这一过程并不需要将用户的隐私

数据从智能手机发送到中央设备。

本文主要就联邦学习中的隐私保护机制

进行了调查和研究,从隐私保护技术的角度

对当前的研究联邦学习中的隐私保护的文献

进行了分类,目前联邦学习中主要采用隐私

保护技术有差分隐私、同态加密和安全多方

计算,部分文献也混合使用了上述隐私保护

技术的两种或三种,也有部分文献使用了其

它隐私保护技术。

本文的的主要内容如下:

第 1 节介绍了当前联邦学习面临的主要

隐私保护问题,隐私需求部分解释了为什么

需要保护联邦学习中的梯度,威胁模型部分

主要介绍了联邦学习系统面临的隐私和安全

攻击手段。

第 2 节主要介绍了现有的隐私保护及技

术,主要有差分隐私、同态加密和安全多方

计算三种。

第 3 节对现有联邦学习中隐私保护技术

的研究进行了分类并且介绍了隐私保护技术

的基本原理和研究现状,将主要从差分隐

私、同态加密、安全多方计算、混合模式和

其它方法,一共五个方面进行介绍。

第 4 节将总结本文的工作和未来联邦学

习隐私保护问题的研究方向。

1 联邦学习的隐私保护问题

1.1 隐私需求

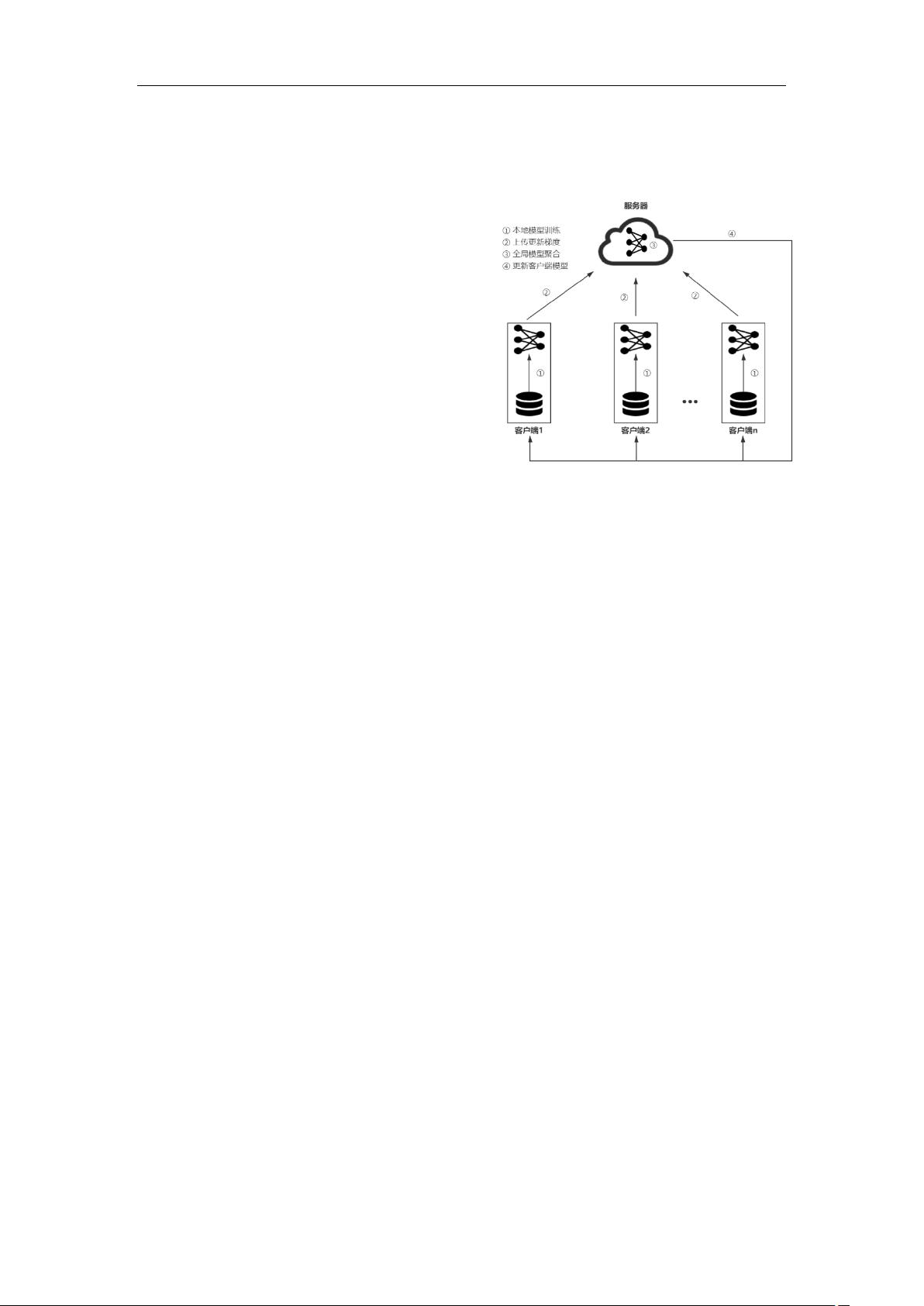

Fig.1 Client-Server Architecture

图 1 客户端-服务器架构

谷歌提出了一种基于客户端-服务器架

构的典型的横向联邦学习过程,参与训练的

移动设备数据具有类似的数据特征,但是每

个移动设备的数据量是不同的,如图 1 所

示。每个移动设备可以视作一个客户端,然

后引入一个半诚实的服务器来帮助完成联邦

训练的过程。在这种联邦学习架构中,客户

端拥有用来被训练的数据,所有的客户端都

将参与全局模型的训练,并且可以一起享用

联合训练完成的全局模型;服务器作为中心

服务器进行模型参数的聚合。

如图 1 所示,客户端-服务器的联邦学

习过程如下:客户端使用本地数据和收到的

初始化模型进行模型训练,得到更新的模型

梯度;客户端将模型梯度上传到聚合服务

器;服务器进行模型聚合,可以以客户端数

据集大小为权重进行模型平均;服务器将新

的模型参数下发给客户端,客户端更新本地

模型。

在客户端-服务器的联邦学习的联邦学

习过程中,用户数据没有离开用户的设备,

数据隐私得到了一定程度的保护,但是,

Zhu 等人的研究结果表明分享梯度会泄露隐

私数据

[2]

,服务端能够根据客户端上传的梯

度恢复出客户端的训练数据。因此,在联邦

学习过程中,客户端向服务器分享本地模型

的更新梯度存在敏感数据泄露的隐患。联邦

学习将需要传输的训练数据转化为了训练后

得到的梯度,需要进行隐私保护的敏感数据

也随之变成了梯度,客户端需要使用隐私保

护技术对梯度进行保护,可以使用的技术

有:同态加密、安全多方计算和差分隐私

等。

1.2 威胁模型

联邦学习不可能总是提供足够的隐私保

证,也会遭受潜在的隐私攻击,危及模型和

数据的完整性。Lyu L 等人

[3]

详细的介绍和

总结了联邦学习面对的威胁和攻击。

在联邦学习的威胁模型中,通常会受到

来自内部或外部的攻击,其中内部攻击往往

比外部攻击要强。对于联邦学习的内部攻

击,可以采取单一攻击,拜占庭攻击和女巫

攻击。

根据主动性可以将对手分为半诚实的对

手和恶意的对手,半诚实的对手被认为是诚

实但好奇的,在不违背联邦学习协议的情况

下试图了解其他方的私密状态;而一个活跃

或恶意的对手可以通过修改、重放或删除消

息来随意违背联邦学习协议,还可以进行毁

灭性的攻击。

联邦学习可以分为训练和推理两个阶

段,所以每个阶段受到的攻击也不同。训练

阶段的攻击企图学习、影响和破坏模型本

身,对手可以用数据投毒攻击和模型投毒攻

击,还可以对参与者的更新发动一系列推理

攻击。推理阶段的攻击通常不会篡改目标模

型,只会导致模型产生错误的输出,或收集

关于模型特征的证据。

投毒攻击主要有本地数据采集时的数据

投毒攻击和在局部模型训练过程中的模型投

毒攻击。数据投毒可以分为 clean-label 和

dirty-label 攻击,clean-label 攻击假设对手

无法改变任何训练数据的标签;相比 dirty-

label 攻击中,对手可以将一些它希望用所

需目标标签误分类的数据样本引入到训练集

中。dirty-label 投毒攻击的常见方式是标签

翻转攻击和后面攻击。模型投毒攻击的目标

是在将本地模型更新发送到服务器之前进行

投毒,或者在全局模型中插入隐藏的后门。

推理攻击则可以分为成员推理攻击和属

性推理攻击。成员推理攻击的目的是确定某

一数据点是否被用于训练模型,而属性推理

攻击的用来推断其他参与者的训练数据的属

性。

2 隐私保护技术

2.1 差分隐私

差分隐私是由 Dwork 等人

[4]

在 2006 年

首次提出的,它提供了量化和限制个人信息

泄露的一种输出隐私保护模型。差分隐私的

中心思想是,当攻击者试图从数据集中查询

个体信息时将其混淆,使得敌手无法从查询

结果中辨别个体的敏感性,即函数的输出结

果对于数据集中的任何特定记录都不敏感,

因此,差分隐私能被用来抵抗成员推理攻

击。

定义 1 (

(

𝜖

,

𝛿

)

―

差分隐私) 一个随

机化机制

𝓜

,其定义域为

ℕ

|𝓧|

,如果

𝓜

满

足

(

ϵ,δ

)

―

差分隐私,那么对于任意的输出

集合

𝑺

⊆

Range

(

𝓜

)

和两个最多只有一个元

素不同的相邻数据集

𝒙

和

𝒙

′

,有:

𝑃

𝑟

[

𝓜

(

𝒙

)

∈

𝑺

]

≤

𝑒

𝜀

𝑃

𝑟

𝓜

(

𝒙

′

)

∈

𝑺

+

𝛿 #

#

#

(

1

)

(1)式中,

𝜖

表示隐私预算;

𝛿

表示失败

概率。一般而言,

𝜖

越小,隐私保护程度越

高,噪声越大,数据可用性越差。

差分隐私的主要实现方式是向数据添加

噪声,主要有两种方式,一种是根据数值型

的输出函数的敏感度添加噪声,比如基于

𝑙

1

―

敏感度的拉普拉斯噪声(Laplace Noise)

和

𝑙

2

―

敏感度高斯噪声(Gaussian Noise);

另一种是根据离散值的指数分布选择噪声。

剩余24页未读,继续阅读

黄涵奕

- 粉丝: 72

- 资源: 328

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 微信小程序 - 同乐居商城:购物车合算源码

- 1、根据输入的三条边值判断能组成何种三角形,并设计测试数据进行判定覆盖测试 三条边为变量a、b、c,范围为1≤边值≤10,不在范

- SQL server 练习题目8道(小白教学).zip

- Python 手写实现 iD3 决策树算法-根据信息增益公式.zip

- 411675952289057车联助手-小窗版(三星)3.5.1.apk

- 三种快速排序方法合并在一个文件中以便直接运行的Python代码示例

- 937712277954201实习5.word

- 2程序语言基础知识pdf1_1716337722703.jpeg

- 简单的Python示例,演示了如何使用TCP/IP协议进行基本的客户端和服务器通信

- 考试.sql

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0