没有合适的资源?快使用搜索试试~ 我知道了~

L0、L1与L2范数_理解1

需积分: 0 0 下载量 79 浏览量

2022-08-03

12:53:51

上传

评论

收藏 1.13MB PDF 举报

温馨提示

试读

5页

1. 『TensorFlow』模型载入方法汇总 2. 『TensorFlow』迁移学习(6082) 5. 『cs231n』卷积神经网络的可视化 1. 『Tens

资源推荐

资源详情

资源评论

2018/7/18 『科学计算』L0、L1与L2范数_理解 - 叠加态的猫 - 博客园

https://www.cnblogs.com/hellcat/p/7979711.html 1/5

博客园 首页 新随笔 联系 管理 订阅 随笔- 301 文章- 7 评论- 64

『科学计算』L0、L1与L2范数_理解

目录

一、L0范数、L1范数、参数稀疏

二、L1范数、L2范数

三、先验知识角度理解L1和L2正则化与参数稀疏

四、数值计算角度理解L1和L2正则化与参数稀疏

『教程』L0、L1与L2范数

回到顶部

一、L0范数、L1范数、参数稀疏

L0范数是指向量中非0的元素的个数。如果我们用L0范数来规则化一个参数矩阵W的话,就是希望W的大部分元素

都是0,换句话说,让参数W是稀疏的。

既然L0可以实现稀疏,为什么不用L0,而要用L1呢?一是因为L0范数很难优化求解(NP难问题),二是L1范数是

L0范数的最优凸近似,而且它比L0范数要容易优化求解。所以大家才把目光和万千宠爱转于L1范数。

总结:L1范数和L0范数可以实现稀疏,L1因具有比L0更好的优化求解特性而被广泛应用。

参数稀疏的优点,

1)特征选择(Feature Selection):

大家对稀疏规则化趋之若鹜的一个关键原因在于它能实现特征的自动选择。一般来说,x

i

的大部分元素(也就是特

征)都是和最终的输出y

i

没有关系或者不提供任何信息的,在最小化目标函数的时候考虑x

i

这些额外的特征,虽然可以

获得更小的训练误差,但在预测新的样本时,这些没用的信息反而会被考虑,从而干扰了对正确y

i

的预测。稀疏规则化

算子的引入就是为了完成特征自动选择的光荣使命,它会学习地去掉这些没有信息的特征,也就是把这些特征对应的权

重置为0。

2)可解释性(Interpretability):

另一个青睐于稀疏的理由是,模型更容易解释。例如患某种病的概率是y,然后我们收集到的数据x是1000维的,也

就是我们需要寻找这1000种因素到底是怎么影响患上这种病的概率的。假设我们这个是个回归模型:y=w

1

*x

1

+w

2

*x

2

+

…+w

1000

*x

1000

+b(当然了,为了让y限定在[0,1]的范围,一般还得加个Logistic函数)。通过学习,如果最后学习到的

w*就只有很少的非零元素,例如只有5个非零的w

i

,那么我们就有理由相信,这些对应的特征在患病分析上面提供的信

息是巨大的,决策性的。也就是说,患不患这种病只和这5个因素有关,那医生就好分析多了。但如果1000个w

i

都非0,

医生不得不面对这1000种因素。

回到顶部

二、L1范数、L2范数

L2范数的规则项||W||

2

最小,可以使得W的每个元素都很小,都接近于0,但与L1范数不同,它不会让它等于0,而

是接近于0。

L2范数的好处如下,

Github地址

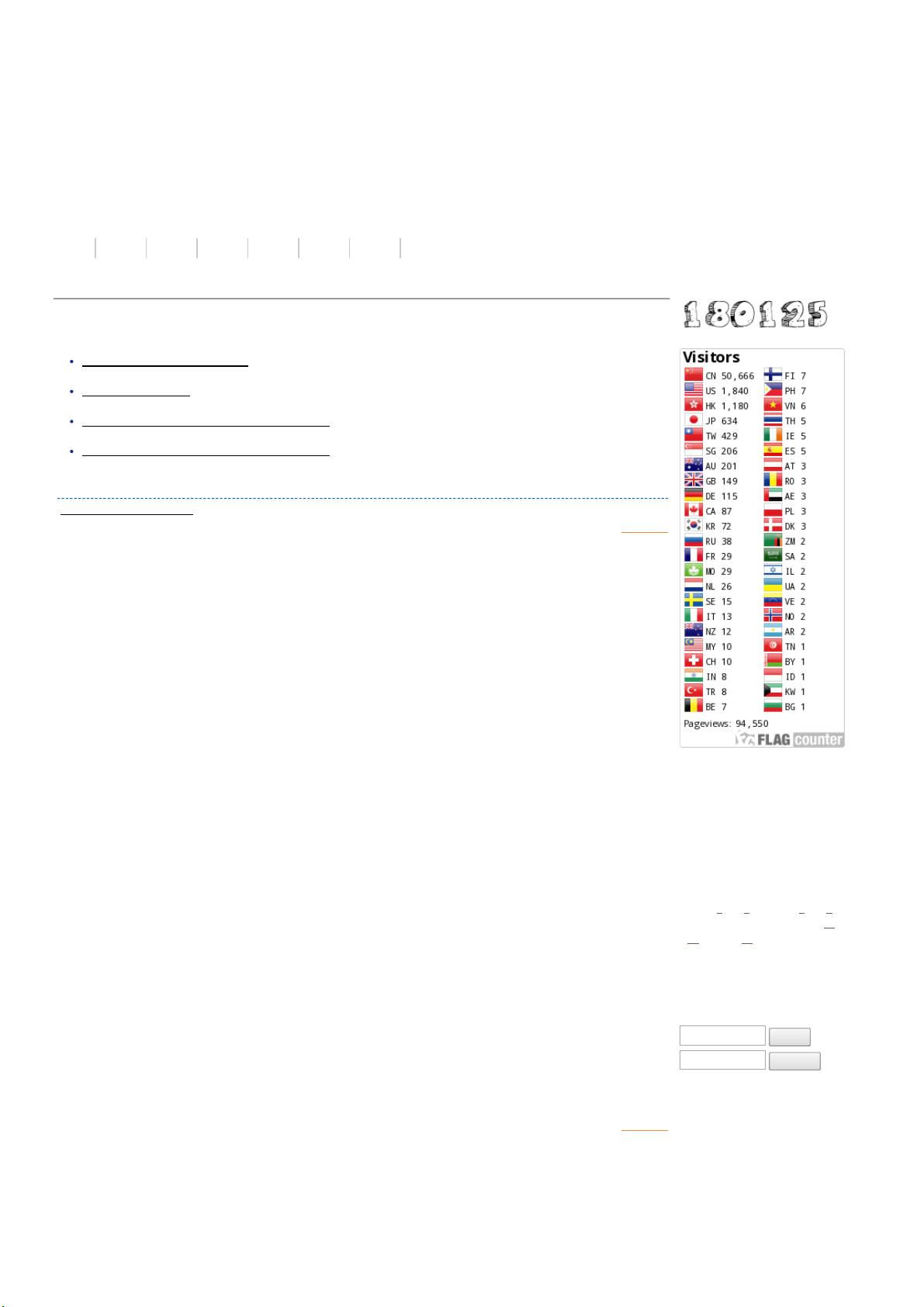

总访问量(17.05.08起):

访问信息(18.04.13起):

昵称:叠加态的猫

园龄:1年2个月

粉丝:97

关注:7

+加关注

< 2018年7月 >

日 一 二 三 四 五 六

24 25 26 27 28 29 30

1 2 3 4 5 6 7

8 9 10 11 12 13 14

15 16 17 18 19 20 21

22 23 24 25 26 27 28

29 30 31 1 2 3 4

搜索

找找看

谷歌搜索

常用链接

我的随笔

我的评论

我的参与

最新评论

我的标签

更多链接

叠加态的猫

索引资源请进标签列表

资源评论

坑货两只

- 粉丝: 64

- 资源: 290

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功