没有合适的资源?快使用搜索试试~ 我知道了~

28、值函数近似法1

需积分: 0 0 下载量 196 浏览量

2022-08-04

00:26:14

上传

评论

收藏 1.15MB PDF 举报

温馨提示

试读

12页

1. 使用 2. 将产生的转移数据 3. 从经验池 4. 根据旧的,并且固定的参数 5. 优化Q-network和Q函数目标值之间的目标函数MSE: 6. 使用

资源详情

资源评论

资源推荐

强化学习基础篇(二十八)值函数近似法

(Value Function Approximation)

在大规模的强化学习任务求解中,精确获得状态值或动作值 较为困难。而值函数近似法通过寻找状态

值或动作值 的近似替代函数 或 的方式来求解大规模强化学习任务,既避免了表格求解

法所需大规模存储空间的问题,又提升了求解效率,是实际求解任务中被泛采纳的一种算法。

1、大规模强化学习

强化学习是可以去解决很多非常大型的问题的,比如像Backgammon游戏中有着 个状态,在围棋游

戏中有着 个状态,此外一些连续状态空间的环境也有着无数的状态。

那么如何把model-free方法中的预测与控制的算法应用在这些大规模强化学习任务之中呢?

这就需要使用值函数近似法,在之前我们所介绍的算法都是基于表格查找,也就是每一个状态 在

的表格中都有相应的条目索引,或者说每个state-action对 在 的表格中都有相应的条目索

引。

但是表格型的表述方法在大型的MDP问题中有着致命性的问题:

一是,存储这些大量的状态或者动作信息将会耗费海量的内存

二是,去单独学习每个状态的价值非常得慢。

所以,对于大型的MDP问题,我们只能使用函数去近似价值函数:

使用这种近似价值方法一方面可以将价值函数的近似从可见状态泛化到不可见状态,另一方面我们可以

使用MC或TD学习的方法更新参数 。

2、函数近似的模式

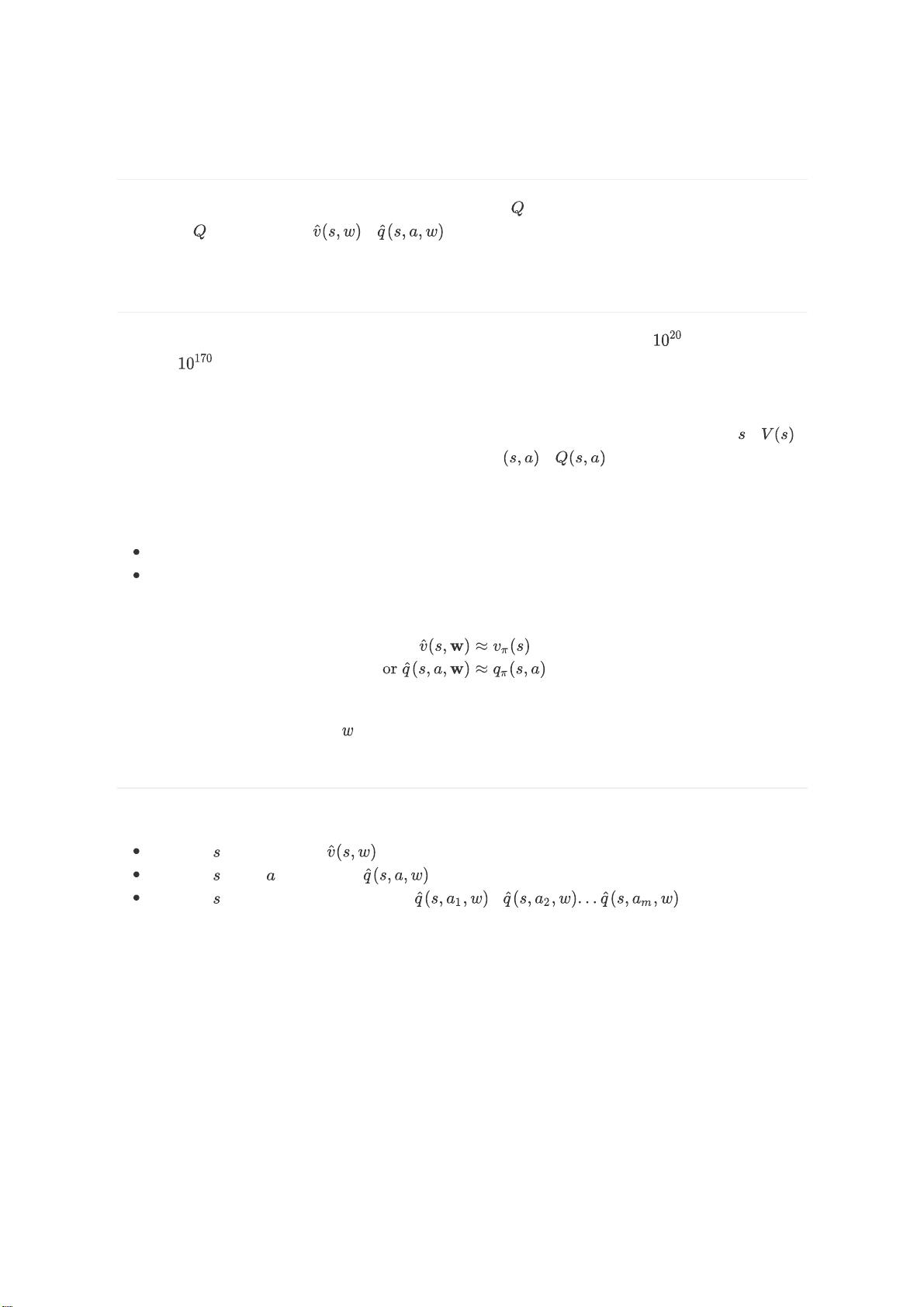

价值函数的近似可以有三种主要的方式:

输入状态 ,输出价值函数

输入状态 与动作 ,输出Q函数 .

输入状态 ,输出所有可能动作的Q函数

,

近似函数可以有很多的选择,比如线性函数,神经网络,决策树,最近邻算法,傅里叶基,小波变化等

等。我们主要会集中于可微分的近似函数,比如线性函数和神经网络。

强化学习应用的场景其数据通常是非静态(non-stationary)、非独立同分布(non-iid)的,因为下一

个状态通常与前一个状态高度相关。因此,函数近似器也需要适用于非静态、非独立同分布的数据

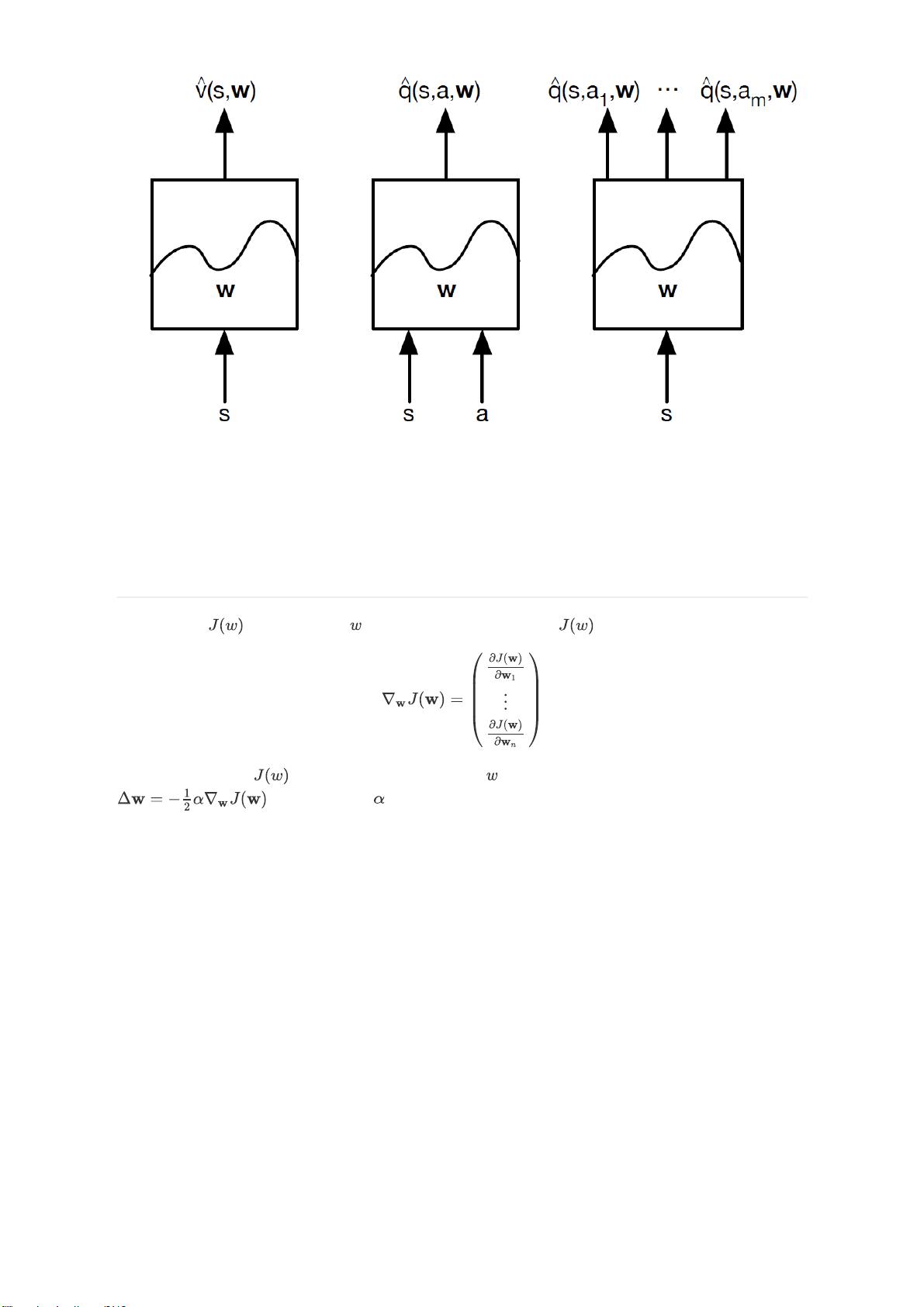

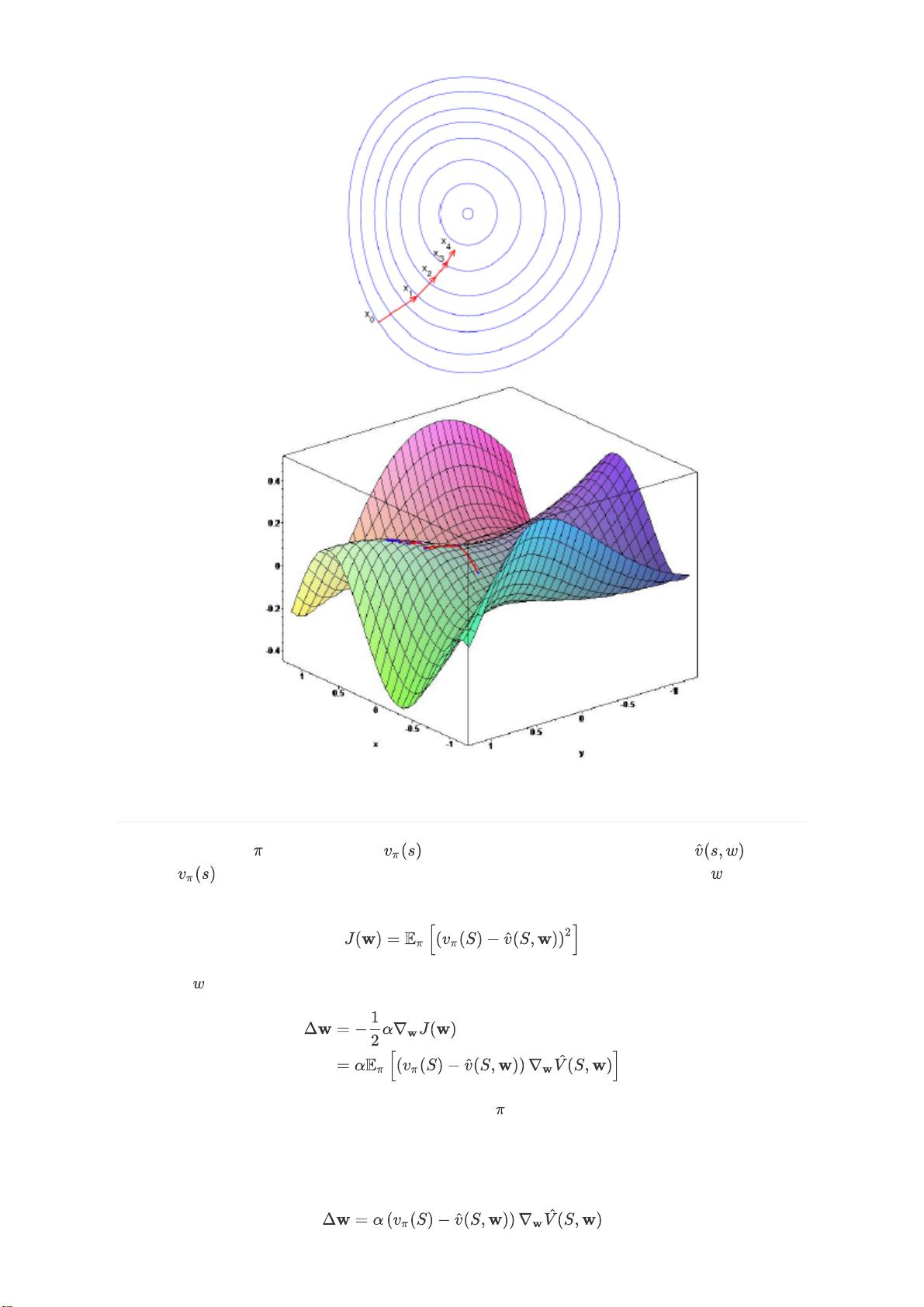

3、梯度下降(Gradient Descent)

如果目标函数 是一个关于参数 的可微分函数,那么目标函数 的梯度就是:

为了去找到目标函数 的最小值,我们只需要将参数 想着梯度的反方向进行调整。

,这里的超参数 是学习率。

梯度下降的可视化就可以看成沿着图形最陡峭的方向进行参数调整:

剩余11页未读,继续阅读

ai

- 粉丝: 62

- 资源: 315

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0