34_ID3_C4.5_CART算法总结与对比1

需积分: 0 65 浏览量

更新于2022-08-03

收藏 595KB PDF 举报

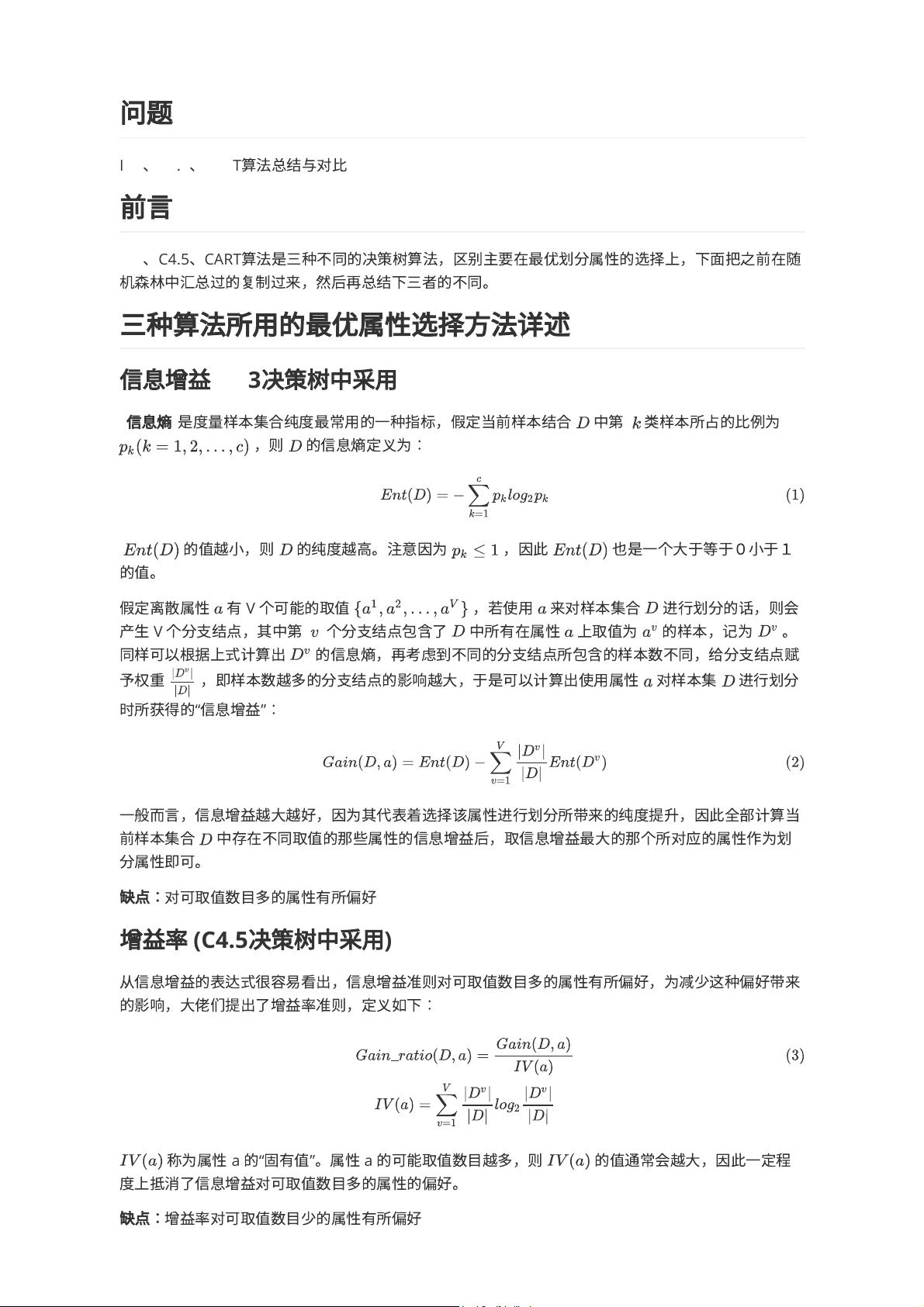

决策树是一种广泛应用于数据挖掘和机器学习的非线性模型,它通过构建树状结构来做出预测或决策。本文将对比分析三种常见的决策树算法:ID3、C4.5和CART,主要关注它们在最优划分属性选择方法上的差异。

ID3(Iterative Dichotomiser 3)算法是最原始的决策树算法之一,它基于信息增益来选择最优划分属性。信息增益是通过计算信息熵来度量样本集合的纯度,熵值越小,表示集合的纯度越高。信息增益越大,意味着选择该属性进行划分能带来更大的纯度提升。然而,ID3算法的一个缺点是它倾向于选择具有更多取值的属性,因为这些属性通常能提供更大的信息增益。

C4.5是对ID3的改进版本,它引入了增益率的概念来解决ID3对多取值属性的偏好。增益率是信息增益除以属性的固有值,从而降低了对大量取值属性的偏爱。C4.5在选择划分属性时,首先选择信息增益高于平均值的属性,然后在这些属性中选取增益率最高的。C4.5还能处理连续值特征,通过二分法将其转换为离散值。

CART(Classification and Regression Trees)算法则采用基尼指数作为划分标准,基尼指数衡量的是从数据集中随机抽取两个样本,它们类别标记不一致的概率,基尼指数越小,纯度越高。CART构建的是二叉树,每个非叶节点都有两个子节点,这使得它能处理分类和回归任务。对于连续值特征,CART的处理方式与C4.5相同,通过寻找最佳划分点来分割数据。

总结三种算法的特点:

1. ID3:使用信息增益,可能导致偏好多取值属性,分支可以多分支。

2. C4.5:使用增益率,处理连续值特征,但可能对少取值属性有偏好,分支也可多分支。

3. CART:使用基尼系数,构建二叉树,既能处理分类也能处理回归,之前的属性仍可参与后续节点构建。

在实际应用中,选择哪种算法取决于数据的特性以及任务的需求。例如,如果数据中存在大量连续值特征,C4.5和CART可能是更好的选择。而如果担心多取值属性的偏好问题,C4.5的增益率准则可能更合适。理解和掌握这三种算法的差异,有助于在实际项目中选择最适合的决策树模型。