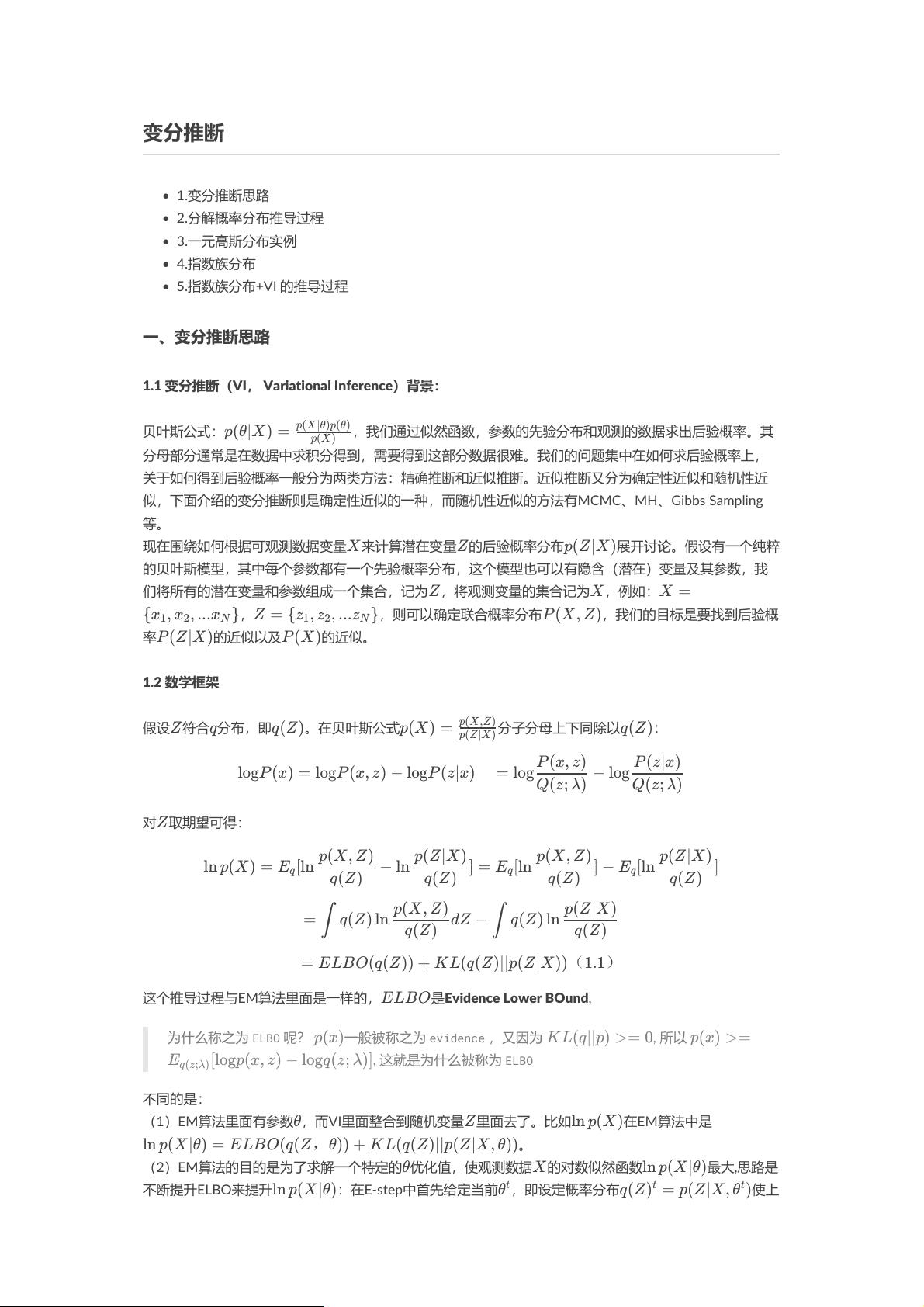

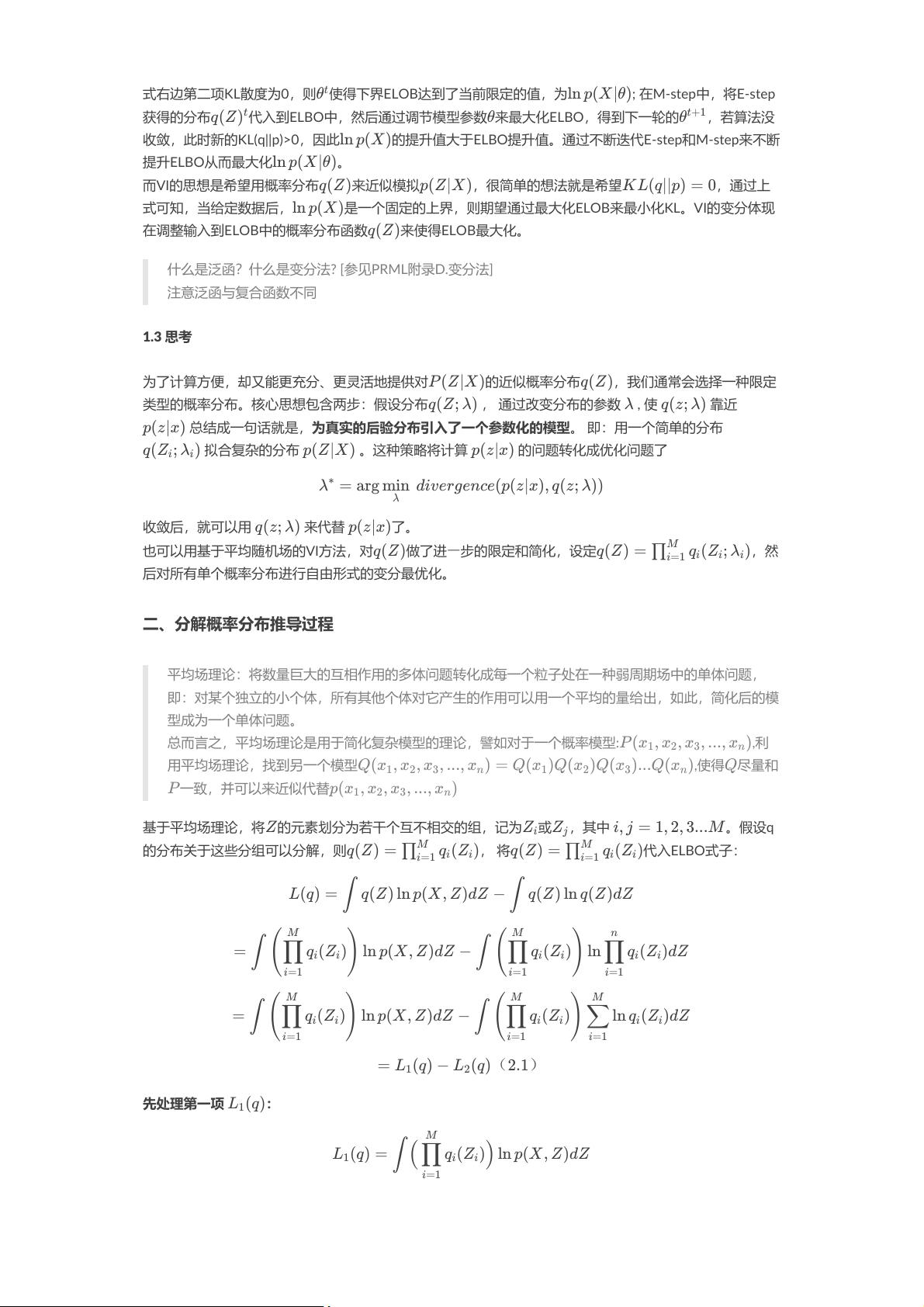

变分推断(Variational Inference,VI)是一种在机器学习和统计学中用于近似复杂概率分布的数学方法,特别是在贝叶斯统计中。贝叶斯公式是推断的基础,它表示了通过观测数据、先验知识和似然函数来求解后验概率。然而,由于分母通常涉及对整个数据空间的积分,这在实际操作中往往是难以计算的。为了解决这个问题,我们采用近似推断,其中变分推断是确定性近似的一个分支。 在变分推断中,我们不直接求解后验概率,而是寻找一个易于处理的概率分布族,称为变分分布,来近似后验概率。例如,我们可能会选择一个一元高斯分布或指数族分布作为变分分布。目标是通过调整变分分布的参数,使得它尽可能接近真实的后验分布。这可以通过最大化证据下界(ELBO)来实现,它是观测数据对数似然函数的一个下界,同时也等于KL散度的负值。 数学框架中,变分推断的关键步骤包括将目标分布与变分分布进行比较。在贝叶斯公式中,我们用变分分布q(Z)替换掉后验概率p(Z|X),然后通过对变分分布取期望来近似期望值。这导致了ELBO的定义,即ELBO(q(Z)) = E_q[ln p(X, Z)] - E_q[ln q(Z)],其中第一项是数据的对数似然,第二项是变分分布的负熵。通过最大化ELBO,我们可以同时最小化KL散度,从而使得变分分布q(Z)尽可能接近后验分布p(Z|X)。 与EM算法相比,变分推断的不同之处在于它不直接寻找参数的最大似然估计,而是调整变分分布的参数以提高ELBO。在EM算法中,E-step和M-step交替进行,而在变分推断中,我们直接优化变分分布,使其逼近后验概率。这种方法将原本的积分问题转化为优化问题,使得计算更为可行。 在实际应用中,为了简化计算并保持灵活性,我们通常选择特定形式的变分分布,如高斯分布或指数族分布。这被称为平均场理论,它将复杂的联合分布分解为多个相互独立的部分,然后对每个部分分别进行优化。这样,我们可以逐个处理每个变量,而不是一次性处理所有变量,大大降低了计算复杂性。 总结来说,变分推断是一种通过近似后验概率分布来解决贝叶斯推断问题的策略,它利用优化技术来调整变分分布,以最大化证据下界。这种方法在处理大规模数据和复杂模型时具有优势,因为它将原本困难的积分问题转换为更容易管理的优化问题。

剩余9页未读,继续阅读

- 粉丝: 41

- 资源: 306

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功