没有合适的资源?快使用搜索试试~ 我知道了~

资源详情

资源评论

资源推荐

GAT原理与简易教程

【参考文献】

Understanding Graph Attention Networks (GAT)

向往的GAT(图注意力模型)

1. GCN的局限

1.1 Graph数据的特征

当我们说起graph或者network的数据结构,通常是包含着顶点和边的关系。研究目标聚焦在顶点之上,边诉说着顶点之间的关系。

对于任意一个顶点 ,它在图上邻居 ,构成第一种特征,即图的结构关系。

当然,除了图的结构之外,每个顶点还有自己的特征 (通常是一个高维向量)。它可以是社交网络中每个用户的个体属性;可以

是生物网络中,每个蛋白质的性质;还可以是交通路网中,每个交叉口的车流量。

graph上的deep learning方法无外乎就是希望学习上面的两种特征。

1.2 GCN的不足

GCN是处理transductive任务的一把利器(transductive任务是指:训练阶段与测试阶段都基于同样的图结构),然而GCN有两大

局限性是经常被诟病的:

(a)无法完成inductive任务,即处理动态图问题。inductive任务是指:训练阶段与测试阶段需要处理的graph不同。通常是训练

阶段只是在子图(subgraph)上进行,测试阶段需要处理未知的顶点。(unseen node)

这是因为GCN是 structure-dependent的,参数的学习与邻接矩阵(拉普拉斯矩阵)直接相关。当有新的节点加入,图的结构发

生变化,参数就得重新学习。

(b)处理有向图的瓶颈,不容易实现分配不同的学习权重给不同的neighbor(对于同一阶的不同邻居,使用的都是相同的权重,

参考https://zhuanlan.zhihu.com/p/72373094)。

同时因为有向图的拉普拉斯矩阵是非对称矩阵,原来的特征值分解不再适用,因此频域变换理论上无法再像原来一样实现。

关于GCN学习权重的补充说明:

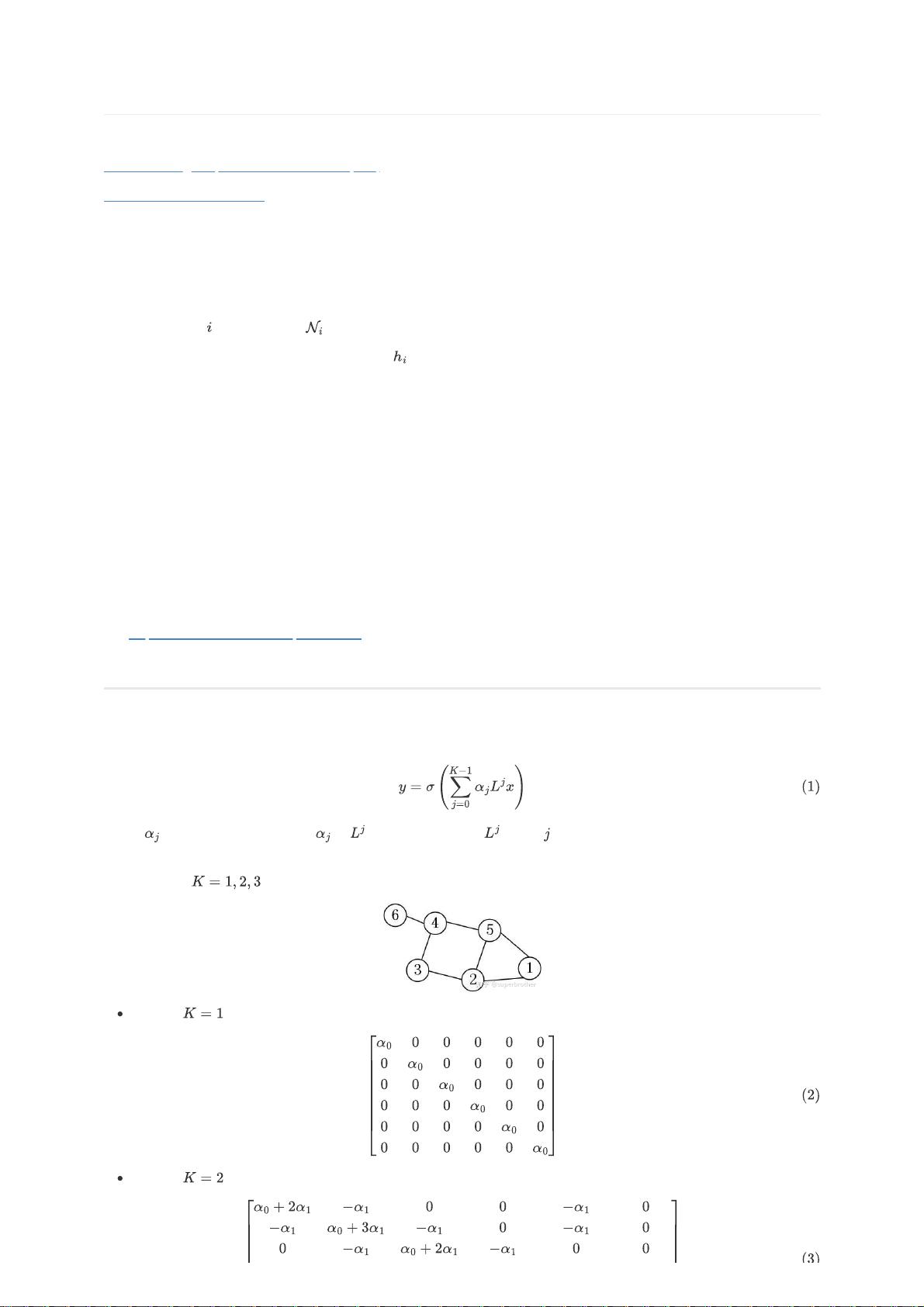

以多项式核的GCN为例:

很明显 是可学习的参数,可以看到 与 保持一致,我们知道 对应着 阶neighbor,这意味着在同阶的邻居上参数共享

(可以学习的参数相同),不同阶的邻居上参数不共享(可以学习的参数不同)。

以下图为例,取 的卷积核:

卷积核( )

卷积核( )

練心

- 粉丝: 25

- 资源: 305

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0