没有合适的资源?快使用搜索试试~ 我知道了~

上机4 17061833+於文卓+聚类1

需积分: 0 0 下载量 32 浏览量

2022-08-08

19:10:29

上传

评论

收藏 560KB DOCX 举报

温馨提示

试读

11页

二、实验原理1、常用的聚类算法:K-Means、K-Mediods、凝聚层次聚类和 DBSCAN算法等 四、实验步骤实验1:实验要求(2)代码1.导入相关函数库

资源详情

资源评论

资源推荐

杭州电子科技大学计算机学院

数据仓库与数据挖掘

实验 4:聚类

时间:2019 年 12 月 9 日,学号:17061833 姓名:於文卓

注意:

1)实验开始前,填写学号和姓名。

2)将文件名由“聚类”更改为“学号+姓名+聚类”。

3)作业做完后,验收之后通过作业提交系统提交。提交网址是:

https://www.wjx.top/jq/29028688.aspx

一、实验目的

1、理解聚类的一般过程和基本原理;

2、巩固聚类算法的算法思想,能够进行聚类操作;

3、学会聚类中的性能评估方法。

二、实验原理

1、常用的聚类算法:K-Means、K-Mediods、凝聚层次聚类和 DBSCAN 算法等。

(1) K-Means(K 均值)聚类

算法步骤:

(1) 首先我们选择一些类/组,并随机初始化它们各自的中心点。中心点是与每个数据点向量

长度相同的位置。这需要我们提前预知类的数量(即中心点的数量)。

(2) 计算每个数据点到中心点的距离,数据点距离哪个中心点最近就划分到哪一类中。

(3) 计算每一类中中心点作为新的中心点。

(4) 重复以上步骤,直到每一类中心在每次迭代后变化不大为止。也可以多次随机初始化中

心点,然后选择运行结果最好的一个。

优点:

速度快,计算简便

缺点:

必须提前知道数据有多少类/组。

(2)K-Mediods

k-均值算法采用簇的质心来代表一个簇,质心是簇中其他对象的参照点。因此,k-均值算法

对孤立点是敏感的,如果具有极大值,就可能大幅度地扭曲数据的分布。

k-中心点算法是为消除这种敏感性提出的,它选择簇中位置最接近簇中心的对象(称为中心

点)作为簇的代表点,目标函数仍然可以采用平方误差准则。

处理过程:首先,随机选择 k 个对象作为初始的 k 个簇的代表点,将其余对象根据其与代表

点对象的距离分配到最近的簇; 然后,反复用非代表点来代替代表点,以改进聚类质量,

聚类质量用一个代价函数来估计,该函数度量对象与代表点对象之间的平均相异度。

输入:n 个对象的数据库,期望得到的簇的数目 k

输出:使得所有对象与其最近中心点的偏差总和最小化的 k 个簇

方法:

选择 k 个对象作为初始的簇中心

repeat

对每个对象,计算离其最近的簇中心点,并将对象分配到该中心点代表的簇

随机选取非中心点 Orandom

计算用 Orandom 代替 Oj 形成新集合的总代价 S

如果 S<0,用 Orandom 代替 Oj,形成新的 k 个中心点的集合

until 不再发生变化

采用 k-中心点算法有两个好处:

对属性类型没有局限性;

通过簇内主要点的位置来确定选择中心点,对孤立点的敏感性小

不足:

处理时间要比 k-mean 更长;

用户事先指定所需聚类簇个数 k。

(3)凝聚层次聚类

层次聚类算法分为两类:自上而下和自下而上。凝聚层级聚类(HAC)是自下而上的一种聚类

算法。HAC 首先将每个数据点视为一个单一的簇,然后计算所有簇之间的距离来合并簇,知

道所有的簇聚合成为一个簇为止。

具体步骤:

(1) 首先我们将每个数据点视为一个单一的簇,然后选择一个测量两个簇之间距离的度量标

准。例如我们使用 average linkage 作为标准,它将两个簇之间的距离定义为第一个簇中的数

据点与第二个簇中的数据点之间的平均距离。

(2) 在每次迭代中,我们将两个具有最小 average linkage 的簇合并成为一个簇。

(3) 重复步骤 2 知道所有的数据点合并成一个簇,然后选择我们需要多少个簇。

层次聚类优点:(1)不需要知道有多少个簇

(2)对于距离度量标准的选择并不敏感

缺点:效率低

(4)基于密度的聚类方法(DBSCAN)

具体步骤:

(1) 首先确定半径 r 和 minPoints. 从一个没有被访问过的任意数据点开始,以这个点为中心,

r 为半径的圆内包含的点的数量是否大于或等于 minPoints,如果大于或等于 minPoints 则改

点被标记为 central point,反之则会被标记为 noise point。

(2) 重复 1 的步骤,如果一个 noise point 存在于某个 central point 为半径的圆内,则这个点

被标记为边缘点,反之仍为 noise point。重复步骤 1,知道所有的点都被访问过。

优点:不需要知道簇的数量

缺点:需要确定距离 r 和 minPoints

2、 评估方法

TP、True Positive 真阳性:预测为正,实际也为正

FP、False Positive 假阳性:预测为正,实际为负

FN、False Negative 假阴性:预测与负、实际为正

TN、True Negative 真阴性:预测为负、实际也为负。

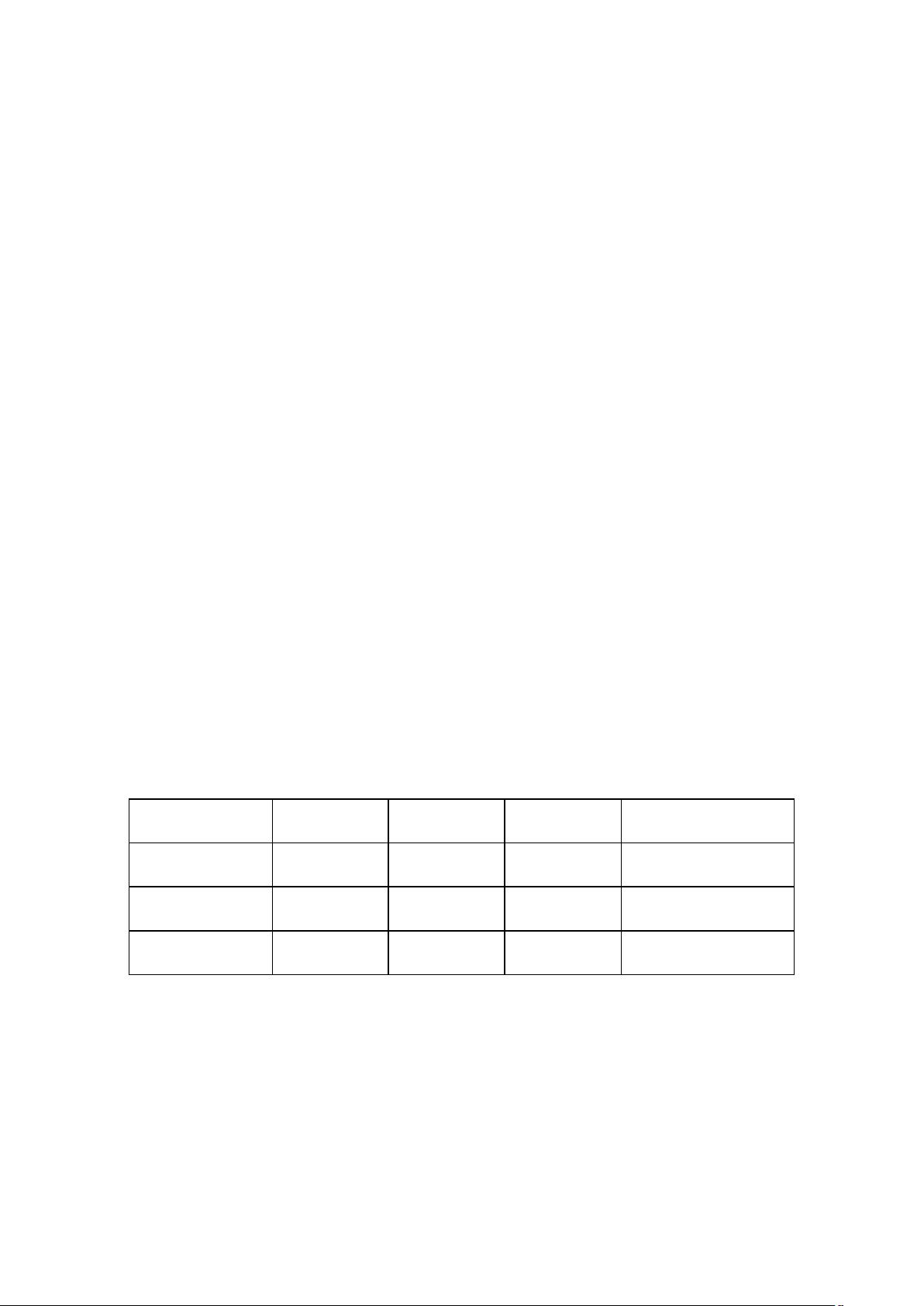

例如:

A

B

C

总计

TP

2

2

1

5

FP

0

2

1

3

FN

2

1

1

4

精确率:

Precison=TP/(TP+FP)

召回率:

Recall=TP/(TP+FN)

F1 分数(F1-Score),又称为平衡 F 分数(BalancedScore),它被定义为精确率和召回率的

调和平均数。

F1=(2* Precison* Recall)/(Precison+Recall)

剩余10页未读,继续阅读

love彤彤

- 粉丝: 34

- 资源: 311

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0