没有合适的资源?快使用搜索试试~ 我知道了~

大型语言模型(LLMs)概述

资源推荐

资源详情

资源评论

大型语言模型指的是具有数十亿参数(B+) 的预训练语言模型(例如: GPT-3, Bloom, LLaMA)。这种模

型可以用于各种自然语言处理任务 , 如文本生成 、机器翻译和自然语言理解等。

大型语言模型的这些参数是在大量文本数据上训练的 。现有的大型语言模型主要采用 Transformer 模型

架构 , 并且在很大程度上扩展了模型大小 、预训练数据和总计算量 。他们可以更好地理解自然语言 , 并

根据给定的上下文(例如 prompt)生成高质量的文本 。其中某些能力(例如上下文学习)是不可预测

的 , 只有当模型大小超过某个水平时才能观察到。

以下是 2019 年以来出现的各种大型语言模型(百亿参数以上) 时间轴 ,其中标黄的大模型已开源。

Source:A timeline of existing LLMs(>10B) https://arxiv.org/abs/2303.18223

在本期文章中 ,我们将一起探讨大型语言模型的发展历史 、语料来源 、数据预处理流程策略 、训练使用

的网络架构 、最新研究方向分析(LLaMA、PaLM-E 等) , 以及在亚马逊云科技上进行大型语言模型训

练的一些最佳落地实践等。

大型语言模型的发展历史

我们首先来了解下大型语言模型的发展历史和最新研究方向分析。

大型语言模型

1.0。过去五年里 , 自从我们看到最初的 Transformer 模型

BERT 、BLOOM、GPT、

GPT-2、GPT-3 等的出现 ,这一代的大型语言模型在

PaLM、Chinchilla 和

LLaMA 中达到了顶峰 。第一

代 Transformers 的共同点是: 它们都是在大型未加标签的文本语料库上进行预训练的 。

大型语言模型

2.0。过去一年里 ,我们看到许多经过预训练的大型语言模型 , 正在根据标记的目标数据

进行微调 。第二代 Transformers 的共同点是:对目标数据的微调 , 使用带有人工反馈的强化学习

( RLHF)或者更经典的监督式学习 。第二代大型语言模型的热门例子包括: InstructGPT、

ChatGPT 、Alpaca 和 Bard 等。

大型语言模型

3.0。过去的几个月里 ,这个领域的热门主题是参数高效微调和对特定领域数据进行预

训练 ,这是目前提高大型语言模型计算效率和数据效率的最新方法 。另外 , 下一代大型语言模型可能以

多模态和多任务学习为中心 ,这将为大型语言模型带来更多崭新并突破想象力的众多新功能。

在本文第二章节“ 大模型最新研究方向分析” 中 ,我们还会深入探讨参数微调 、特定数据预训练和多模态等

方向的相关进展分析。

01

近年来的大型语言模型概览

Source: https://arxiv.org/abs/2303.18223

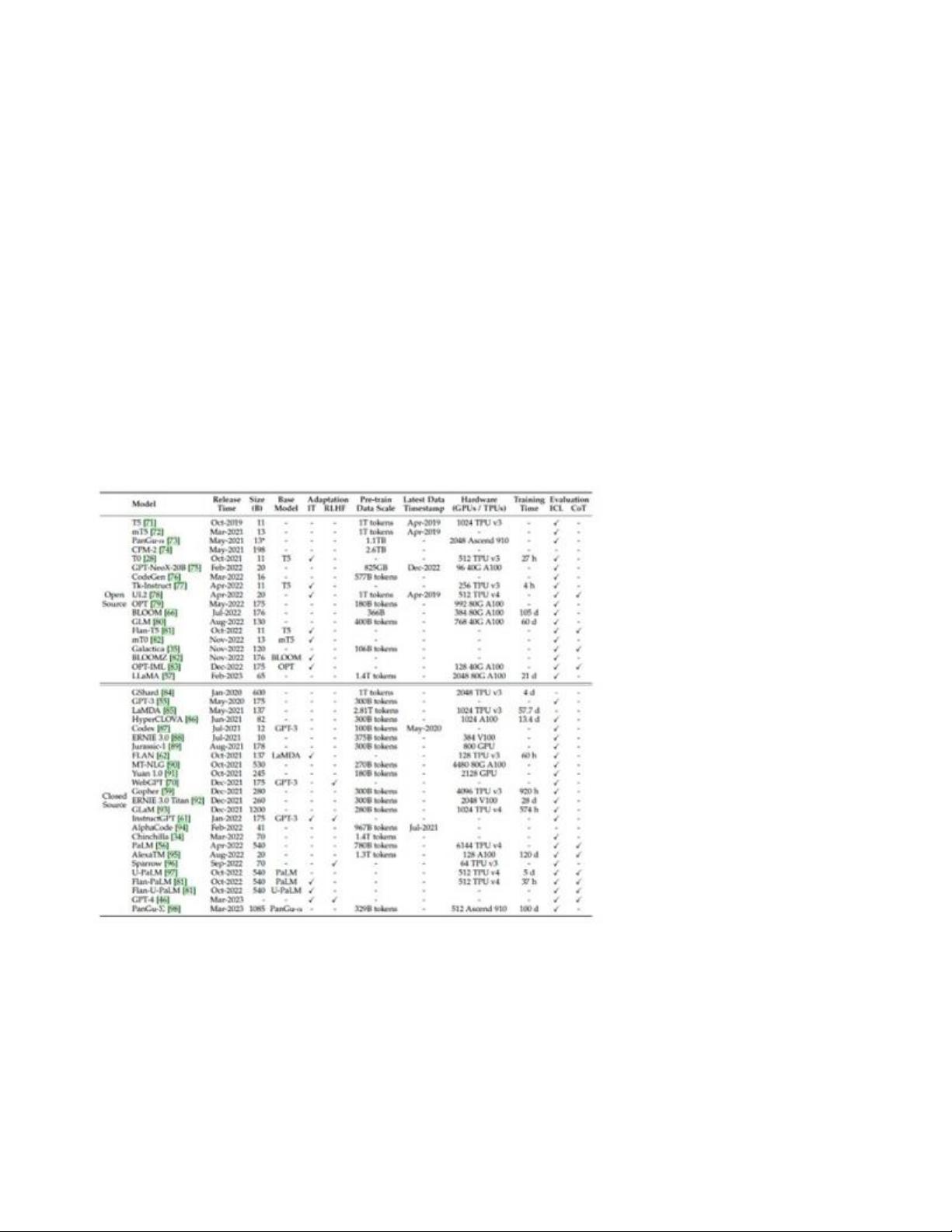

上图展示了近年来大型语言模型(大于

10B 的参数) 的统计数据 ,包括容量评估 、预训练数据规模

(token 数量或存储大小)和硬件资源成本。

图中 ,“Adaptation” 表示模型是否经过了后续微调: IT 表示指令调整 , RLHF 表示通过人工反馈进行强

化学习 。“Evaluation” 表示模型在原始论文中是否经过了相应能力的评估: ICL 表示上下文学习(in-

context learning) , CoT 表示思维链( chain-of-thought)。

02

大型语言模型的语料来源

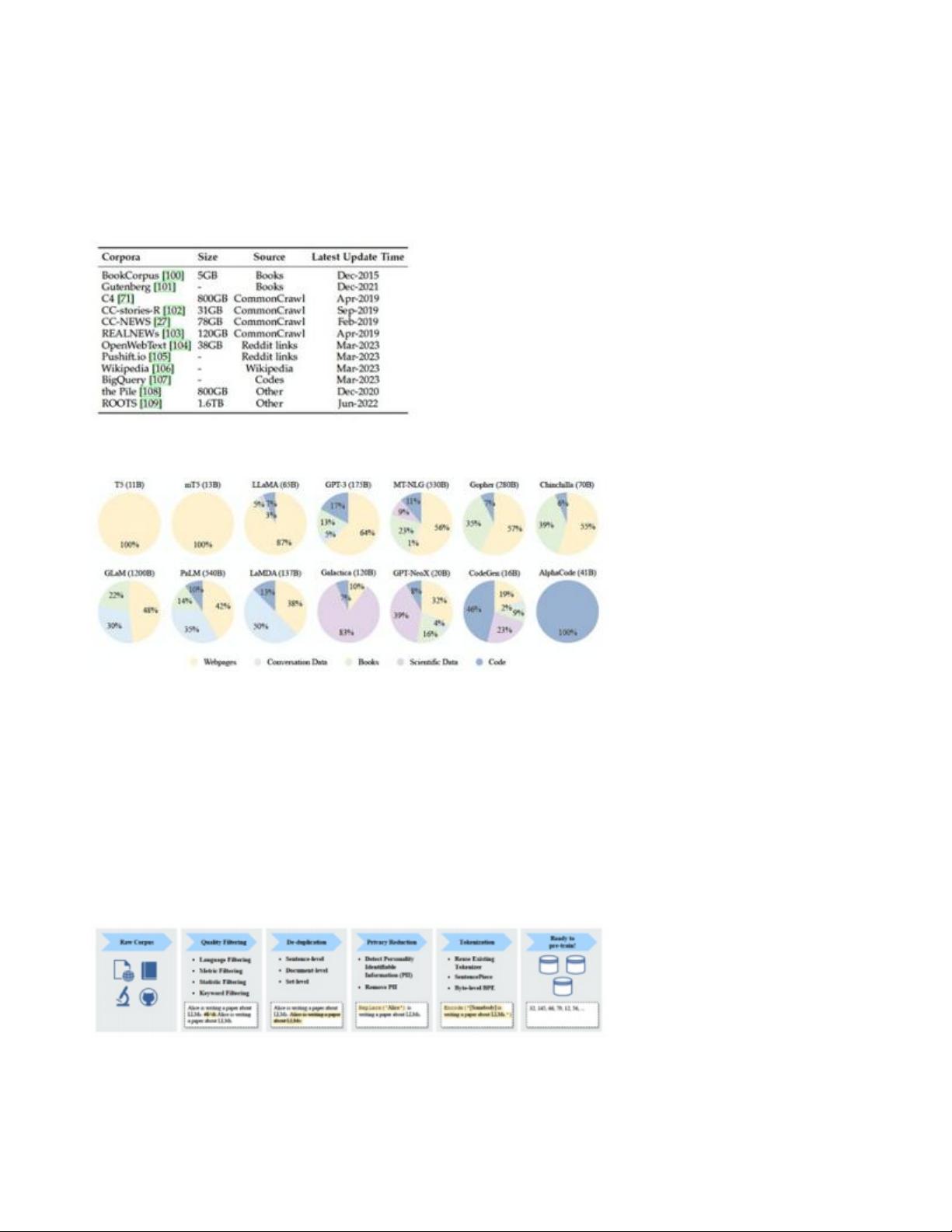

与早期的预训练语言模型(PLMs)相比 ,包含更多参数的大型语言模型需要更大的训练数据量 ,涵盖了

更广泛的内容 。为了满足这种需求 , 已经发布了越来越多的用于研究的训练数据集 。根据他们的内容类

型 , 大致可分类为六组: 图书 、CommonCrawl、Reddit 链接 、维基百科 、代码和其它 。如下表所示:

Source: https://arxiv.org/abs/2303.18223

Source: https://arxiv.org/abs/2303.18223

上图展示了现有大型语言模型预训练数据中 , 各种不同的数据来源占比比率的信息。

03

大型语言模型的数据预处理策略

在收集了大量数据后 ,对其进行预处理对于构建预训练语料库至关重要 ,尤其是要删除嘈杂 、冗余 、不

相关和潜在的有毒数据 ,这可能会在很大程度上影响大型语言模型的容量和性能 。该论文中 ,研究者们

用一个章节专门阐述了其研究团队的数据预处理策略 , 以及如何通过各种方法来提高所收集数据质量。

Source: https://arxiv.org/abs/2303.18223

上图为该论文阐述大型语言模型的预训练数据处理的典型策略概览图。

04

大型语言模型的网络结构

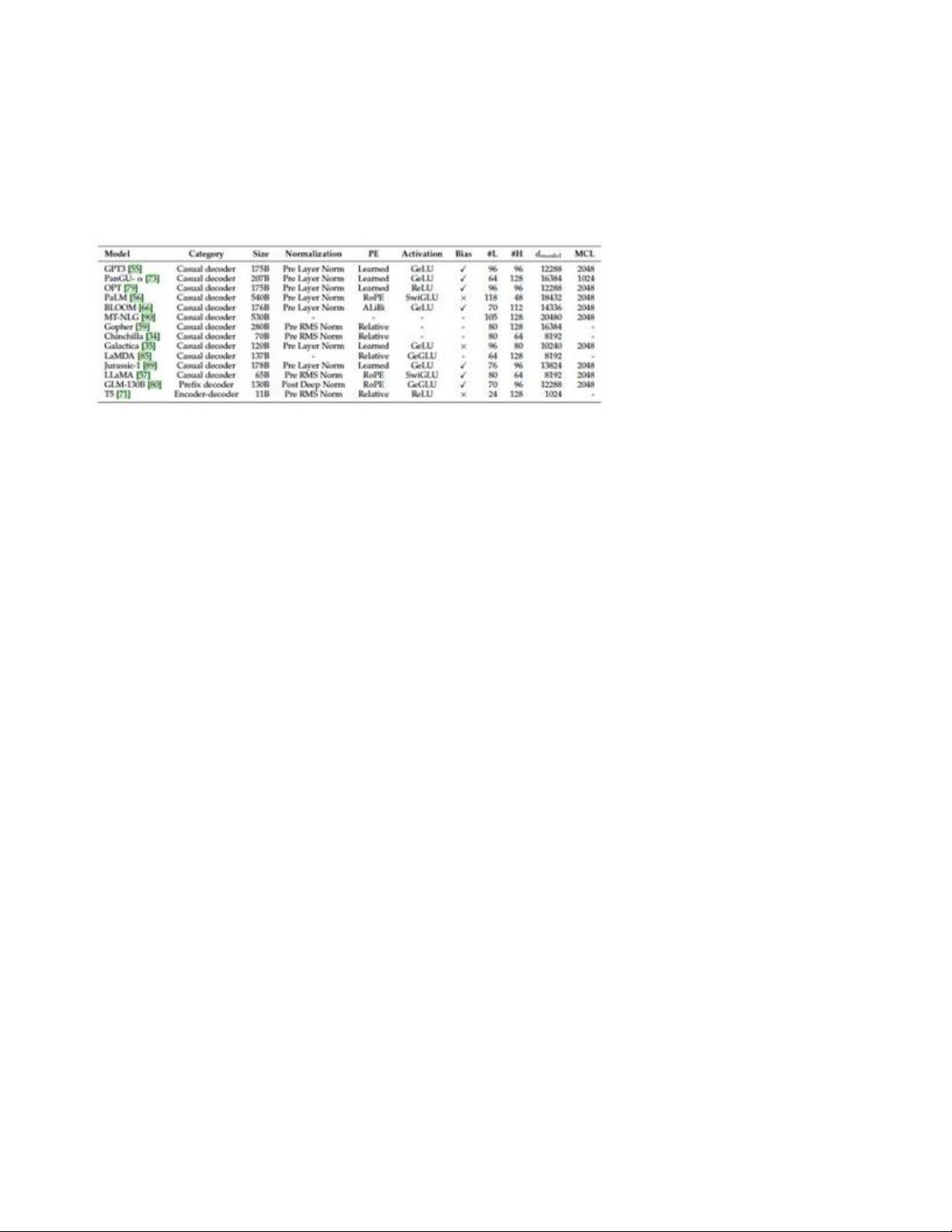

大型语言模型在训练阶段的网络结构设计参数 , 也是影响大型语言模型性能的重要指标之一 。下表列举

了一些大型语言模型的主要网络结构参数 ,包括:token 大小 、归一化方式 、位置嵌入方式 、激活函数、

是否使用

Bias、层数 、注意力头的数量 、隐藏状态大小 、最大上下文长度等参数 。如下表所示:

Source: https://arxiv.org/abs/2303.18223

上表概述了包含详细配置信息的多个大型语言模型的型号卡(Model cards):

PE 表示位置嵌入

#L 表示层数

#H 表示注意力头的数量

dmodel 表示隐藏状态的大小

MCL 表示最大上下文长度

05

大型语言模型的涌现能力

LLM 的涌现能力被正式定义为「在小型模型中不存在但在大型模型中出现的能力」 ,这是 LLM 与以前的

PLM 区分开来的最显著特征之一 。当出现这种新的能力时 , 它还引入了一个显著的特征: 当规模达到一

定水平时 , 性能显著高于随机的状态 。 以此类推 ,这种新模式与物理学中的相变现象密切相关 。原则

上 ,这种能力也可以与一些复杂的任务有关 ,而人们更关心可以应用于解决多个任务的通用能力。

剩余17页未读,继续阅读

资源评论

千源万码

- 粉丝: 772

- 资源: 368

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功