没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

LeNet-5 模型

在 CNN 的应用中,文字识别系统所用的 LeNet-5 模型是非常经典的模

型。LeNet-5 模型是 1998 年,Yann LeCun 教授提出的,它是第一个

成功大规模应用在手写数字识别问题的卷积神经网络,在 MNIST 数据

集中的正确率可以高达 99.2%。

下面详细介绍一下 LeNet-5 模型工作的原理。

LeNet-5 模型一共有 7 层,每层包含众多参数,也就是卷积神经网络

中的参数。虽然层数只有 7 层,这在如今庞大的神经网络中可是说是

非常少的了,但是包含了卷积层,池化层,全连接层,可谓麻雀虽小

五脏俱全了。为了方便,我们把卷积层称为 C 层,下采样层叫做下采

样层。

首先,输入层输入原始图像,原始图像被处理成 32×32 个像素点的

值。然后,后面的隐层计在卷积和子抽样之间交替进行。C1 层是卷积

层,包含了六个特征图。每个映射也就是 28x28 个神经元。卷积核可

以是 5x5 的十字形,这 28×28 个神经元共享卷积核权值参数,通过卷

积运算,原始信号特征增强,同时也降低了噪声,当卷积核不同时,

提取到图像中的特征不同;C2 层是一个池化层,池化层的功能在上文

已经介绍过了,它将局部像素值平均化来实现子抽样。

池化层包含了六个特征映射,每个映射的像素值为 14x14,这样的池

化层非常重要,可以在一定程度上保证网络的特征被提取,同时运算

量也大大降低,减少了网络结构过拟合的风险。因为卷积层与池化层

是交替出现的,所以隐藏层的第三层又是一个卷积层,第二个卷积层

由 16 个特征映射构成,每个特征映射用于加权和计算的卷积核为

10x10 的。第四个隐藏层,也就是第二个池化层同样包含 16 个特征映

射,每个特征映射中所用的卷积核是 5x5 的。第五个隐藏层是用 5x5

的卷积核进行运算,包含了 120 个神经元,也是这个网络中卷积运算

的最后一层。

之后的第六层便是全连接层,包含了 84 个特征图。全连接层中对输入

进行点积之后加入偏置,然后经过一个激活函数传输给输出层的神经

元。最后一层,也就是第七层,为了得到输出向量,设置了十个神经

元来进行分类,相当于输出一个包含十个元素的一维数组,向量中的

十个元素即 0 到 9。

AlexNet 模型

AlexNet 简介

2012 年 Imagenet 图像识别大赛中,Alext 提出的 alexnet 网络模型一

鸣惊人,引爆了神经网络的应用热潮,并且赢得了 2012 届图像识别大

赛的冠军,这也使得卷积神经网络真正意义上成为图像处理上的核心

算法。上文介绍的 LeNet-5 出现在上个世纪,虽然是经典,但是迫于

种种复杂的现实场景限制,只能在一些领域应用。不过,随着 SVM 等

手工设计的特征的飞速发展,LeNet-5 并没有形成很大的应用状况。

随着 ReLU 与 dropout 的提出,以及 GPU 带来算力突破和互联网时代

大数据的爆发,卷积神经网络带来历史的突破,AlexNet 的提出让深度

学习走上人工智能的最前端。

图像预处理

AlexNet 的训练数据采用 ImageNet 的子集中的 ILSVRC2010 数据

集,包含了 1000 类,共 1.2 百万的训练图像,50000 张验证集,

150000 张测试集。在进行网络训练之前我们要对数据集图片进行预处

理。首先我们要将不同分辨率的图片全部变成 256x256 规格的图像,

变换方法是将图片的短边缩放到 256 像素值,然后截取长边的中间位

置的 256 个像素值,得到 256x256 大小的图像。除了对图片大小进行

预处理,还需要对图片减均值,一般图像均是由 RGB 三原色构成,均

值按 RGB 三分量分别求得,由此可以更加突出图片的特征,更方便后

面的计算。

此外,对了保证训练的效果,我们仍需对训练数据进行更为严苛的处

理。在 256x256 大小的图像中,截取 227x227 大小的图像,在此之后

对图片取镜像,这样就使得原始数据增加了(256-224)x(256-

224)x2= 2048 倍。最后对 RGB 空间做 PCA,然后对主成分做

(0,0.1)的高斯扰动,结果使错误率下降 1%。对测试数据而言,抽

取以图像 4 个角落的大小为 224224 的图像,中心的 224224 大小的图

像以及它们的镜像翻转图像,这样便可以获得 10 张图像,我们便可以

利用 softmax 进行预测,对所有预测取平均作为最终的分类结果。

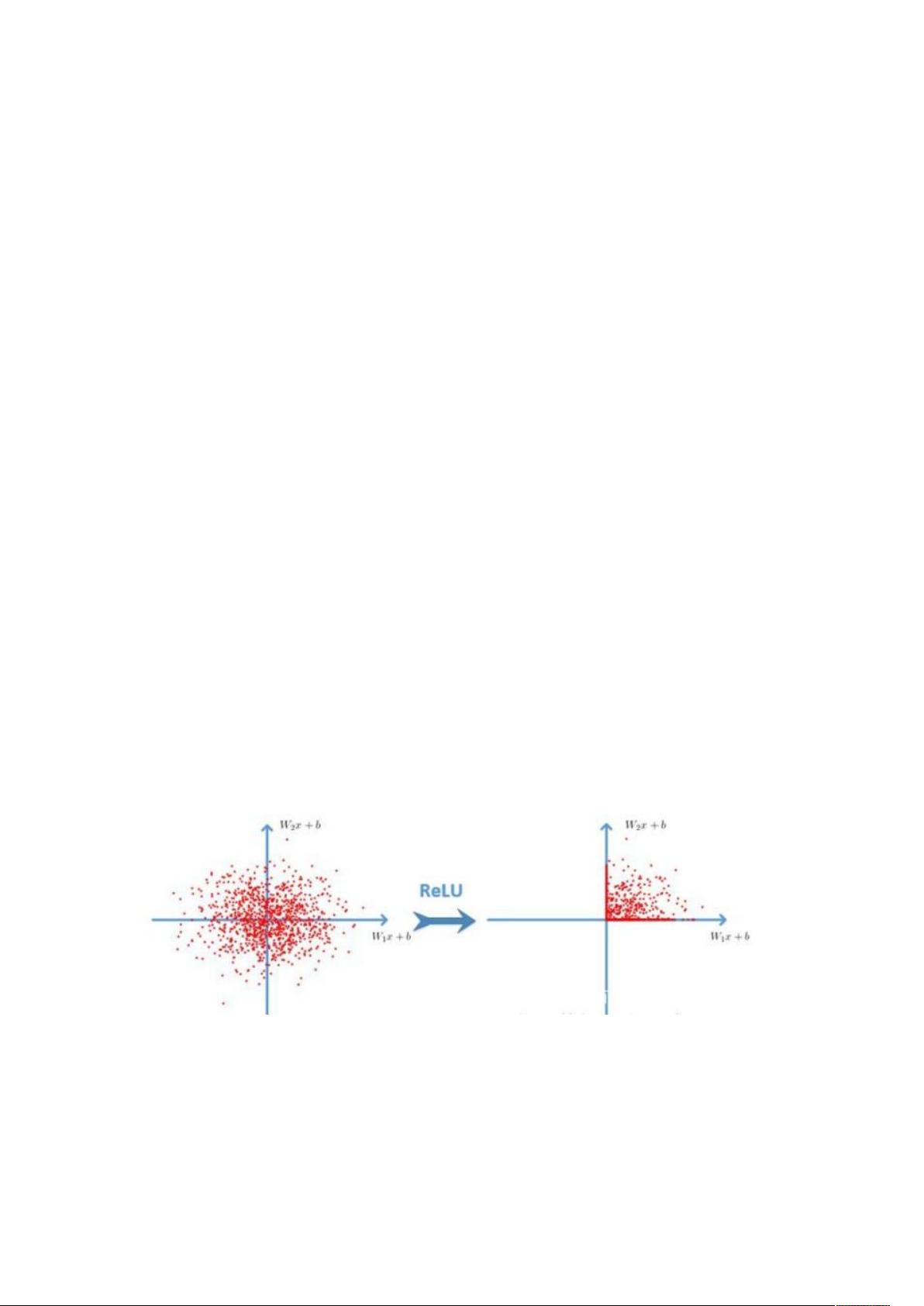

ReLU 激活函数

之前我们提到常用的非线性的激活函数是 sigmoid,它能够把输入的连

续实值全部确定在 0 和 1 之间。但是这带来一个问题,当一个负数的

绝对值很大时,那么输出就是 0;如果是绝对值非常大的正数,输出

就是 1。这就会出现饱和的现象,饱和现象中神经元的梯度会变得特

别小,这样必然会使得网络的学习更加困难。此外,sigmoid 的 output

的值并不是 0 为均值,因为这会导致上一层输出的非 0 均值信号会直

接输入到后一层的神经元上。所以 AlexNet 模型提出了 ReLU 函数,

公式:f(x)=max(0,x)f(x)=max(0,x)。

用 ReLU 代替了 Sigmoid,发现使用 ReLU 得到的 SGD 的收敛速度

会比 sigmoid 快很多,这成了 AlexNet 模型的优势之一。

剩余15页未读,继续阅读

资源评论

sun7bear

- 粉丝: 2

- 资源: 121

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 成都市地图含高新区(高新南区,高新西区),天府新区,东部新区虚拟行政区划

- XILINXFPGA源码XilinxEDK设计试验

- XILINXFPGA源码XilinxEDKMicroBlaze内置USB固件程序

- 基于 django 的视频点播后台管理系统源代码+数据库

- 基于Java的网上医院预约挂号系统的设计与实现(部署视频)-kaic.mp4

- 新建项目opengrok

- XILINXFPGA源码XilinxDDR3最新VHDL代码(通过调试)

- XILINXFPGA源码XilinxDDR2存储器接口调试代码

- 班级事务管理系统设计与实现(部署视频)-kaic.mp4

- excel带下拉框展示(动态展示)

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功