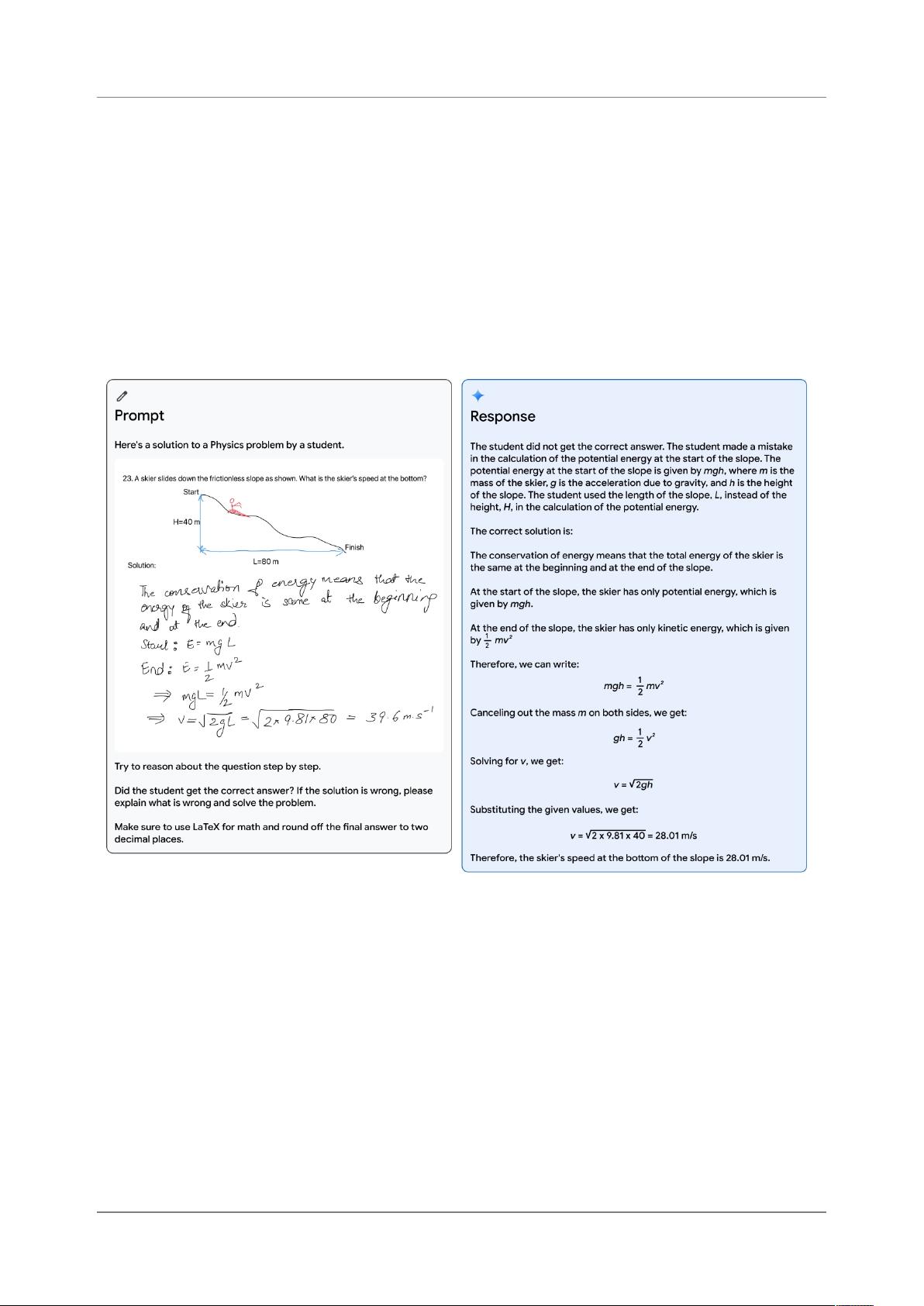

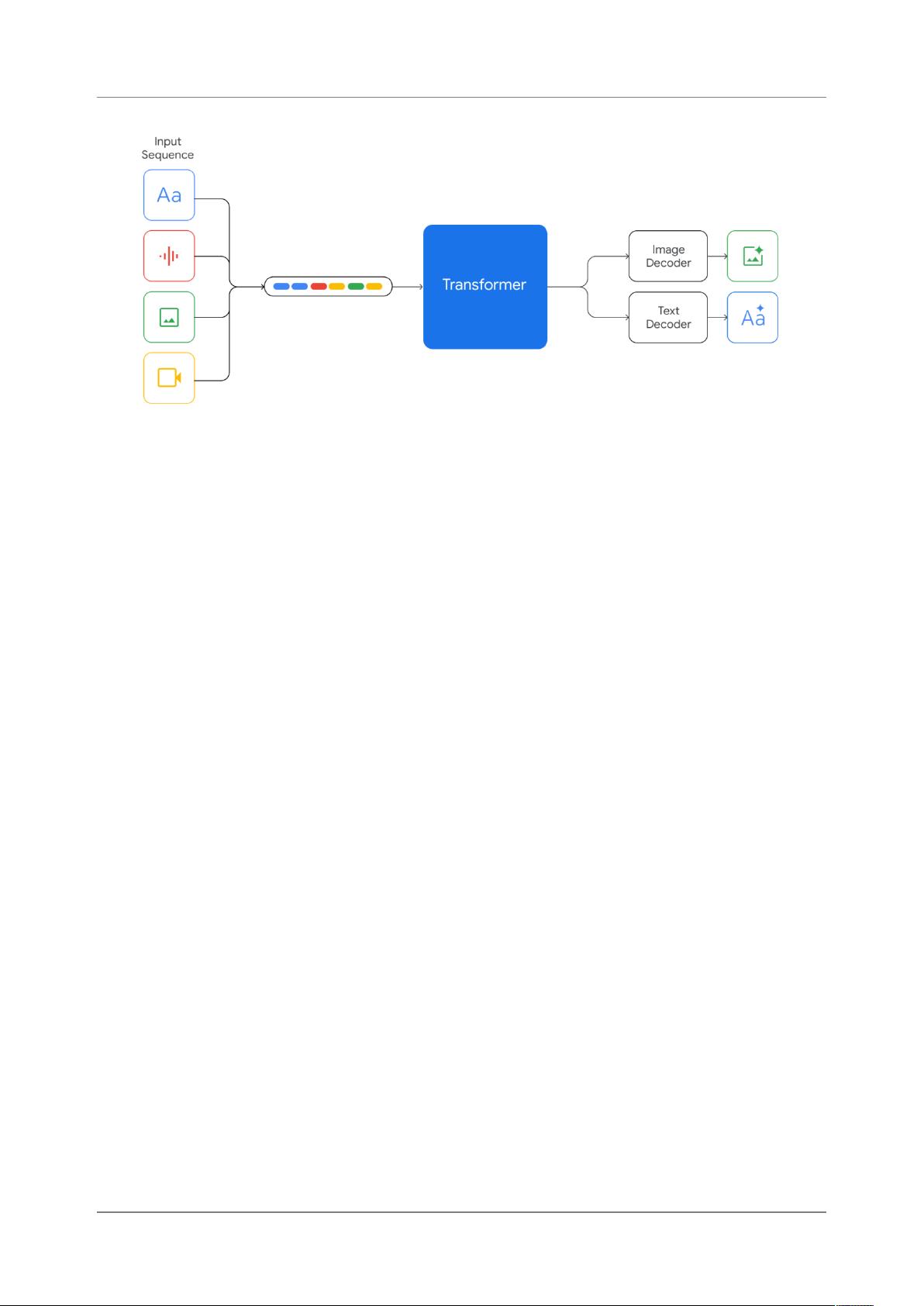

Gemini双子座:一系列高能力多模态模型的前世今生 Gemini双子座是Google开发的一系列高性能的多模态模型,它们在图像、音频、视频和文本理解方面具有卓越的能力。Gemini系列包括Ultra、Pro和Nano三种尺寸,适用于从复杂的推理任务到设备内存受限的应用场景。 知识点1:多模态模型的发展 多模态模型是指可以处理多种形式的输入数据(如图像、音频、视频和文本)的模型。Gemini双子座是基于深度学习技术的多模态模型,它可以处理图像、音频、视频和文本四种形式的输入数据。Gemini双子座的出现标志着多模态模型的发展进入了一个新的阶段。 知识点2:Gemini双子座的架构设计 Gemini双子座的架构设计基于序列模型的工作,它可以处理长期依赖关系的序列数据。Gemini双子座的架构设计还基于神经网络的深度学习技术,可以实现稳定的大规模训练和优化推理。 知识点3:Gemini双子座的多模态能力 Gemini双子座在多模态任务方面具有卓越的能力,它可以处理图像、音频、视频和文本四种形式的输入数据。Gemini双子座可以在图像理解、音频处理和视频理解方面实现优异的性能。 知识点4:Gemini双子座在语言理解和推理方面的能力 Gemini双子座在语言理解和推理方面具有卓越的能力,它可以处理复杂的推理任务和语言理解任务。Gemini双子座可以在文本、图像、音频和视频四种形式的输入数据中实现优异的语言理解和推理能力。 知识点5:Gemini双子座的应用前景 Gemini双子座的应用前景非常广泛,它可以应用于教育、健康、金融等多个领域。Gemini双子座可以帮助人们更好地理解和解决复杂的问题,具有重大的社会和经济价值。 知识点6:Gemini双子座的技术指标 Gemini双子座的技术指标非常优异,它可以在32个基准测试中取得最新的最先进结果。在MMLU基准测试中,Gemini Ultra模型实现了人类专家水平表现的突破性成绩。 知识点7:Gemini双子座的教育应用 Gemini双子座可以应用于教育领域,帮助学生更好地理解和解决复杂的问题。Gemini双子座可以帮助教师更好地教学和评估学生的学习效果。 知识点8:Gemini双子座的健康应用 Gemini双子座可以应用于健康领域,帮助医生更好地理解和诊断疾病。Gemini双子座可以帮助医生更好地评估和预测疾病的发展趋势。 知识点9:Gemini双子座的金融应用 Gemini双子座可以应用于金融领域,帮助金融机构更好地理解和预测市场趋势。Gemini双子座可以帮助金融机构更好地评估和管理风险。 知识点10:Gemini双子座的社会影响 Gemini双子座的社会影响非常深远,它可以帮助人们更好地理解和解决复杂的问题,具有重大的社会和经济价值。Gemini双子座可以帮助人们更好地生活和工作,提高生活质量和工作效率。

剩余79页未读,继续阅读

- 粉丝: 33w+

- 资源: 554

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- 此存储库适用于 Linkedin Learning 课程学习 Java.zip

- (源码)基于STM32和AD9850的无线电信标系统.zip

- (源码)基于Android的新闻推荐系统.zip

- 本资源库是关于“Java Collection Framework API”的参考资料,是 Java 开发社区的重要贡献,旨在提供有关 Java 语言学院 API 的实践示例和递归教育关系 .zip

- 插件: e2eFood.dll

- 打造最强的Java安全研究与安全开发面试题库,帮助师傅们找到满意的工作.zip

- (源码)基于Spark的实时用户行为分析系统.zip

- (源码)基于Spring Boot和Vue的个人博客后台管理系统.zip

- 将流行的 ruby faker gem 引入 Java.zip

- (源码)基于C#和ArcGIS Engine的房屋管理系统.zip

信息提交成功

信息提交成功