【标题】"Hadoop集群搭建共10页.pdf.zip" 提供的是关于Hadoop集群建设的详细教程,可能涵盖了从规划、配置到实际操作的全过程。Hadoop是Apache基金会的一个开源分布式计算框架,广泛应用于大数据处理领域。它通过分布式文件系统(HDFS)和MapReduce计算模型,使得海量数据的存储和处理变得更加高效和可靠。

【描述】"Hadoop集群搭建共10页.pdf.zip" 指出这份文档内容较精炼,只有10页,但包含了全部搭建过程的关键步骤。通常,搭建Hadoop集群涉及多个环节,包括硬件选择、操作系统配置、Hadoop组件安装、网络设置、安全性考量等。这10页内容可能会提供快速入门的指导,适合初学者或希望快速了解Hadoop集群部署的读者。

【标签】"Hadoop集群搭建共10页.p" 这个标签可能是误输入,但可以理解为与Hadoop集群搭建相关的要点或者关键点,可能是每个步骤的简写或关键词。

【压缩包子文件的文件名称列表】: "赚钱项目" 这个文件名与Hadoop集群搭建主题不直接相关,可能是文档中的一个章节标题,或者是其他非技术性的内容。在Hadoop集群的背景下,"赚钱项目"可能指的是利用大数据分析或处理能力为企业创造利润的应用示例。

Hadoop集群搭建的知识点通常包括:

1. **硬件规划**:根据数据规模和业务需求选择适合的服务器硬件,考虑CPU、内存、磁盘I/O和网络带宽。

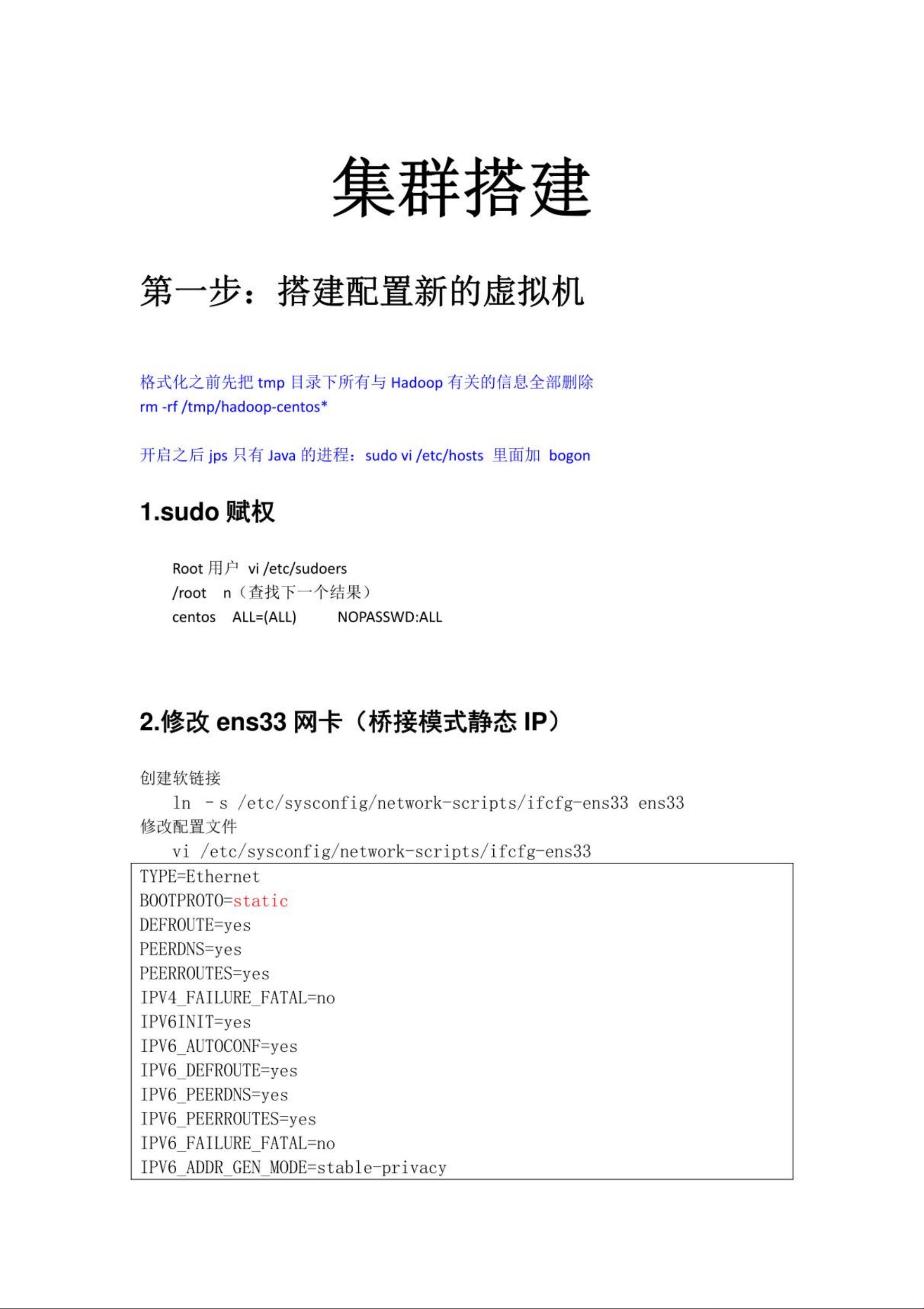

2. **操作系统**:通常选择Linux作为基础平台,如Ubuntu、CentOS等,因为Hadoop是为Linux设计的。

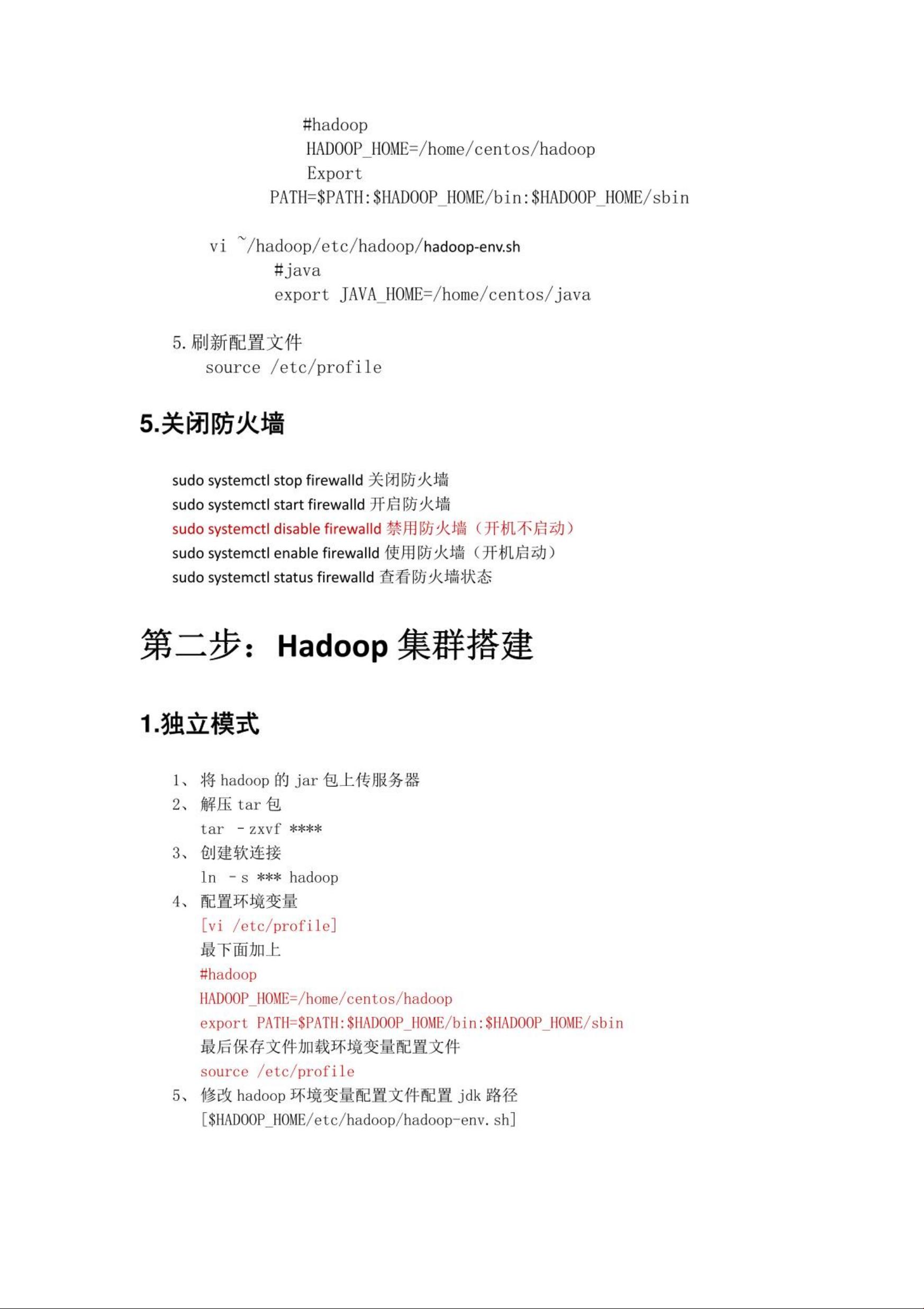

3. **环境准备**:安装Java开发工具包(JDK),配置环境变量,确保所有节点间可以互相通信。

4. **Hadoop下载与安装**:从Apache官方网站获取最新稳定版本的Hadoop源码或二进制包,解压并配置相关参数。

5. **配置文件**:修改`core-site.xml`(核心配置)、`hdfs-site.xml`(HDFS配置)、`mapred-site.xml`(MapReduce配置)、`yarn-site.xml`(YARN配置)等文件,设定Hadoop的集群模式、副本数量、端口等信息。

6. **初始化HDFS**:使用`hdfs namenode -format`命令格式化NameNode,这是首次启动Hadoop集群的必要步骤。

7. **启动服务**:按照Hadoop服务启动顺序(例如,首先启动DataNode,然后是NameNode,接着是ResourceManager,最后是NodeManager)启动集群。

8. **数据分布**:将数据分发到各个DataNode上,可以通过`hadoop fs -put`命令上传文件。

9. **集群监控**:使用Hadoop自带的Web UI监控集群状态,包括NameNode、DataNode、ResourceManager和NodeManager的Web界面。

10. **故障恢复与高可用性**:设置Secondary NameNode(在Hadoop 2.x后改为Standby NameNode)以实现NameNode的热备,配置ResourceManager的HA以提高服务稳定性。

11. **安全性**:如果在生产环境中,需要考虑实施Kerberos认证以确保数据安全。

12. **性能优化**:根据实际情况调整Hadoop的配置参数,如Map任务和Reduce任务的数量、内存分配等,以达到最佳性能。

13. **应用开发**:学习使用Hadoop的API开发MapReduce程序,或者使用基于Hadoop的高级框架如Spark、Flink进行大数据处理。

通过这份10页的文档,读者应该能够掌握Hadoop集群的基本搭建流程,并具备初步的实践能力。不过,真正的Hadoop集群管理还需要深入理解和实践经验,包括故障排查、日志分析以及性能调优等方面。