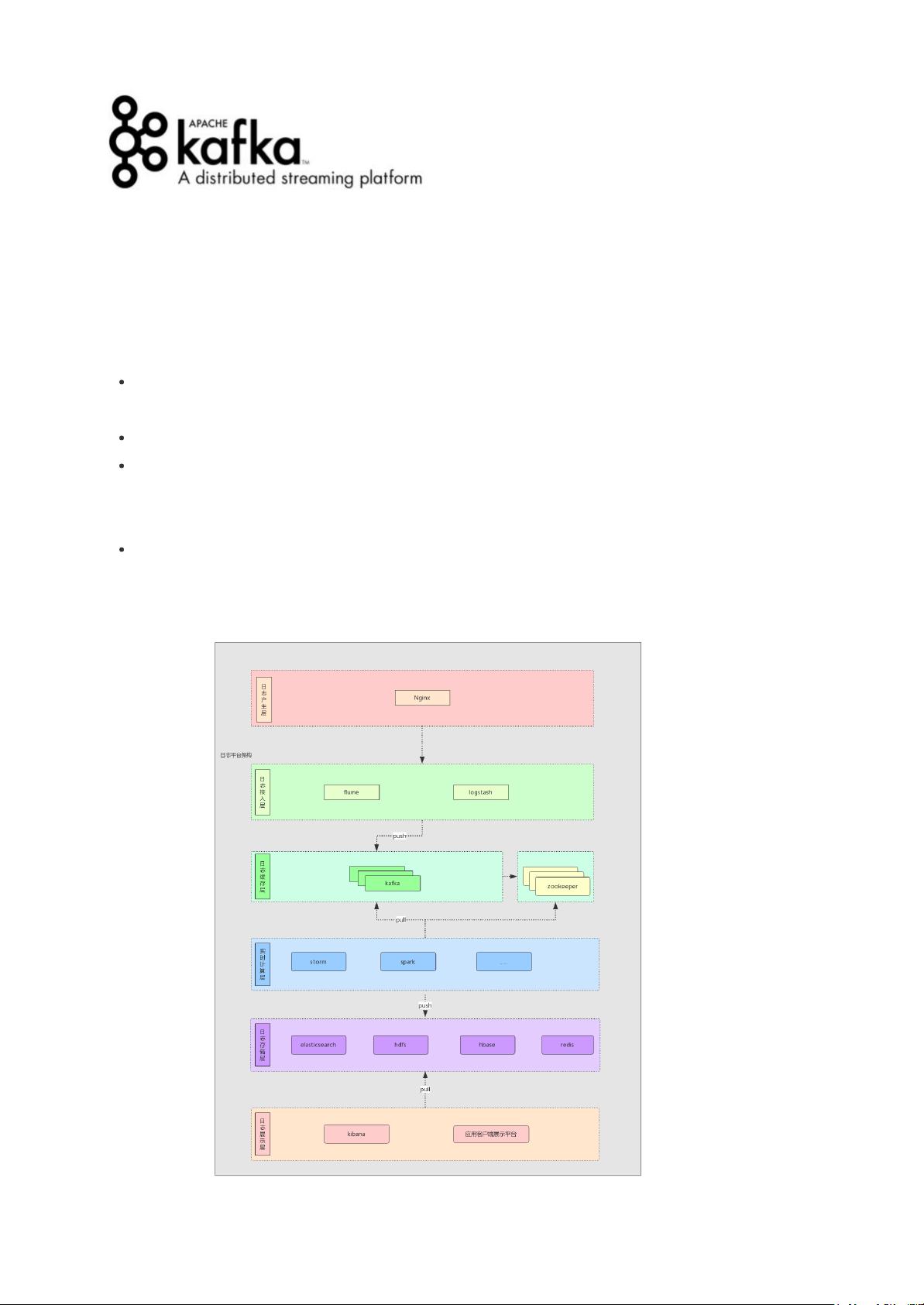

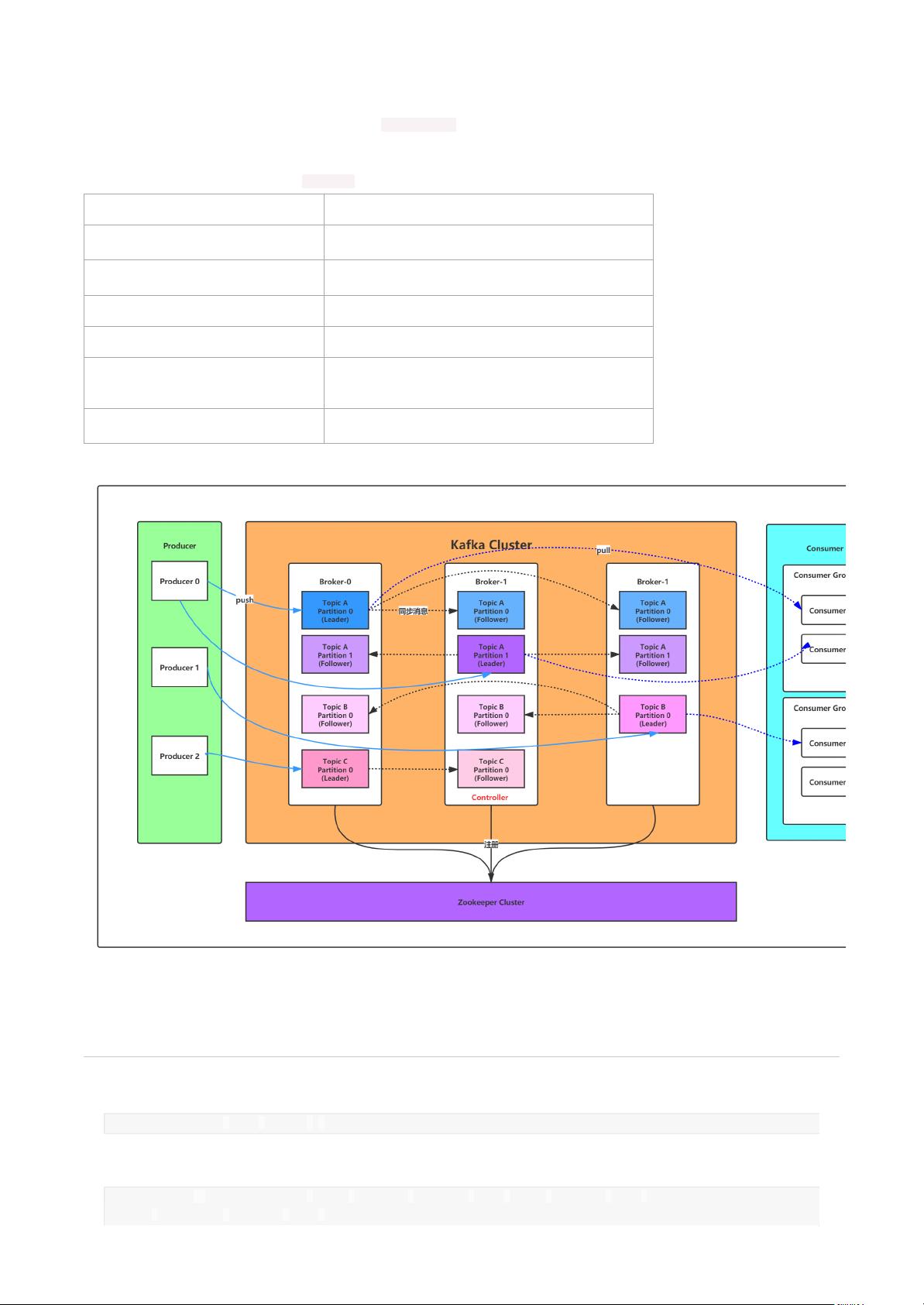

本文档提供了对Kafka这一分布式消息系统的全面解析,从基本概念到实际应用,涵盖了其在日志收集、消息系统、用户活动跟踪等方面的使用场景。首先介绍了Kafka的核心概念,如Broker、Topic、Producer、Consumer等,随后详细阐述了Kafka的安装步骤、配置过程以及其与Zookeeper的交互。通过对Kafka生产者和消费者的代码示例分析,文档展示了消息的发送和接收过程,同时探讨了Kafka集群的搭建和运维,包括主题创建、分区管理、消息复制和容错处理等核心功能。此外,本文还探讨了Kafka的Java客户端访问方式,并且介绍了Spring Boot与Kafka的整合方法。整体上,文档提供了对Kafka架构深度的理解,同时通过实例代码展示了其在实际应用中的强大功能和灵活性。 Kafka是一种分布式消息系统,最初由LinkedIn开发,后成为Apache软件基金会的顶级开源项目。它设计用于处理实时的大量数据,适用于批处理系统、实时处理系统、流处理引擎等多种场景,如日志收集、消息传递、用户活动追踪和运营指标监控。 Kafka的核心组件包括Broker、Topic、Producer和Consumer。Broker是Kafka集群中的处理节点,多个Broker可以构成一个集群,提供高可用性和可扩展性。Topic是消息的分类,每条消息都需指定一个Topic。Producer是消息的生产者,负责将消息发送到Broker。Consumer是消息的消费者,从Broker读取并处理消息。ConsumerGroup是Consumer的逻辑分组,确保消息在组内的唯一消费,同一组内的Consumer互斥消费消息。 Kafka的另一个关键特性是Partition,即Topic的物理分区。每个Partition内部的消息保持顺序,使得数据处理具有一定的顺序性。Partition的存在也支持并行处理,提高了吞吐量。服务端与客户端之间的通信基于TCP协议,确保了消息传输的可靠性。 在部署Kafka之前,需要安装Java JDK,因为Kafka是用Scala编写的,运行在JVM上。此外,Kafka依赖于Zookeeper作为协调服务,因此也需要先安装Zookeeper。安装完成后,可以按照以下步骤部署Kafka: 1. 下载Kafka的安装包,通常是tar.gz格式。 2. 解压缩安装包,进入解压后的目录。 3. 修改配置文件`config/server.properties`,设置broker.id、监听器地址、日志存储路径和Zookeeper连接地址。 4. 启动Kafka服务。 Kafka的使用还包括创建Topic、管理分区、配置消息复制策略以及处理容错。例如,通过`kafka-topics.sh`脚本可以创建和管理Topic,通过调整副本数量实现容错。此外,Kafka提供了多种语言的客户端库,包括Java,允许开发者方便地集成到他们的应用程序中。在Java中,可以使用Kafka的API创建Producer和Consumer,发送和接收消息。 对于更高级的应用,例如在Spring Boot框架中使用Kafka,可以利用Spring的Kafka支持轻松集成。Spring Boot提供了自动配置和声明式API,简化了Kafka的使用,使得开发者能够专注于业务逻辑,而不是消息传递的细节。 Kafka以其高性能、高可扩展性和丰富的功能,成为了实时数据处理和消息传递领域的重要工具。通过理解其核心概念和实际操作,开发者能够有效地构建和维护大规模的数据流处理系统。

剩余13页未读,继续阅读

- 粉丝: 796

- 资源: 64

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功