解读 ChatGPT 背后的技术重点:RLHF、IFT、CoT、红蓝对抗

近段时间,ChatGPT 横空出世并获得巨大成功,使得 RLHF、SFT、IFT、CoT 等这些晦涩的缩

写开始出现在普罗大众的讨论中。这些晦涩的首字母缩略词究竟是什么意思?为什么它们如此重

要?我们调查了相关的所有重要论文,以对这些工作进行分类,总结迄今为止的工作,并对后续

工作进行展望。

我们先来看看基于语言模型的会话代理的全景。ChatGPT 并非首创,事实上很多组织在 OpenAI

之前就发布了自己的语言模型对话代理 (dialog agents),包括

Meta 的 BlenderBot,Google 的

LaMDA,DeepMind 的 Sparrow,以及 Anthropic 的 Assistant (Anthropic 的 Claude 就是部分

基于 Assistant 继续开发而得的)。

其中一些团队还公布了他们构建开源聊天机器人的计划,并公开分享了路线图 (比如 LAION 团

队的 Open Assistant),其他团队肯定也有类似的内容,但尚未宣布。

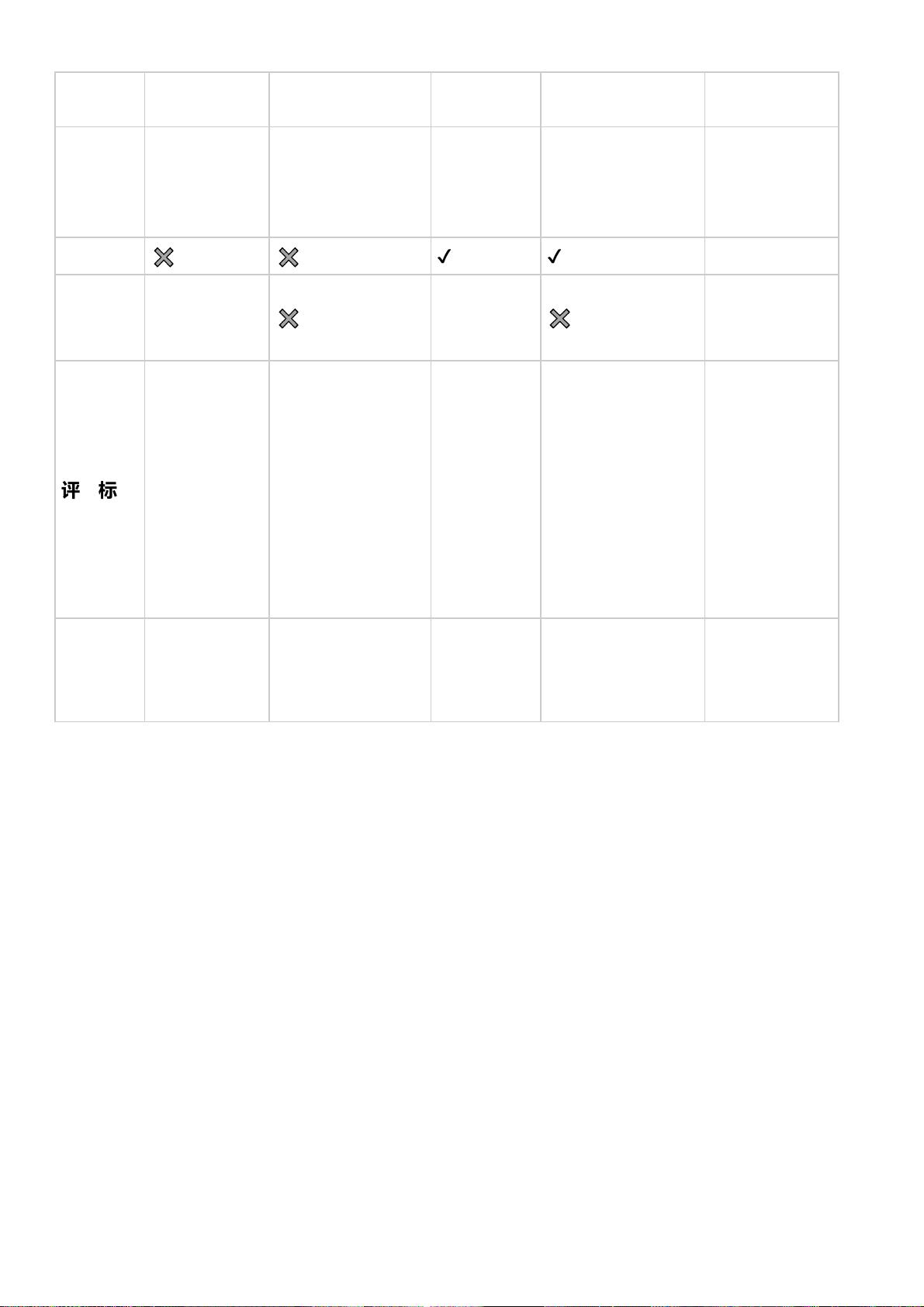

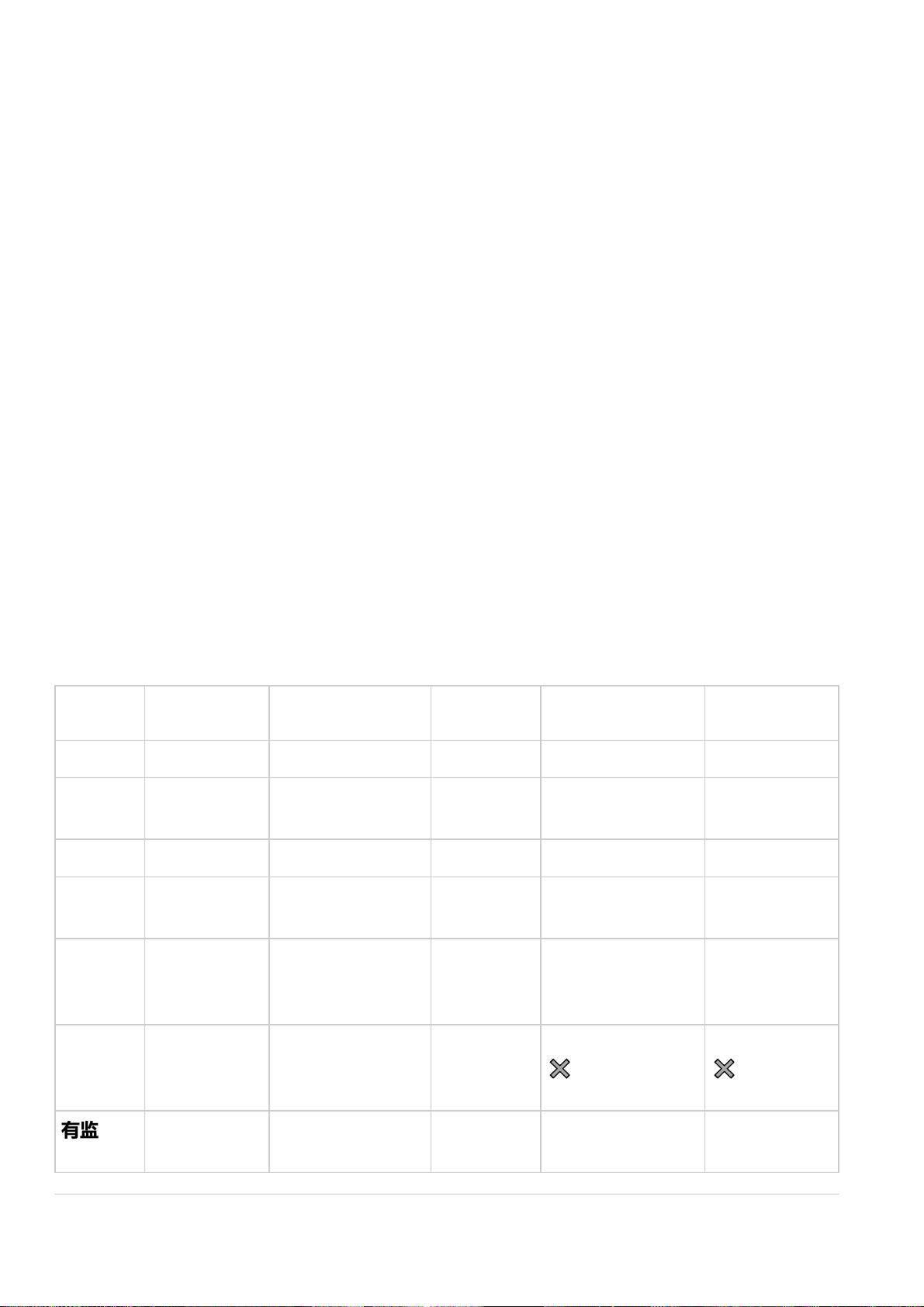

下表根据是否能公开访问、训练数据、模型架构和评估方向的详细信息对这些 AI 聊天机器人进

行了比较。 ChatGPT 没有这些信息的记录,因此我们改为使用 InstructGPT 的详细信息,这是

一个来自 OpenAI 的指令微调模型,据信它是 ChatGPT 的基础。

LaMDA BlenderBot 3 Sparrow

ChatGPT /

InstructGPT

Assistant

组织

Google Meta DeepMind OpenAI Anthropic

能否公开

访问

否 能 否 有限 否

大小

137B 175B 70B 175B 52B

预训练

基础模型

未知

OPT Chinchilla GPT-3.5

未知

预训练语

料库大

小 (词数)

2.81T 180B 1.4T

未知

400B

模型是否

可以

访问网络

✔ ✔ ✔

✖ ✖

有监督

微调

✔ ✔ ✔ ✔ ✔