基于flink-cdc实现监控数据源的实时变更数据捕获

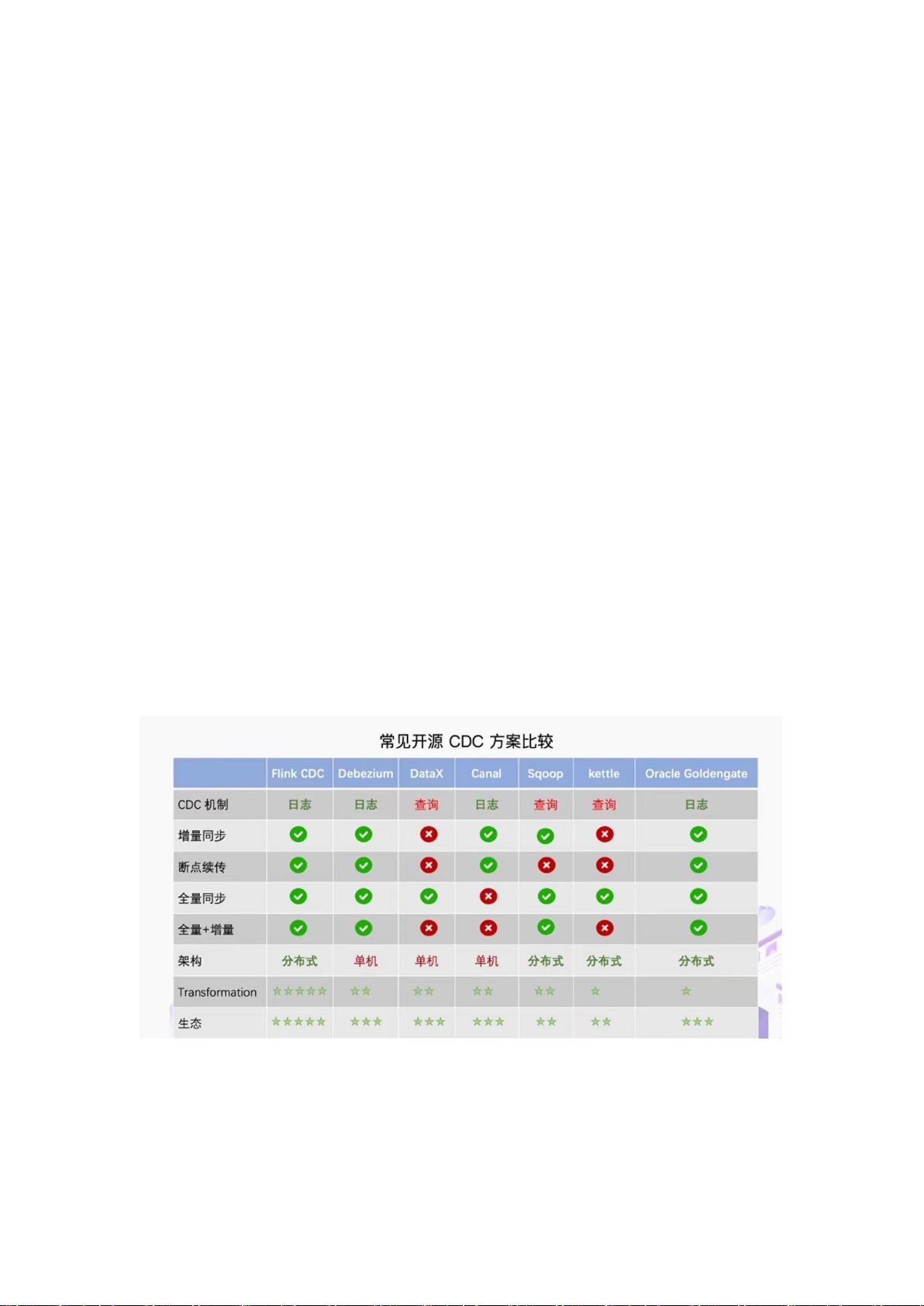

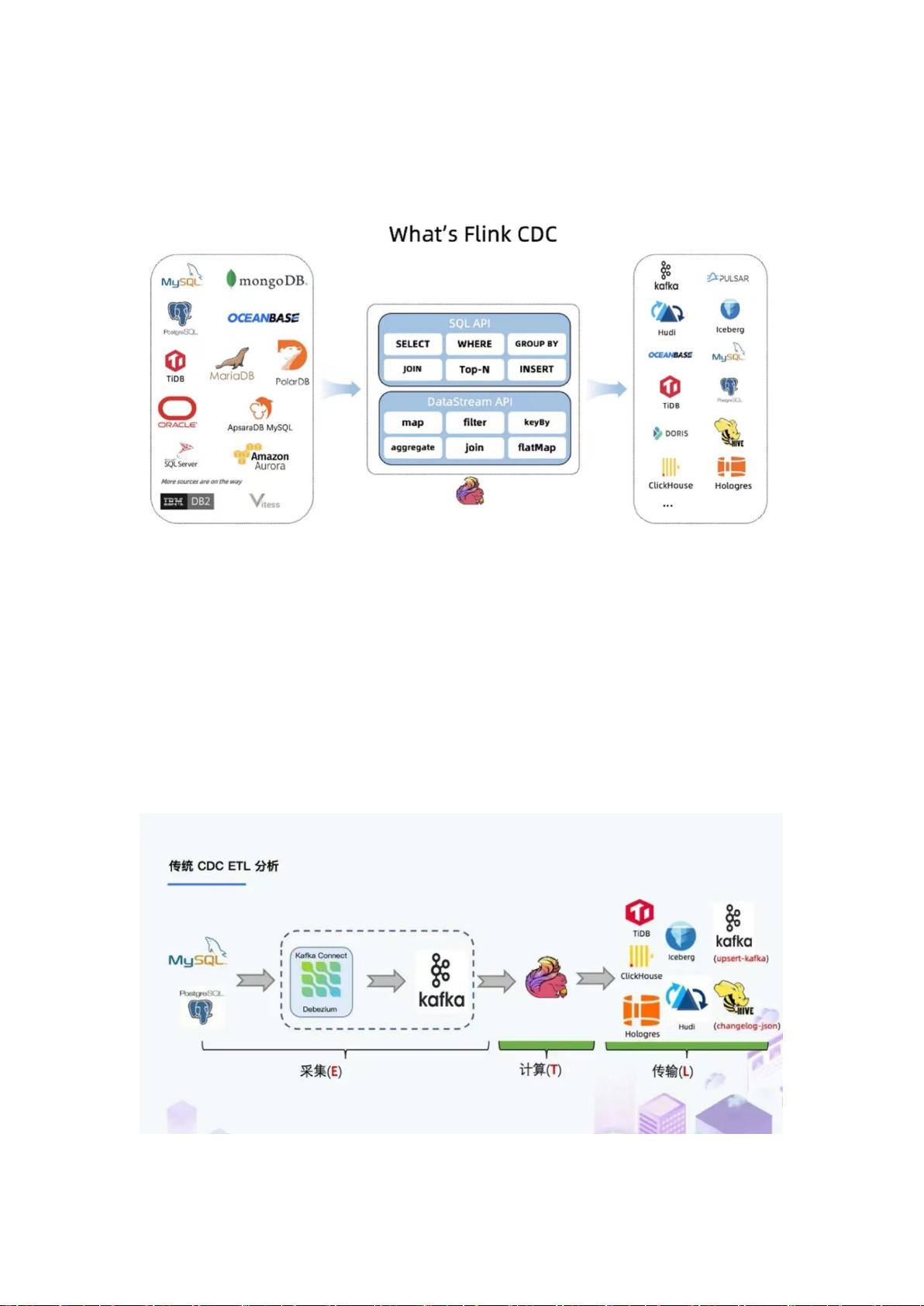

cdc技术分析文章,基于flink-cdc做监控数据源的实时变更数据捕获。该文从基础定义、使用场景、分析、实际使用流程、源码分析、常见问题及解决方式等几个方向讲解了这个技术栈。如果公司有要使用搜索方案,涉及到业务库数据同步至搜索库的业务需求可以下载看一下,相信对你会有一些帮助。具体公司的使用场景,需要在此方案上进行扩展。博主手中有基于flink-cdc、elasticSerach、kafka、zookeeper、nacos、Redis、springboot+springcloud、MySQL、mybatis-plus、jdk1.8等技术栈以及版本做的适用于公司搜索业务的自研代码,感兴趣的可以给我留言或者发私信,具体价格可以商量。 **基于Flink-CDC的实时变更数据捕获详解** **一、什么是CDC及选型** CDC(Change Data Capture)是一种技术,用于跟踪和捕获数据库中的数据变更。它分为两大类:基于查询的CDC,如DataX和Kettle,它们通过定期查询来获取变化;以及基于日志的CDC,如Debezium、Canal和Flink-CDC,后者通过解析数据库的日志来实时获取变更。Flink-CDC因其全增量一体化同步、分布式架构和强大的数据加工能力而备受青睐。 **二、为何使用CDC及适用场景** 随着实时性需求的增长,基于日志的CDC技术如Flink-CDC可以实现实时消费数据库日志,保证数据一致性,适用于需要实时数据的业务。而基于查询的工具如Kettle、DataX更适合数据抽取、转换和历史数据同步。 **三、为何选择Flink-CDC** Flink-CDC具有以下优势: 1. **全增量一体化同步**:Flink-CDC支持全量和增量同步,而其他开源方案可能不支持。 2. **分布式架构**:能应对大规模数据处理,避免单体架构的性能瓶颈。 3. **强大的数据加工能力**:Flink的SQL API和DataStream API提供丰富的transformation功能。 4. **丰富生态**:支持多种数据源和存储系统的对接,包括MySQL、MongoDB、ElasticSearch等。 **四、Flink-CDC对比传统ETL的优势** 1. **简化架构**:无需额外维护Canal或消息队列,直接依赖Flink进行全增量同步和实时ETL。 2. **高并发与稳定性**:并发读取大量数据,确保稳定输出。 3. **易于维护**:组件少,架构简洁。 **五、Flink-CDC的工作流程** 以MySQL为例,首先需在MySQL配置中启用Binlog。Flink-CDC会监听MySQL的Binlog,通过解析日志捕获变更,然后将变更数据通过Flink的Changelog格式写入目标存储,如Kafka、ElasticSearch等。新版本还支持动态加表、水平扩展和优化的增量快照读取算法,以提升效率和稳定性。 **六、Flink-CDC的特性** 1. **增量快照读取**:2.0版本引入了切片 checkpoint 粒度至chunk,可配置大小,优化writer压力和内存使用。 2. **动态扩展与无锁设计**:借鉴Netflix的DBlog paper实现全程无锁,支持水平扩展。 3. **新版本增强**:如支持更多数据库类型(OceanBase、PolarDB-X等),动态加表功能,以及对MongoDB的优化。 Flink-CDC是实现实时数据源监控和变更数据捕获的强大工具,其高效、稳定且具有广泛生态支持的特点,使得它在大数据实时处理领域具有广泛的应用前景。对于需要实现实时数据同步和ETL的企业来说,Flink-CDC是一个值得考虑的解决方案。

剩余12页未读,继续阅读

- 粉丝: 1

- 资源: 3

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

信息提交成功

信息提交成功

- 1

- 2

前往页