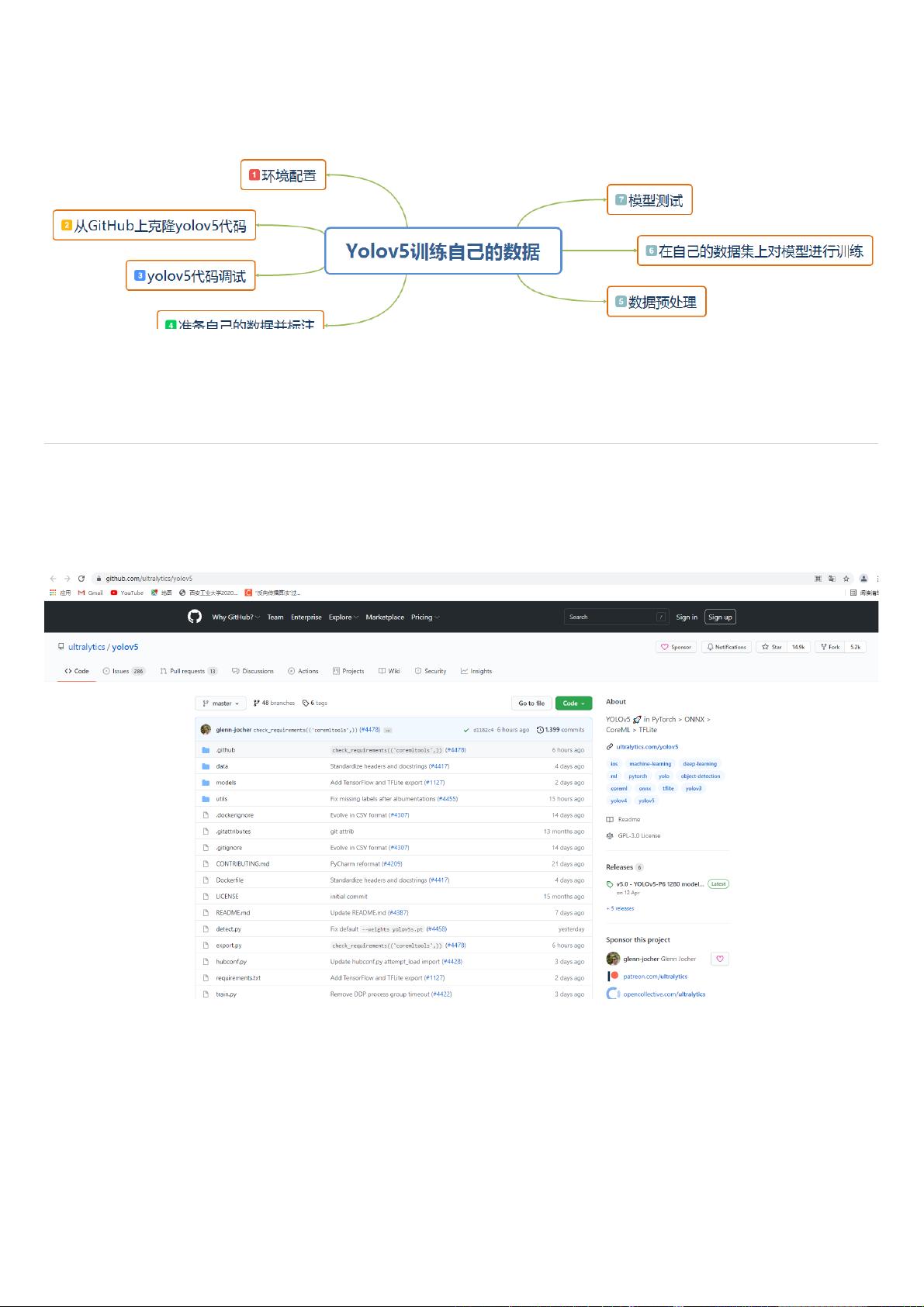

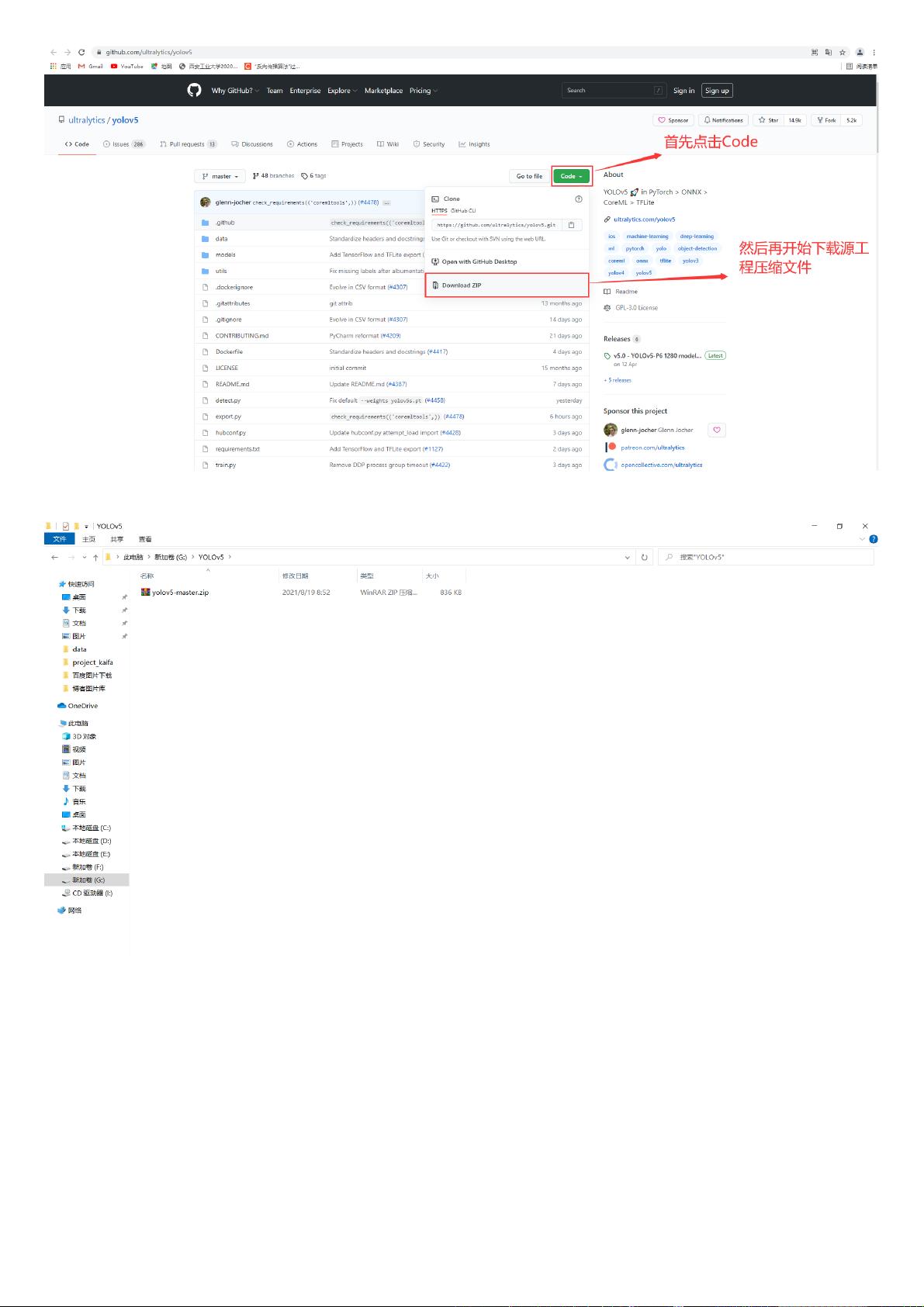

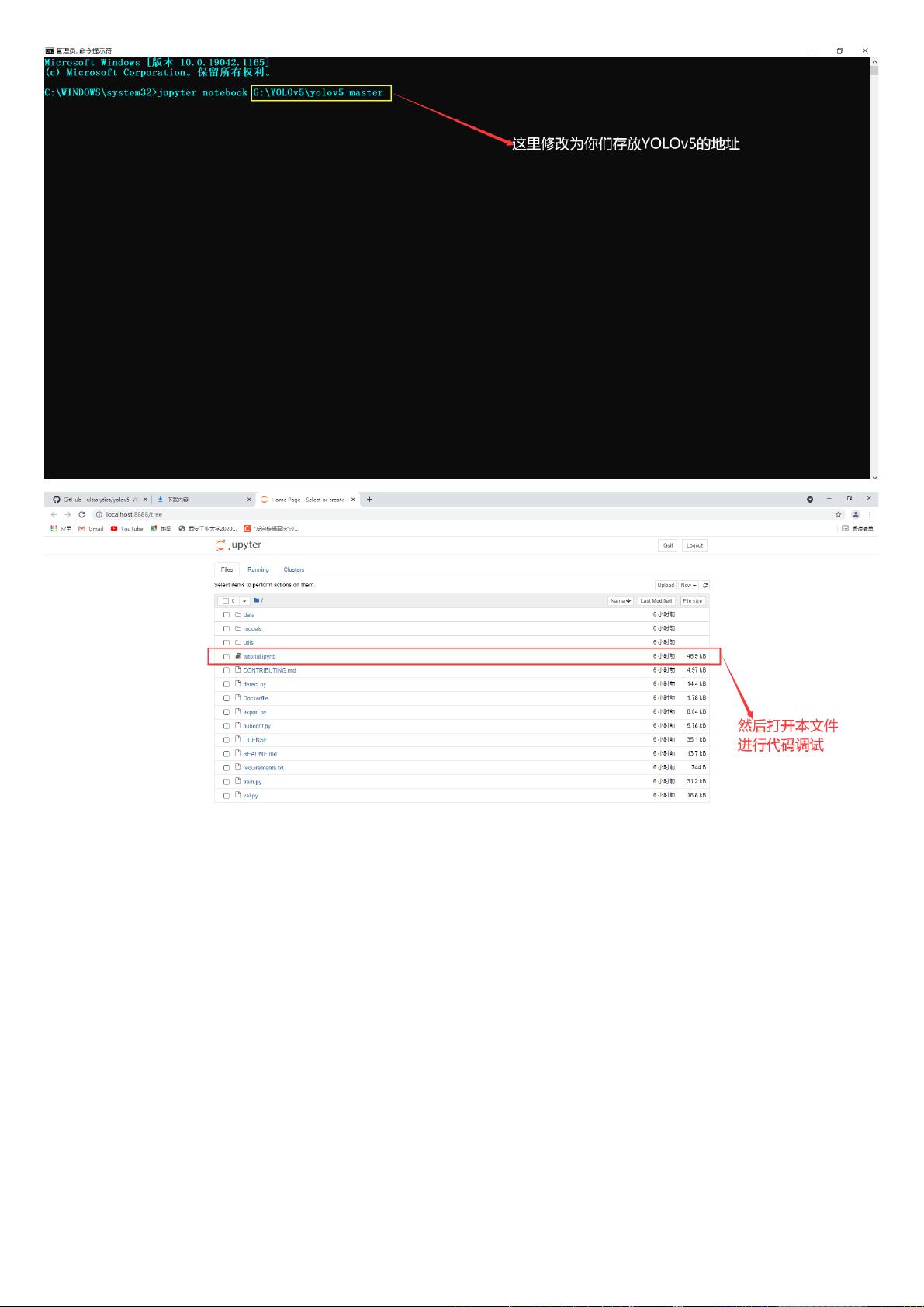

YOLO (You Only Look Once) 是一种实时目标检测系统,其设计目的是为了高效地进行物体检测。YOLOv5 和 YOLOv3 是该系列的两个版本,具有较高的精度和较快的速度。本篇文章主要讲解如何使用 YOLOv5 和 YOLOv3 训练自己的数据集。 训练自定义数据集的关键步骤之一是环境配置。这通常涉及到安装必要的软件和库,例如 TensorFlow-GPU 2.3.0、CUDA 10.1、cuDNN 7.6.4、PyTorch 1.9.0 和 Anaconda 3.8。这些组件需要与你的硬件兼容,特别是如果你打算利用 GPU 加速训练过程。 在配置环境之后,你需要从 GitHub 上获取官方的 YOLOv5 源代码。确保下载的是最新的、可靠的代码仓库,以便获得最佳的性能和更新。解压缩文件并将其放置在一个专门的文件夹中,以便管理和维护。 接下来,确保代码能够正确运行。安装 requirements.txt 文件中列出的所有依赖项,并使用 Jupyter Notebook 打开 tutorial.ipynb 文件进行调试。在这个过程中,你可能会遇到缺少预训练权重的问题,比如 yolov5s.pt。你可以从 GitHub 仓库中下载缺失的权重文件,并将其放在代码的 weights 文件夹中。 在调试代码并确认一切正常运行后,你可以开始准备自己的数据集。数据集应该包含你要检测的物体的图像,并且需要进行标注。图像应存放在 data/images 文件夹下,同时创建 data/dataset 和 data/labels 文件夹来分别存储处理后的数据集和对应的标签文件。标签文件通常由 labelimg 或其他类似的标注工具生成,如 RectLabel 或 VGG Image Annotator (VIA)。 标注完成后,数据集需要被划分为训练集和验证集,这可以通过修改 split.py 文件来实现。接着,根据 YOLOv5 的训练流程,你需要创建一个配置文件(如 train.yaml 或 custom.yaml),指定数据集路径、批大小、学习率等参数。然后,使用提供的训练脚本来开始训练: ```bash !python train.py --cfg custom.yaml --data data/custom.yaml --weights yolov5s.pt ``` 训练过程会迭代地优化网络权重,直到达到预设的迭代次数或满足其他停止条件。在训练过程中,模型的性能会定期在验证集上评估,以便监控进度。 训练好的模型可以用于推理,检测新的图像或视频流。例如,你可以使用 detect.py 脚本来检测图像或从摄像头捕获的实时视频: ```bash !python detect.py --weights ./weights/last.pt --img 640 --conf 0.25 --source data/images/ !python detect.py --weights ./weights/last.pt --source 0 ``` 训练 YOLOv5 或 YOLOv3 模型涉及多个步骤,包括环境配置、代码调试、数据集准备和标注、模型训练以及最终的应用。每个环节都需要仔细操作和验证,以确保模型能够准确地检测自定义的目标物体。通过遵循详尽的教程和文档,即使初学者也能成功完成这一过程。

剩余24页未读,继续阅读

- 粉丝: 1081

- 资源: 5280

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜最新资源

- COMSOL模拟热流固耦合作用下的二氧化碳驱替甲烷研究:探索煤层变形、孔渗变化及气体产量动态分析(含讲解视频),COMSOL模拟热流固耦合作用下的二氧化碳驱替甲烷过程:研究煤层变形、孔渗变化及气体产量

- 电子胸花.zip

- 基于Vue框架的地铁问答系统设计源码

- 多变流水灯控制电路.zip

- XMSinaSwift-Swift资源

- MATLAB课程作业-Matlab资源

- 基于Vue框架的青光眼诊断系统前端设计源码

- SpireCV-机器人开发资源

- Carsim Simulink联合仿真下的递推最小二乘法估计轮胎侧偏刚度模型详解:文档详实,代码规范实践,基于Carsim和Simulink联合仿真的递推最小二乘法估计轮胎侧偏刚度模型详解,Cars

- MXImagePicker-Kotlin资源

- nexfly-AI人工智能资源

- 宿迁市乡镇边界,shp格式

- minio-rsc-Rust资源

- 基于Maxwell模型的三相调速永磁同步电动机设计研究与实践-冲片设计与仿真案例,三相调速永磁同步电动机的Maxwell模型:高效能效、多极可调的电机设计方案与实践,三相调速永磁同步电动机maxwe

- 基于Flask框架的JavaScript驱动的web项目设计源码

- 湖州市乡镇边界,shp格式

信息提交成功

信息提交成功