没有合适的资源?快使用搜索试试~ 我知道了~

自然语言处理(NLP)

资源推荐

资源详情

资源评论

⾃然语⾔处理(NLP)

⾃然语⾔处理(⾃然语⾔处理(NLP))

主要研究⼈与计算机之间,使⽤⾃然语⾔进⾏有效通信的各种理论和⽅法。

⾃然语⾔处理的主要技术范畴⾃然语⾔处理的主要技术范畴

1、语义⽂本相似度分析

语义⽂本相似度分析是对两段⽂本的意义和本质之间的相似度进⾏分析的过程。

2、信息检索

信息检索是指将信息按⼀定的⽅式加以组织,并通过信息查找满⾜⽤户的信息需求的过程和技术。

3、 信息抽取

信息抽取是指从⾮结构化/半结构化⽂本(如⽹页、新闻、 论⽂⽂献、微博等)中提取指定类型的信息(如实体、属性、关系、事件、商品

记录等),并通过信息归并、冗余消除和冲突消解等⼿段将⾮结构化⽂本转换为结构化信息的⼀项综合技术。

4、⽂本分类

⽂本分类的任务是根据给定⽂档的内容或主题,⾃动分配预先定义的类别标签。

5、⽂本挖掘

⽂本挖掘是信息挖掘的⼀个研究分⽀,⽤于基于⽂本信息的知识发现。⽂本挖掘的准备⼯作由⽂本收集、⽂本分析和特征修剪三个步骤组

成。⽬前研究和应⽤最多的⼏种⽂本挖掘技术有:⽂档聚类、⽂档分类和摘要抽取。

6、⽂本情感分析

情感分析是⼀种⼴泛的主观分析,它使⽤⾃然语⾔处理技术来识别客户评论的语义情感,语句表达的情绪正负⾯以及通过语⾳分析或书⾯⽂

字判断其表达的情感等。

7、问答系统

⾃动问答是指利⽤计算机⾃动回答⽤户所提出的问题以满⾜⽤户知识需求的任务。不同于现有搜索引擎,问答系统是信息服务的⼀种⾼级形

式,系统返回⽤户的不再是基于关键词匹配排序的⽂档列表,⽽是精准的⾃然语⾔答案。

8、机器翻译

机器翻译是指利⽤计算机实现从⼀种⾃然语⾔到另外⼀种⾃然语⾔的⾃动翻译。被翻译的语⾔称为源语⾔(source language),翻译到的

语⾔称作⽬标语⾔(target language)。

机器翻译研究的⽬标就是建⽴有效的⾃动翻译⽅法、模型和系统,打破语⾔壁垒,最终实现任意时间、任意地点和任意语⾔的⾃动翻译,完

成⼈们⽆障碍⾃由交流的梦想。

9、⾃动摘要

⾃动⽂摘(⼜称⾃动⽂档摘要)是指通过⾃动分析给定的⼀篇⽂档或多篇⽂档,提炼、总结其中的要点信息,最终输出⼀篇长度较短、可读

性良好的摘要(通常包含⼏句话或数百字),该摘要中的句⼦可直接出⾃原⽂,也可重新撰写所得。

根据输⼊⽂本的数量划分,⽂本摘要技术可以分为单⽂档摘要和多⽂档摘要。 在单⽂档摘要系统中,⼀般都采取基于抽取的⽅法。⽽

对于多⽂档⽽⾔,由于在同⼀个主题中的不同⽂档中不可避免地存在信息交叠和信息差异,因此如何避免信息冗余,同时反映出来⾃

不同⽂档的信息差异是多⽂档⽂摘中的⾸要⽬标,⽽要实现这个⽬标通常以为着要在句⼦层以下做⼯作,如对句⼦进⾏压缩,合并,

切分等。另外,单⽂档的输出句⼦⼀般是按照句⼦在原⽂中出现的顺序排列,⽽在多⽂档摘要中,⼤多采⽤时间顺序排列句⼦,如何

准确的得到每个句⼦的时间信息,也是多⽂档摘要需要解决的⼀个问题。

10、语⾳识别

语⾔识别指的是将不同语⾔的⽂本区分出来。其利⽤语⾔的统计和语法属性来执⾏此任务。语⾔识别也可以被认为是⽂本分类的特殊情况

分词(切词)分词(切词)

分词是⾃然语⾔处理的基础,分词准确度直接决定了后⾯的词性标注、句法分析、词向量以及⽂本分析的质量。

前向最⼤匹配算法前向最⼤匹配算法

分词的⽬的是将⼀段中⽂分成若⼲个词语,前向最⼤匹配就是从前向后寻找在词典中存在的词。

例⼦:

假设Max_len = 5,即假设单词的最⼤长度为5。 再假设我们现在词典中存在的词有: [“我们”, “经常”,“常有”, “有意

见”,“有意”, “意见”, “分歧”, “我”,“们”,“经”,“常”,“有”,“意”,“见”]

现在,⽤前向最⼤匹配算法 来划分 我们经常有意见分歧 这句话。

我们经常有意见分歧(max_len = 5)

第⼀轮:取⼦串 “我们经常有”,正向取词,如果匹配失败,每次去掉匹配字段 最后⾯ 的⼀个字。

1. “我们经常有”,扫描词典中的5字单词,没有匹配,⼦串长度减 1 变为“我们经常”。

2. “我们经常”,扫描词典中的4字单词,没有匹配,变为“我们经”。

3. “我们经”,扫描词典中的3字单词,没有匹配, 变为“我们”。

4. “我们”,扫描词典中的2字单词,匹配成功,输出“我们”,输⼊变为 “经常有意见分歧” 。

第⼆轮:取⼦串“经常有意见”

1. “经常有意见”,扫描词典中的5字单词,没有匹配,⼦串长度减 1 变为“经常有意”。

2. “经常有意”,扫描词典中的4字单词,没有匹配,⼦串长度减 1 变为“经常有”。

3. “经常有”,扫描词典中的3字单词,没有匹配,⼦串长度减 1 变为“经常”。

4. “经常”,扫描词典中的2字单词,有匹配,输出“经常”,输⼊变为“有意见分歧”。

以此类推,直到输⼊长度为0时,扫描终⽌。 最终,前向最⼤匹配算法得出的结果为: 我们 / 经常 / 有意见 / 分歧

N-gram算法算法

朴素贝叶斯:朴素贝叶斯:

朴素贝叶斯法是贝叶斯定理与特征条件独⽴性假设的分类⽅法。

最为⼴泛的两种分类模型是决策树模型和朴素贝叶斯模型。

朴素贝叶斯的思想基础是这样的:对于给出的待分类项,求解在此项出现的条件下各个类别出现的概率,哪个最⼤,就认为此待分类项属于

哪个类别。

整个朴素贝叶斯分类分为三个阶段:

第⼀阶段:准备⼯作阶段,这个阶段的任务是为朴素贝叶斯分类做必要的准备,主要⼯作是根据具体情况确定特征属性,并对每个特征属性

进⾏适当划分,然后由⼈⼯对⼀部分待分类项进⾏分类,形成训练样本集合。这⼀阶段的输⼊是所有待分类数据,输出是特征属性和训练样

本。这⼀阶段是整个朴素贝叶斯分类中唯⼀需要⼈⼯完成的阶段,其质量对整个过程将有重要影响,分类器的质量很⼤程度上由特征属性、

特征属性划分及训练样本质量决定。

第⼆阶段:分类器训练阶段,这个阶段的任务就是⽣成分类器,主要⼯作是计算每个类别在训练样本中的出现频率及每个特征属性划分对每

个类别的条件概率估计,并将结果记录。其输⼊是特征属性和训练样本,输出是分类器。这⼀阶段是机械性阶段,根据前⾯讨论的公式可以

由程序⾃动计算完成。

第三阶段:应⽤阶段。这个阶段的任务是使⽤分类器对待分类项进⾏分类,其输⼊是分类器和待分类项,输出是待分类项与类别的映射关

系。这⼀阶段也是机械性阶段,由程序完成。

⽐如:

朴素贝叶斯模型就是要衡量这句话属于垃圾短信敏感句⼦的概率。

朴素贝叶斯将句⼦处理为⼀个词袋模型(Bag-of-Words, BoW),以⾄于不考虑每个单词的顺序。

N-gram 模型就是考虑句⼦中单词之间的顺序。

N-gram

N-gram模型是⼀种语⾔模型(Language Model,LM),语⾔模型是⼀个基于概率的判别模型,它的输⼊是⼀句话(单词的顺序序

列),输出是这句话的概率,即这些单词的联合概率(joint probability)。

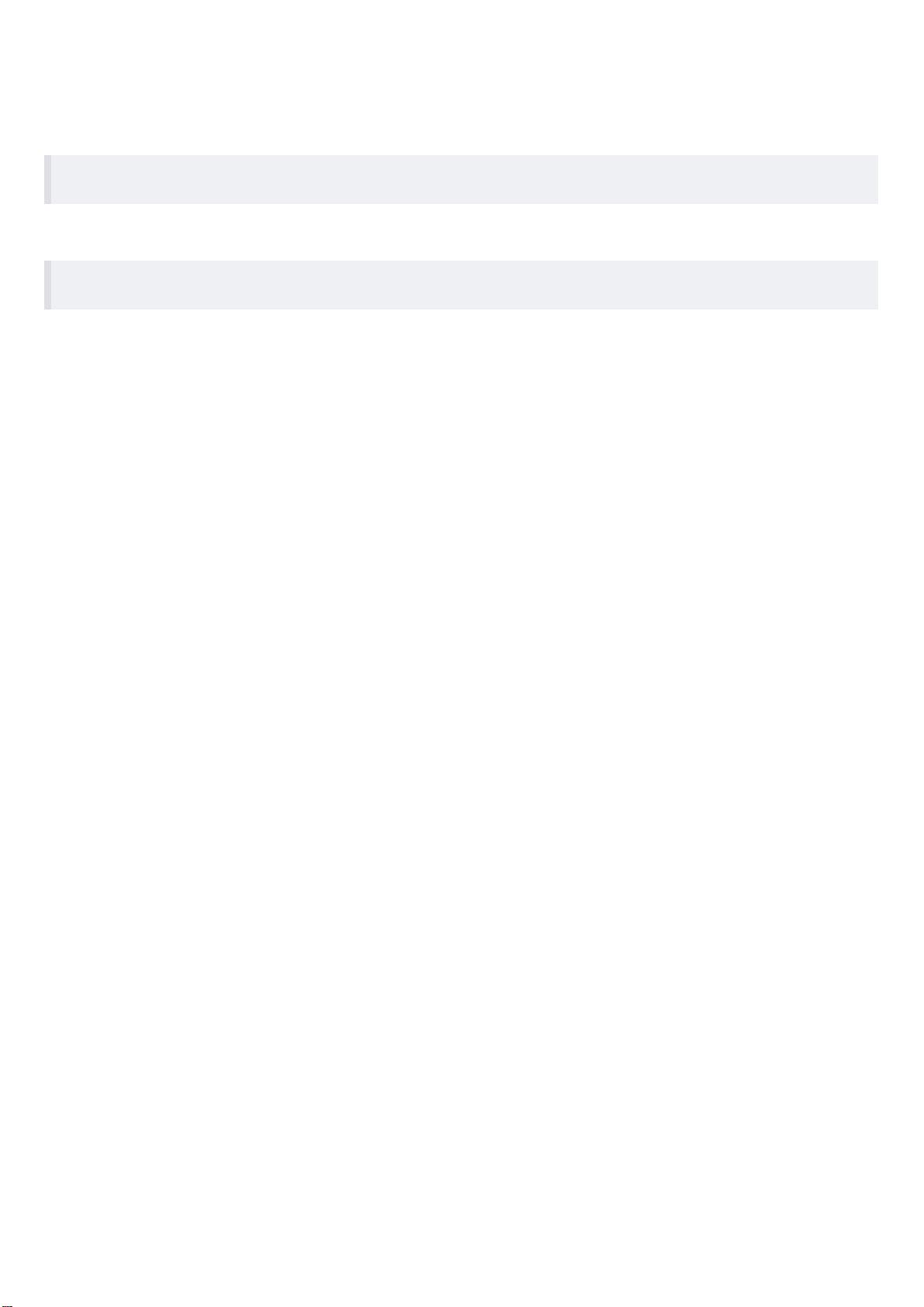

N-gram本⾝也指⼀个由N个单词组成的集合,各单词具有先后顺序,且不要求单词之间互不相同。常⽤的有 Bi-gram (N = 2) 和 Tri-

gram (N = 3)

例如: I love deep learning

⽤途

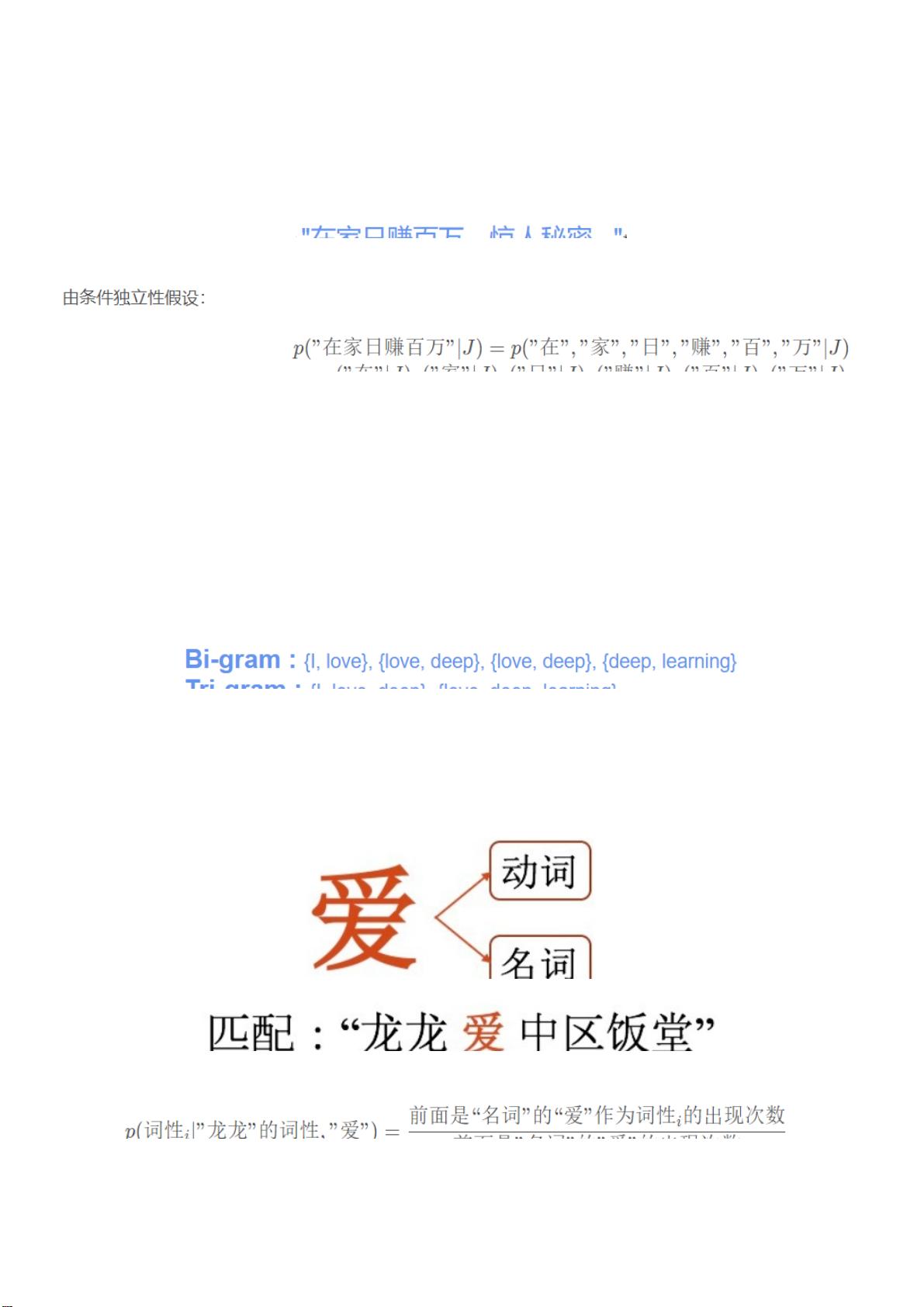

1、词性标注

N-gram可以实现词性标注。例如“爱”这个词,它既可以作为动词使⽤,也可以作为名词使⽤。不失⼀般性,假设我们需要匹配⼀句话

中“爱”的词性。

我们可以将词性标注看成⼀个多分类问题,按照Bi-gram计算每⼀个词性概率:

选取概率更⼤的词性(⽐如动词)作为这句话中“爱”字的词性。

2、垃圾短信分类

步骤⼀:给短信的每个句⼦断句。

剩余10页未读,继续阅读

资源评论

上山砍菜

- 粉丝: 0

- 资源: 225

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功