没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

Hadoop HDFS 安装和管理

1. HDFS 安装

1.1. 环境准备

由于相对 hdfs 的客户端存在相对路径问题,参见《Hadoop HDFS 开发参考》,我们修改

了 hadoop-0.18.1 的源码并进行了重新编译,代码为 forlink-hadoop.tar.gz。

HDFS 中,节点分为 Namenode 和 Datanode,其中 Namenode 只有一个(可以通过

《Hadoop HDFS 系统双机热备方案》配置两台,但同时只能有一台提供服务),Datanode 可

以有多台。

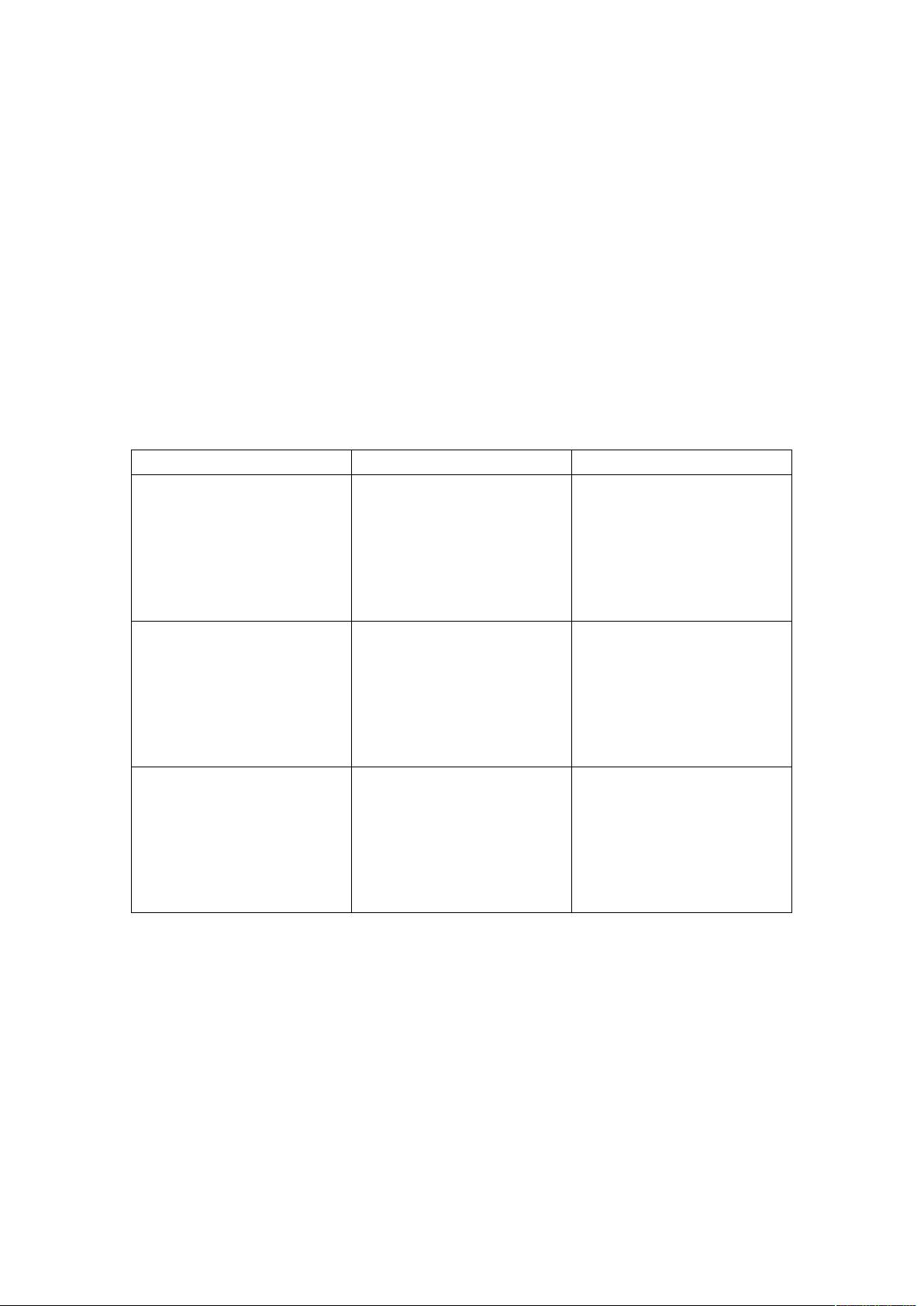

主机

IP 地址

配置

ost2 (Namenode 的主节点)

eth0: 192.168.188.202

eth1: 10.0.0.202 (HA 心 跳 使

用地址)

eth0:0: 192.168.188.201(虚拟

IP)

容量:80G

接口标准:IDE

转速:7200rpm

缓存容量:2M

平均寻道时间:9ms

传输标准:ATA 133

ost3(Namenode 的从节点)

eth0: 192.168.188.203

eth1: 10.0.0.203 (HA 心 跳 使

用地址)

eth0:0: 192.168.188.201(虚拟

IP)

容量:80G

接口标准:IDE

转速:7200rpm

缓存容量:2M

平均寻道时间:9ms

传输标准:ATA 133

ost4(Datanode)

eth0: 192.168.188.204

容量:80G

接口标准:IDE

转速:7200rpm

缓存容量:2M

平均寻道时间:9ms

传输标准:ATA 133

1、修改主机名

在所有节点都要执行此操作,在 202 上:

vi /etc/sysconfig/network

NETWORKING=yes

HOSTNAME=ost2

在 203 上为

HOSTNAME=ost3

在 204 上为

HOSTNAME=ost4

2、创建 hdfs 用户

Hadoop 要求所有机器上 hadoop 的部署目录结构要相同,并且都有一个相同的用户名的

帐户。在所有节点上创建 hdfs 用户:

用户名 hdfs,口令 hdfs,主目录是/home/hdfs。

3、添加节点到/etc/hosts(在所有节点上执行此操作,其中 192.168.188.201 是虚拟 IP)

127.0.0.1 localhost.localdomain localhost

192.168.188.201 ostvip

192.168.188.203 ost3

192.168.188.202 ost2

192.168.188.204 ost4

10.0.0.202 ost2

10.0.0.203 ost3

可以在 ost2 修改,然后拷贝到其他节点(需 root 权限)

scp /etc/hosts ost3:/etc/hosts

scp /etc/hosts ost4:/etc/hosts

1.2. HDFS 部署(ost2 上)

1、以 hdfs 用户登录,在主目录下创建子目录 hdfsinstall

2、在 hdfsinstall 目录下解压缩文件,将解压到 hadoop-0.18.1 目录

tar xvzf forlink-hadoop.tar.gz

3、创建链接

ln -s hadoop-0.18.1 hadoop

4、创建配置目录

mkdir /home/hdfs/hdfsinstall/hadoop-config

5、将 /home/hdfs/hdfsinstall/hadoop/conf/目录中的文件拷贝到 hadoop-config 目录中

6、指定环境变量$HADOOP_CONF_DIR

在/home/hdfs/.bash_profile 中添加

HADOOP_CONF_DIR=/home/hdfs/hdfsinstall/hadoop-config/

export HADOOP_CONF_DIR

7、下载 jdk-1_5_x-rc-linux-i586.bin。

8、运行

./ jdk-1_5_x-rc-linux-i586.bin

安装完毕,JDK 安装在/home/hdfs/hdfsinstall/jdk1.5.0_16 目录下

9、创建链接:ln –s jdk1.5.0_16 jdk

10、设置环境变量(写入 hdfs 用户的.bash_profile 中)

JAVA_HOME=/home/hdfs/hdfsinstall/jdk

export JAVA_HOME

PATH=$JAVA_HOME/bin:$JAVA_HOME/jre/bin:$PATH

export PATH

CLASSPATH=$JAVA_HOME/lib:$JAVA_HOME/jre/lib

export CLASSPATH

11、创建子目录 filesystem

cd /home/hdfs/hdfsinstall

mkdir filesystem

1.3. Hadoop 配置

cd $HADOOP_CONF_DIR,进入/home/hdfs/hdfsinstall/hadoop-config 目录

1、masters 文件(这里指定虚拟 ip 作为名字节点,指定 Secondary Namenode)

192.168.188.201

2、slaves 文件(指定数据节点)

192.168.188.204

3、修改 hadoop-env.sh

export JAVA_HOME=/home/hdfs/hdfsinstall/jdk

4、hadoop-site.xml

在 hadoop-site.xml 里面定义我们需要的项,其值会覆盖 hadoop-default.xml 中的默认值:

<?xml version="1.0"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<!-- Put site-specific property overrides in this file. -->

<configuration>

<property>

<name>fs.default.name</name>

<value> hdfs://192.168.188.201:9000 </value>

<description> namenode 的配置,机器名加端口 </description>

</property>

<!-- map/reduce properties -->

<property>

<name>mapred.job.tracker</name>

<value> hdfs://192.168.188.201:9001 </value>

<description> JobTracker 的配置,机器名加端口

</description>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value> /mnt/drbd/hdfs/tmp </value>

<description> Hadoop 的默认临时路径,这里设置在双机的共享位置</description>

</property>

<property>

<name>dfs.name.dir</name>

<value> /mnt/drbd/hdfs/name</value>

<description>存储名字节点信息的位置,这里设置在双机的共享位置

</description>

</property>

<property>

<name>dfs.data.dir</name>

<value>/home/hdfs/hdfsinstall/filesystem/data</value>

<description>存储文件系统数据的位置,在每个数据节点上。

</description>

</property>

<property>

<name>dfs.replication</name>

<value>2</value>

<description>数据需要备份的数量,默认是 3

</description>

</property>

<property>

<name>dfs.permissions.supergroup</name>

<value>hdfs</value>

<value>liang</value>

<description>super-users,可以添加多个用户</description>

</property>

</configuration>

2、修改 hadoop-env.sh

export JAVA_HOME=/home/hdfs/hdfsinstall/jdk

1.4. 创建目录(ost2)

1 root 执行

chmod 777 /mnt/drbd

2 创建 hdfs 目录(hdfs 用户)

mkdir /mnt/drbd/hdfs

3 创建临时目录(hdfs 用户)

mkdir /mnt/drbd/hdfs/tmp

4 创建名字节点元数据目录

mkdir /mnt/drbd/hdfs/name(hdfs 用户)

5 创建数据节点目录(所有节点上)(hdfs 用户)

mkdir /home/hdfs/hdfsinstall/filesystem/data

1.5. 数据节点存活性和副本配置

每个数据节点周期性地向名字节点发送心跳信号。网络割裂可能导致一部分数据节点

剩余20页未读,继续阅读

资源评论

小小哭包

- 粉丝: 1899

- 资源: 3854

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功