没有合适的资源?快使用搜索试试~ 我知道了~

第三期《MindFormers套件之大模型Lora微调》

10 下载量 50 浏览量

2023-10-18

11:34:08

上传

评论

收藏 3.21MB PPTX 举报

温馨提示

试读

22页

第三期《MindFormers套件之大模型Lora微调》

资源推荐

资源详情

资源评论

MindFormers大模型使能套件:

《大模型Lora微调》

SecurityLevel:

PANTONE 186C

RGB 200/16/46

PANTONE 185C

RGB 199/0/11

品牌色

RGB 234/90/79

RGB 120/0/15

辅助色

RGB 248/181/60

RGB 235/92/1

RGB 137/137/137

RGB 35/24/21

RGB 221/221/221

RGB 233/140/128

RGB 159/0/1

RGB 245/220/87

RGB 240/133/0

RGB 181/181/181

RGB 89/87/87

RGB 255/255/255

HuaweiConfidential

2

课程总览

MindSpore Transformers 大模型使能套件赋能培训系列一览

课程

时间 讲师

简介

第一期《MindFormers套件之架构讲解与使用入门》

20230810周四

19:00-20:30

何青林

介绍MindFormers大模型套件现状,讲解套件架构及高阶接口设计,走读工程架构模块代码,学习基

本使用方式。

第二期《MindFormers套件之大模型预训练和并行特性》

20230815周二

19:00-20:00

何青林/张又文/张森镇

1. 介绍MindFormers大模型套件分布式并行特性;

2. 讲解LLM大模型预训练(Llama为例)流程;

3. 讲解大规模分布式切片权重切分转换特性设计与使用(离线切分和在线切分);

第三期《MindFormers套件之大模型Lora微调》

20230817周四

19:00-20:00

苏海波/黄欣靓/张浩勇

1. 介绍MindFormers大模型套件适配MindPet架构设计;

2. 讲解LLM大模型适配Lora微调算法流程和SFT数据集制作流程(Llama为例);

3. 介绍MindFormers大模型套件恢复训练特性和使用方式;

第四期《MindFormers套件之在线推理和文本生成》

20230822周二

19:00-20:00

张浩勇/黄磊

1. 介绍LLM大模型在线分布式推理(Llama为例)特性,讲解增量推理、流式推理等原理和用途,走

读代码;

2. 演示Chat Web功能;

第五期《MindFormers套件之大模型调试调优》

20230824周四

19:00-20:00

邀请中软MindSpore大模

型专家

介绍MindSpore2.1版本及特性,讲解大模型训练、推理等各类性能优化和debug技巧;

第六期《MindFormers套件之大模型开发实践》

20230829周二

19:00-20:00

李臻皓 介绍如何使用MindFormers已有架构和高阶API开发新的大模型,适配Lora微调、评测、推理等;

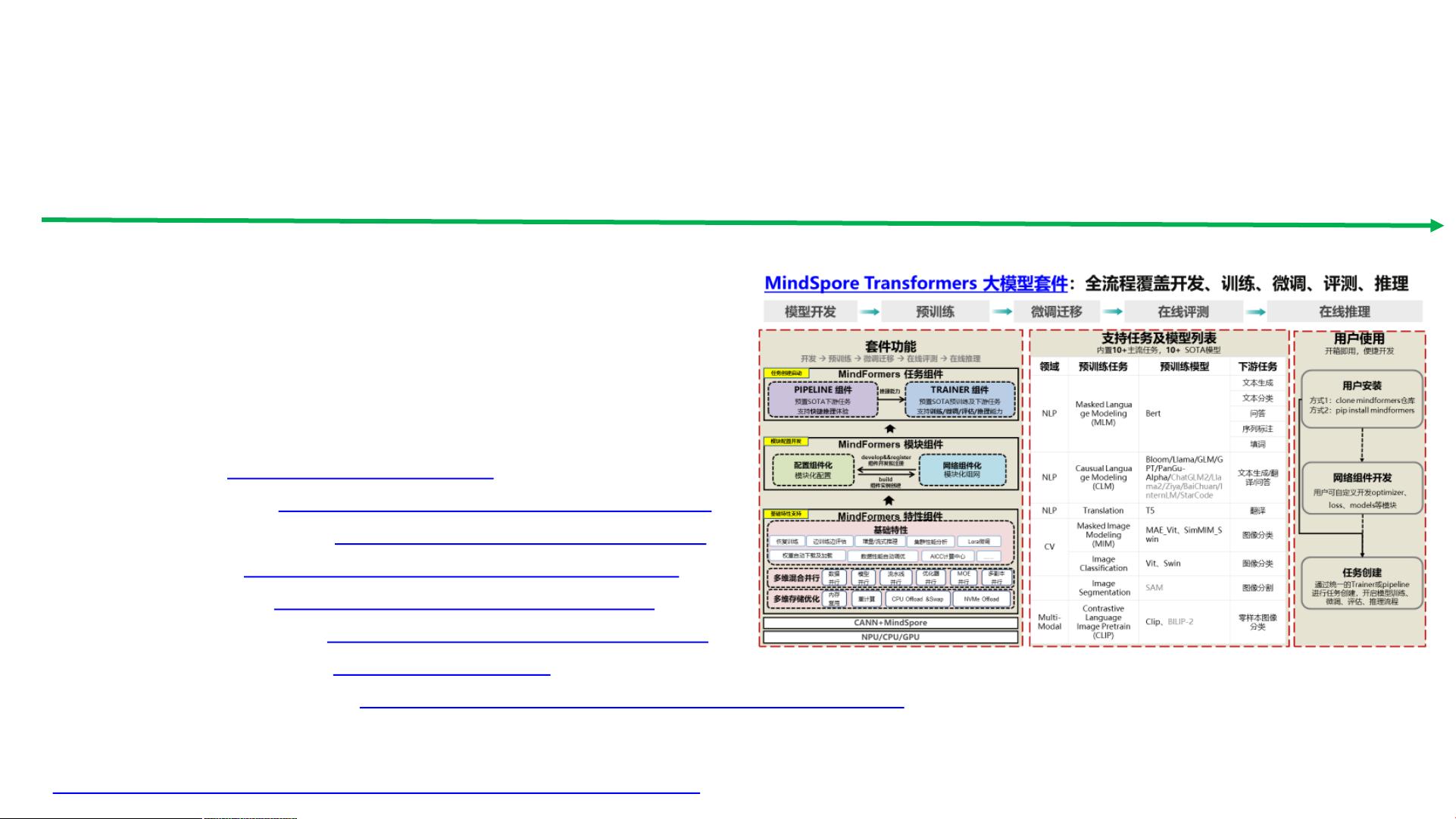

《MindFormers大模型套件架构讲解与使用入门》

• 套件核心架构设计、工程目录讲解,代码走读;

• 套件支持任务/模型、基础特性、使用方式等介绍;

• 套件当前使用文档和其他套件配套关系介绍;

MindSporeTransformers套件的目标是构建一个大模型开发、训练、微调、评估、推理、部署的全流程开发

套件,提供业内主流的Transformer类预训练模型和SOTA下游任务应用,涵盖丰富的并行特性。

学习材料:

• Ascend(昇腾):https://www.hiascend.com/zh/

• MindSpore(AI框架):https://mindspore.cn/docs/zh-CN/r2.1/index.html

• MindFormers(大模型套件):https://gitee.com/mindspore/mindformers

• MindFormers文档:https://mindformers.readthedocs.io/zh_CN/latest/

• MindPet(微调套件):https://github.com/mindspore-lab/mindpet

• MindRLHF(强化学习套件):https://github.com/mindspore-lab/mindrlhf

• MindSpore Lite(部署推理):https://mindspore.cn/lite

• MindInsight(可视化调试调优):https://mindspore.cn/mindinsight/docs/zh-CN/r2.1/index.html

第一期培训材料与视频归档地址:

https://onebox.huawei.com/p/24b16a3820251cd0c35460a60480ca02

《MindFormers大模型预训练和并行特性》

• 介绍MindFormers大模型套件分布式并行特性;

https://mindformers.readthedocs.io/zh_CN/latest/docs/design/Parallel_Design.html

• 讲解LLM大模型预训练(Llama为例)流程;

• 讲解大规模分布式切片权重切分转换特性设计与使用(离线切分和在线切分);

https://gitee.com/mindspore/mindformers/blob/82b97fe00b781156d5f78547f1664dcc1940fcf2/docs/feature_cards/Transform_Ckpt.md

MindSporeTransformers套件的目标是构建一个大模型开发、训练、微调、评估、推理、部署的全流程开发

套件,提供业内主流的Transformer类预训练模型和SOTA下游任务应用,涵盖丰富的并行特性。

第二期培训材料与视频归档地址:

https://onebox.huawei.com/p/ceaa97b5f190186623c006254177ef63

PANTONE 186C

RGB 200/16/46

PANTONE 185C

RGB 199/0/11

品牌色

RGB 234/90/79

RGB 120/0/15

辅助色

RGB 248/181/60

RGB 235/92/1

RGB 137/137/137

RGB 35/24/21

RGB 221/221/221

RGB 233/140/128

RGB 159/0/1

RGB 245/220/87

RGB 240/133/0

RGB 181/181/181

RGB 89/87/87

RGB 255/255/255

HuaweiConfidential

5

TABLEOFCONTENTS

目录

1

MindFormers适配MindPet架构设计

3

SFT数据集制作流程(Llama为例)

2

LLM大模型适配Lora微调算法流程

4

MindFormers套件恢复训练特性和使用方式

剩余21页未读,继续阅读

资源评论

昇思MindSpore

- 粉丝: 7806

- 资源: 5

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功