没有合适的资源?快使用搜索试试~ 我知道了~

智慧城市人工智能开放平台建设方案.docx

1.该资源内容由用户上传,如若侵权请联系客服进行举报

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

版权申诉

0 下载量 90 浏览量

2022-11-13

16:44:54

上传

评论

收藏 1.07MB DOCX 举报

温馨提示

试读

52页

智慧城市人工智能开放平台建设方案.docx智慧城市人工智能开放平台建设方案.docx

资源推荐

资源详情

资源评论

智慧城市人工智能开放平台建设方案

1. 架构设计

1.1. 总体架构设计

人工智能平台系统底层基于人工智能和大数据平台构建,在 x86 服务器之上

提供数据的采集、存储、计算、算法模型和前端展现等功能。 人工智能平台和

IoT 提供人体识别、行为识别、倾倒行为分析等算法的建模和训练能力;人工智

能平台 边缘平台则处理街道、小区大门等前端摄像头设备数据的实时接入和监

管,并提供模型部署、规则设计等功能。基于平台,提供倾倒行为识别系统,并

开放数据传输接口,用于倾倒行为信息等样本信息的导入和导出。

系统架构涉及到的组件由底向上详细信息如下:

1.1.1. 容器操作系统

云平台系统是为大数据应用量身订做的云操作系统,基于

Docker 和

Kubernetes 开发。支持一键部署,基于优先级的抢占式资源调度和细粒度资源分

配,让大数据应用轻松拥抱云服务。

未来企业对于构建统一的企业大数据平台来驱动各种业务具有强烈需求,统

一的企业大数据平台需要提供以下功能:

➢

资源弹性共享—提高资源利用率

灵活部署:支持灵活部署大数据应用和其他常规应用

资源调度:具备自动扩容和自动修复功能

服务发现:具备集中式的仓库

➢

隔离性—保障服务质量和安全性

数据隔离:包括数据源、访问模式等

计算隔离:隔离 CPU、内存、网络、磁盘 IO 等

容器操作系统满足了以上企业大数据平台的需要,支持对 TDH 的一键式部

署、扩容、缩容,同时也允许其他服务和大数据服务共享集群,从而提高资源的

使用率。容器操作系统创新的抢占式资源调度模型能在保障实时业务的同时,提

高集群空闲时的资源占用,让批量作业和实时业务在互不干扰的情况下分时共享

计算资源。

另外,在容器操作系统上运行的平台还引入微服务的架构,显著地降低了用

户部署环境对稳定性的影响,提高了部署的可用性,并且能让用户在不停机的前

提下,享受到将来更新版本的升级以及修复。

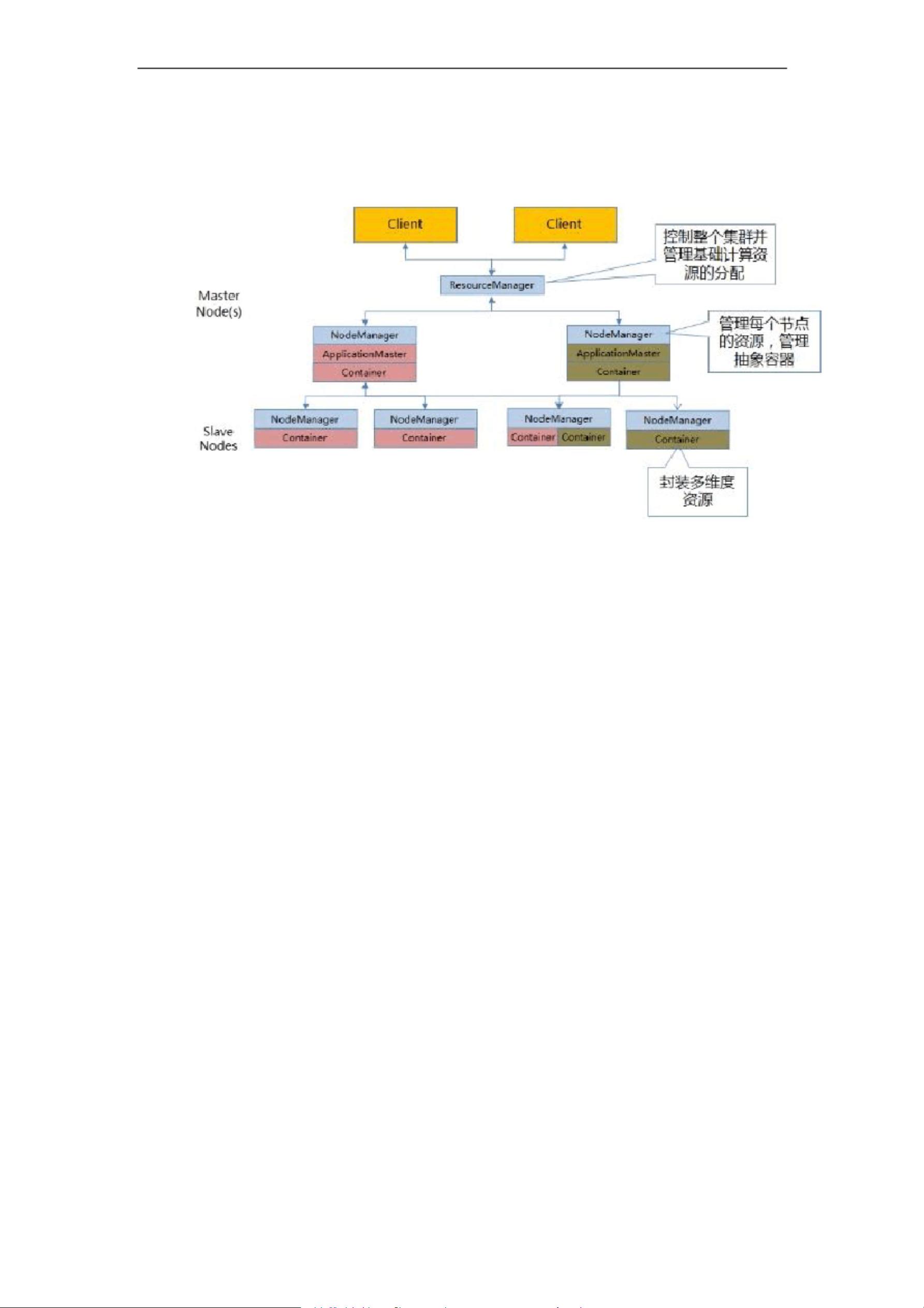

1.1.2. 资源管理调度系统 YARN

YARN(Yet Another Resource Negotiator)是一种新的 Hadoop 资源管理器,

它是一个通用资源管理系统,可为上层应用提供统一的资源管理和调度,它的引

入为集群在利用率、资源统一管理和数据共享等方面带来了巨大好处。

YARN 的基本思想是将 JobTracker 的两个主要功能(资源管理和作业调度/

监控)分离,主要方法是创建一个全局的ResourceManager(RM)和若干个针对

应用程序的 ApplicationMaster(AM)。

这里的应用程序是指传统的 MapReduce 作业或作业的 DAG(有向无环图)。

YARN 分层结构的本质是 ResourceManager。这个实体控制整个集群并管理

应用程序向基础计算资源的分配。ResourceManager 将各个资源部分(计算、内

存 、 带 宽 等 ) 精 心 安 排 给 基 础 NodeManager ( YARN 的 每 节 点 代 理 )。

ResourceManager 还与 ApplicationMaster 一起分配资源,与 NodeManager 一起启

动和监视它们的基础应用程序。在此上下文中,ApplicationMaster 承担了以前的

TaskTracker的一些角色,ResourceManager 承担了 JobTracker 的角色。

ApplicationMaster 管理一个在 YARN 内运行的应用程序的每个实例。

ApplicationMaster 负责协调来自 ResourceManager 的资源,并通过 NodeManager

监视容器的执行和资源使用( CPU、内存等的资源分配)。从 YARN 角度讲,

ApplicationMaster 是 用 户 代 码 , 因 此 存 在 潜 在 的 安 全 问 题 。 YARN 假 设

ApplicationMaster 存在错误或者甚至是恶意的,因此将它们当作无特权的代码对

待。

NodeManager 管理一个 YARN 集群中的每个节点。NodeManager 提供针对

集群中每个节点的服务,从监督对一个容器的终生管理到监视资源和跟踪节点健

康。MRv1 通过插槽管理 Map 和 Reduce 任务的执行,而 NodeManager 管理抽象

容器,这些容器代表着可供一个特定应用程序使用的针对每个节点的资源。

YARN 继续使用 HDFS 层。它的主要 NameNode 用于元数据服务,而 DataNode

用于分散在一个集群中的复制存储服务。

➢

集群的计算资源管理

YARN支持同时对 CPU 和内存资源的管理能力,YARN和分布式存储系统

部署在同一个物理集群中,达到分布式计算中数据优先本地化计算的目的,避免

计算过程中数据需要全部从网络获取。

通过 YARN 管理集群计算资源,当任意应用启动时,提交应用的 Client 向

YARN 的 ResourceManager 申请资源,ResourceManager 为该应用寻找合适的服

务器,从 NodeManager 获取一定的内存和 CPU 封装为一个 Container,并在这个

容器中启动 ApplicationMaster,部署该应用的核心代码等。然后 ResourceManager

再为该应用从所有的 NodeManager 中获取所需的资源,分装成多个 Container 供

该应用计算使用。

当应用需要停止时,YARN销毁该应用占用的资源,并且回收,供后续的应

用使用。

通过以上方式,YARN 为每个应用分配一定的 CPU 和内存,在集群资源允

许的情况下使得每个应用都能得到足够的资源运行。但是 YARN 只能做到 CPU

和内存的计算资源管理和隔离,没有做到网络和磁盘 IO 的隔离。

➢

资源占用模式

TDH 平台在一个 Inceptor/Spark 计算集群内部同样能实现计算资源在不同资

源池(Pool)的共享与隔离,通过公平调度算法保证高优先级的 Pool 优先拿到闲

置资源,同时每个 Pool 具有指定的资源保有量,避免高负载批处理业务占用全

部计算资源。同时,这种机制也能支持服务类的业务长期占用一定量的资源。

➢

资源的分配和回收

在 Yarn上,可以非常方便的动态创建和销毁 Spark 或者 Map/Reduce 集群。

对于用户提交的 MapReduce 以及 Spark 作业以及 Inceptor 集群,需要提交到其

有权限的队列中,向 Yarn 申请资源,当用户当集群中节点上有足够的资源满足

作业中 task 的要求并且没有达到该用户资源使用上线时,Yarn 中将这部分 CPU

和内存资源封装成 container,提供给 task 运行;如果剩余的资源量不足以满足计

算所申请的资源,则任务需要排队。作业任务运行完成后动态销毁,释放占用的

CPU 与内存资源。因此,对于平台分析应用,可以充分使用 Yarn的特性,实现

分析集群的按需创建与销毁,从而帮助实现资源、计算能力的统一调度和规划。

➢

资源配额

在 Yarn 中通过 Fair Scheduler 管理调度策略,支持定义用户最低获取资源,

以及最高获取资源,用户提交任务时所占用的最低资源不低于分配给用户的最低

资源,在空余资源的情况下,最高资源能够达到分配给用户的最高资源。在其他

任务需要资源时,根据优先级决定资源分配情况,如果优先级不够,支持抢占式

调度,能够将低优先级作业占用的多余资源释放出来。

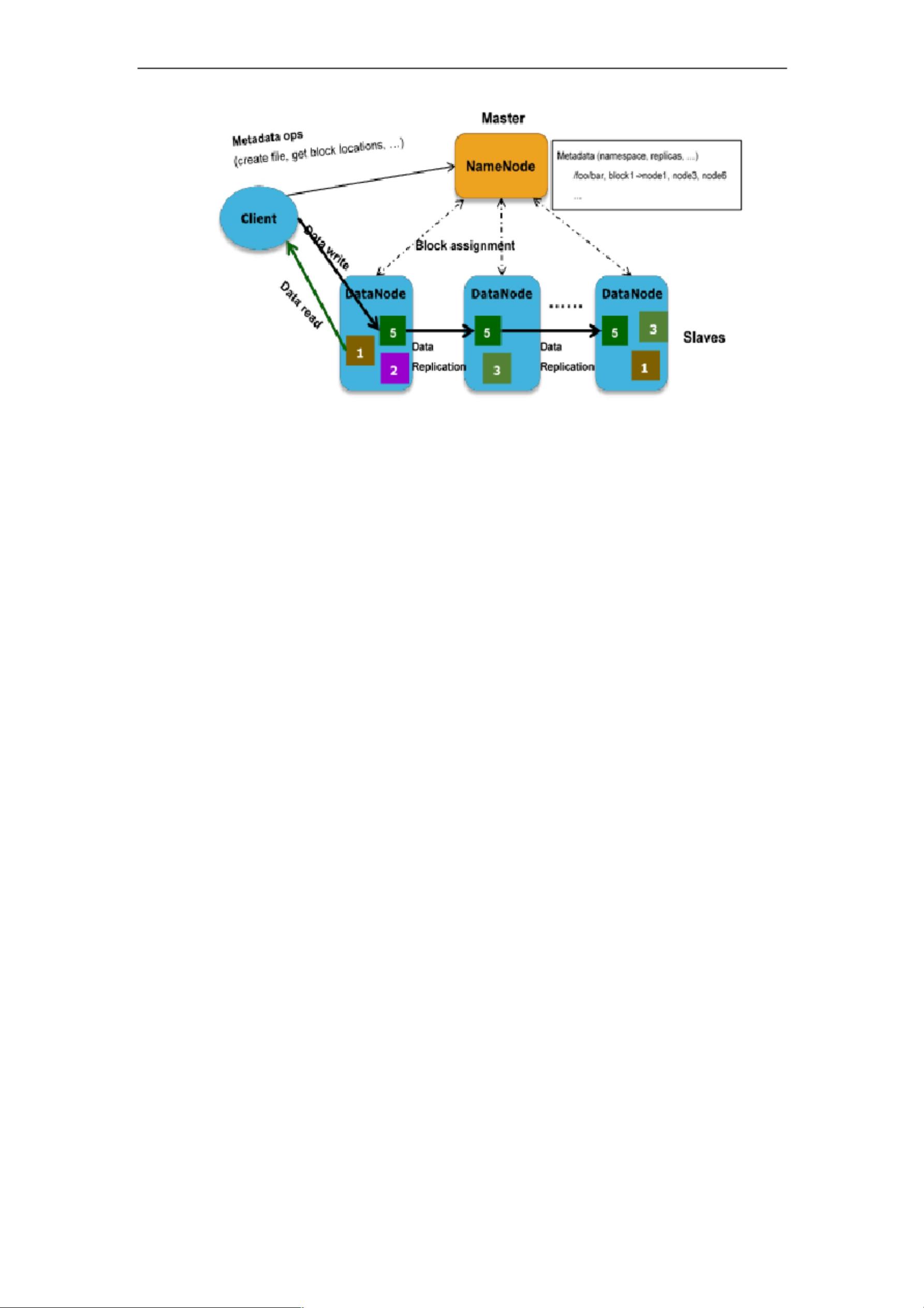

1.1.3. 分布式文件系统 HDFS

HDFS(Hadoop 分布式文件系统)是运行在通用硬件上的分布式文件系统,

本平台采用基于 HDFS2.7.3 的大数据存储和在线服务系,兼容现有 Hadoop2.0 稳

定版本,支持文件数据、流数据、互联网数据的分布式存储于计算,同时支持

Erasure Code 以及 HDFS 文件加密。HDFS 提供了一个高度容错性和高吞吐量的

海量数据存储解决方案。HDFS 已经在各种大型在线服务和大型存储系统中得到

广泛应用,已经成为海量数据存储的事实标准。

HDFS 通过一个高效的分布式算法,将数据的访问和存储分布在大量服务器

之中,在可靠地多备份存储的同时还能将访问分布在集群中的各个服务器之上,

是传统存储构架的一个颠覆性的发展。NameNode 管理元数据,包括文件目录树,

文件->块映射,块->数据服务器映射表等;DataNode 负责存储数据、以及响应数

据读写请求;客户端与 NameNode 交互进行文件创建/删除/寻址等操作,之后直

接与 DataNodes 交互进行文件 I/O。

采用 Namenode HA 方案保证 HDFS 的高可靠性,始终有一个 Namenode 做

热备,防止单点故障问题。采用 QJM 的方式实现 HA,文件系统元数据存储在高

可靠的由 JournalNode 组成的集群上。同时当数据量太大导致单个 Namenode 达

到处理瓶颈时,提供 HDFS Federation 功能,不同的 NameService(由 Namenode

组成)处理挂载在 HDFS 上不同目录下的文件。

HDFS 通过副本机制保证数据的存储安全与高可靠,默认如上图所示配置为

3 副本,的每个数据块分布在不同机架的一组服务器之上,在用户访问时,HDFS

将会计算使用网络最近的和访问量最小的服务器给用户提供访问。由于数据块的

每个复制拷贝都能提供给用户访问,而不是仅从数据源读取,HDFS 对于单数据

块的访问性能将是传统存储方案的数倍。HDFS 支持文件的创建、删除、读取与

追加,对于一个较大的文件,HDFS 将文件的不同部分存放于不同服务器之上。

在访问大型文件时,系统可以并行从服务器阵列中的多个服务器并行读入,增加

了大文件读入的访问带宽。通过以上实现,HDFS 通过分布式计算的算法,将数

据访问均摊到服务器阵列中的每个服务器的多个数据拷贝之上,单个硬盘或服务

器的吞吐量限制都可以数倍甚至数百倍的突破,提供了极高的数据吞吐量。

剩余51页未读,继续阅读

资源评论

G11176593

- 粉丝: 6643

- 资源: 3万+

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功