ChatGPT 是基于 GPT(Generative Pre-Trained Transformer)自然语言处理模型的

多模态聊天机器人。

ChatGPT 核心是基于 RNN、LSTM、Attention、Transformer 模型演进发

展而来的,通过自监督学习(SSL, Self Supervised Learning)预训练、监督学

习优调(Fine Tuning)、强化学习实现非监督学习训练的自然语言处理的大语

言模型(LLM, Large Language Model)。

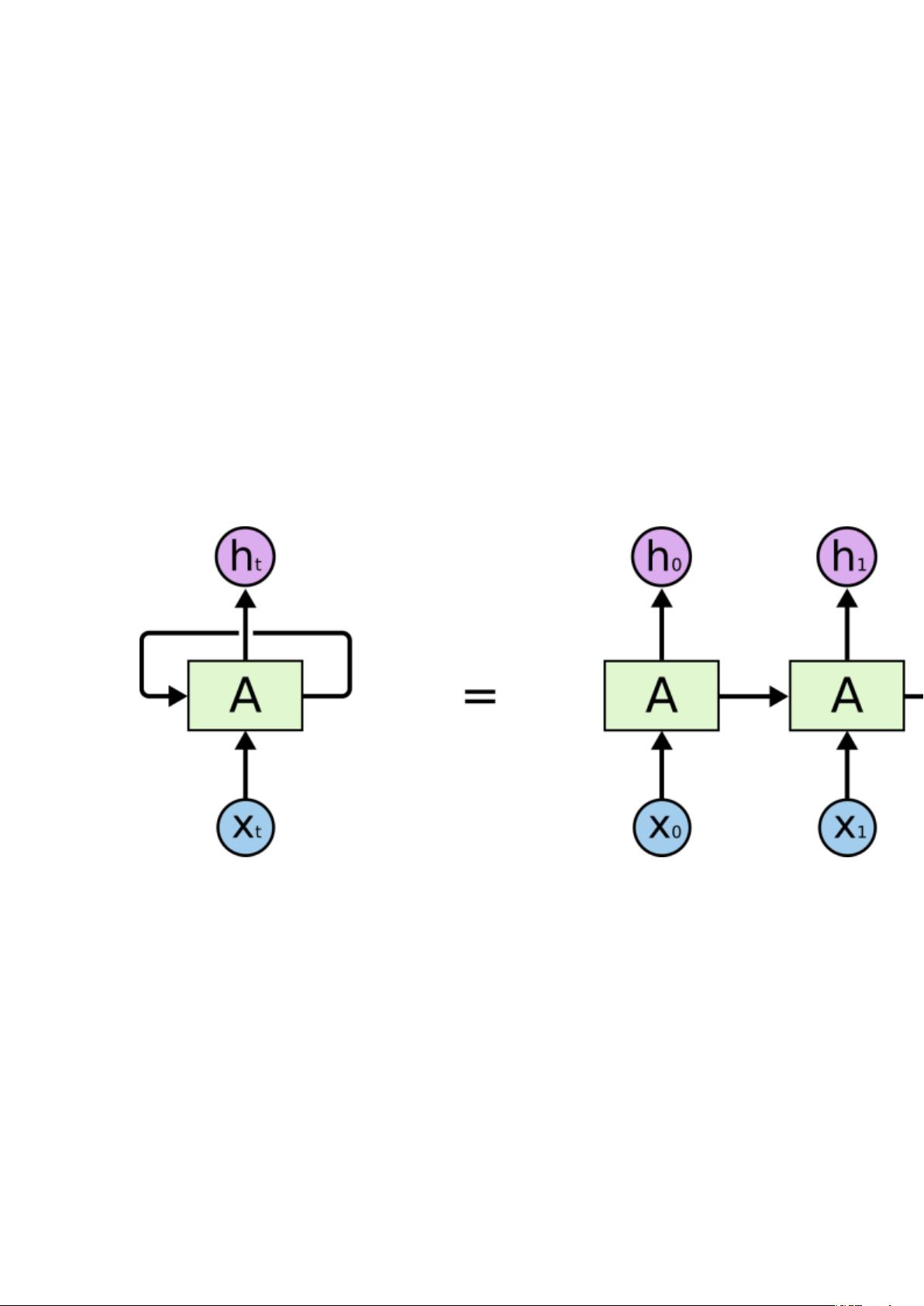

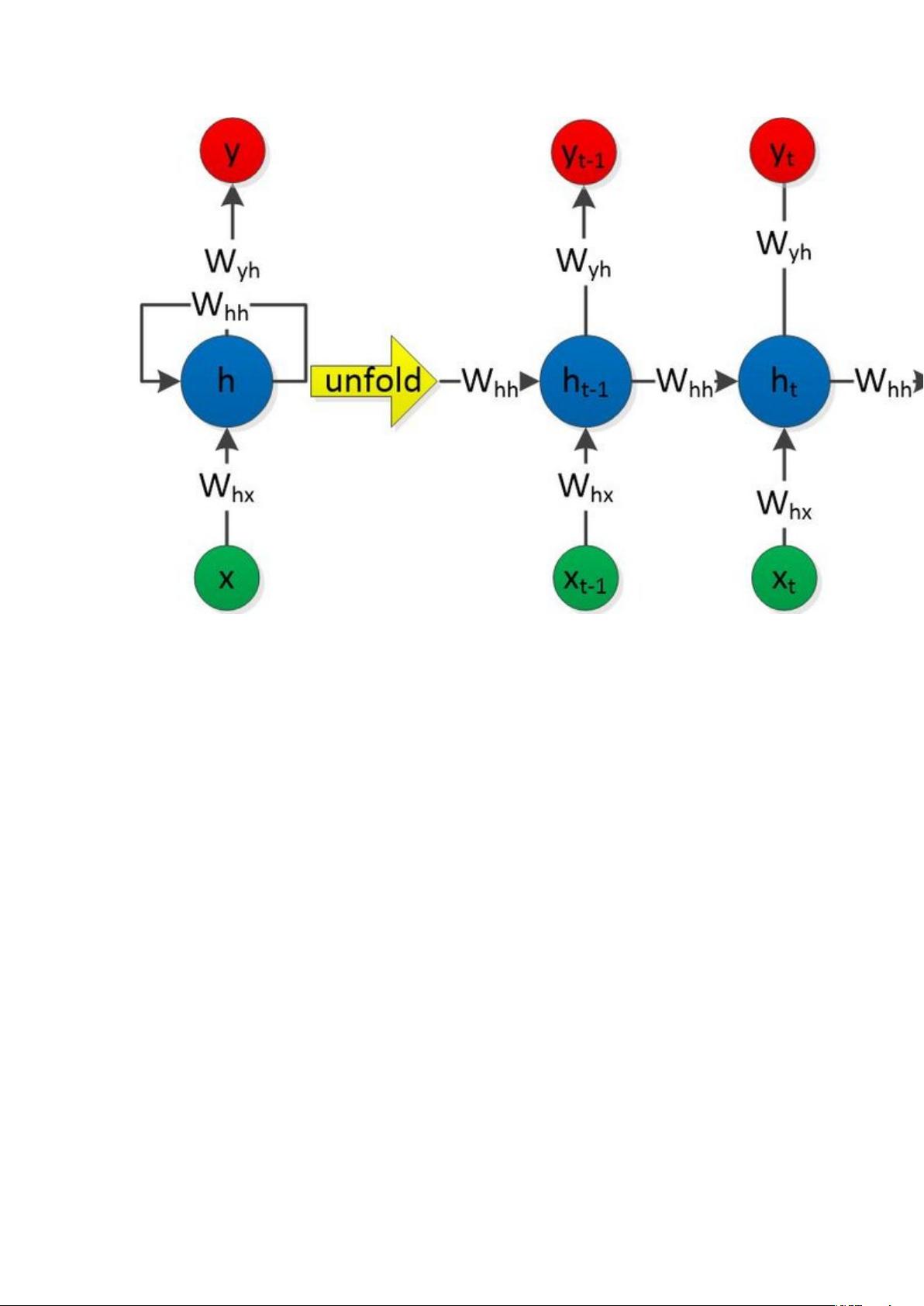

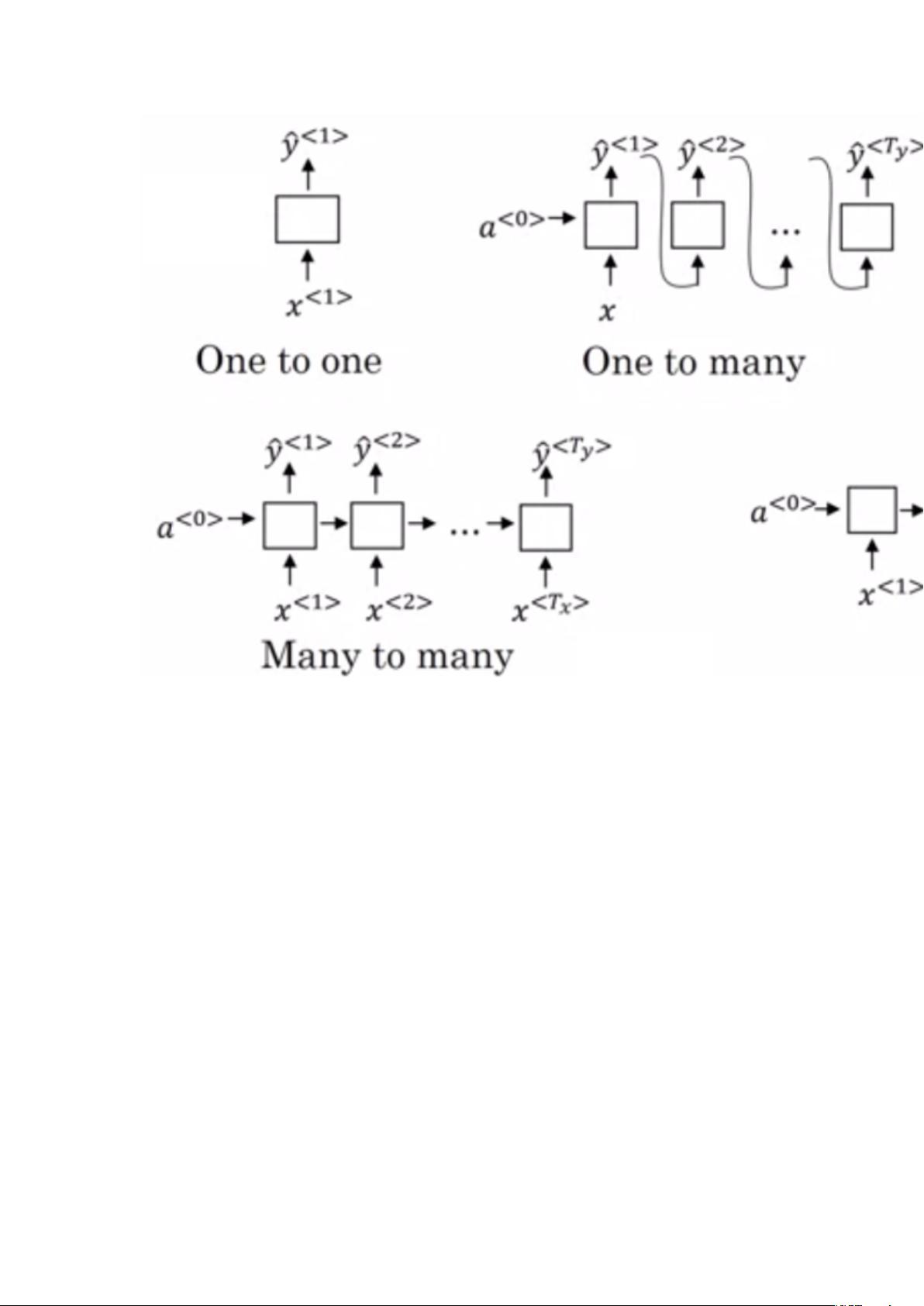

RNN(Recurrent Neural Network)、LSTM(Long Short Term)是早期的循

环网络模型,Attention 是机器翻译、问答等 Seq2Seq 场景下用于对输入与

输出 Tokens 进行对齐的方法,Transformer 是基于 Self-Attention 机制,

通过对输入 Tokens 进行语境关联改进 Seq2Seq 实现的模型。

自监督学习基于对部分数据自动生成标签来训练模型学习另一部分数据的特

征,可用于机器视觉、自然语言处理模型预训练。

随着多模态(Multi-Modal)技术的发展,ChatGPT 自然发展为多模态大语言

模型(MLLM, Multi-modal Large Language Model),该模型可以通过文字、

图片等形式实现与外部的交互。

在作为大规模语言模型的训练时,GPT 先基于自监督学习自动预训练模

型,再基于监督学习利用人工方法实现对预训练后的 GPT 模型的优调

(Fine-Tuning);然后用优调后的模型预测答案,再经过人工后打分训练