没有合适的资源?快使用搜索试试~ 我知道了~

资源详情

资源评论

资源推荐

Python

爬虫抓取东方财富网股票数据并实现

MySQL

数据库存储

Python 爬虫可以说是好玩又好用了。现想利用 Python 爬取网页股票数据保存到本地 csv

数据文件中,同时想把股票数据保存到 MySQL 数据库中。需求有了,剩下的就是实现了。

在开始之前,保证已经安装好了 MySQL 并需要启动本地 MySQL 数据库服务。提到安装

MySQL 数据库,前两天在一台电脑上安装 MySQL5.7 时,死活装不上,总是提示缺少

Visual Studio 2013 Redistributable,但是很疑惑,明明已经安装了呀,原来问题出在

版本上,更换一个版本后就可以了。小问题大苦恼,不知道有没有人像我一样悲催。

言归正传,启动本地数据库服务:

用管理员身份打开“命令提示符(管理员)”,然后输入“net start mysql57”(我把数

据库服务名定义为 mysql57 了,安装 MySQL 时可以修改)就可以开启服务了。注意使用

管理员身份打开小黑框,如果不是管理员身份,我这里会提示没有权限,大家可以试试。

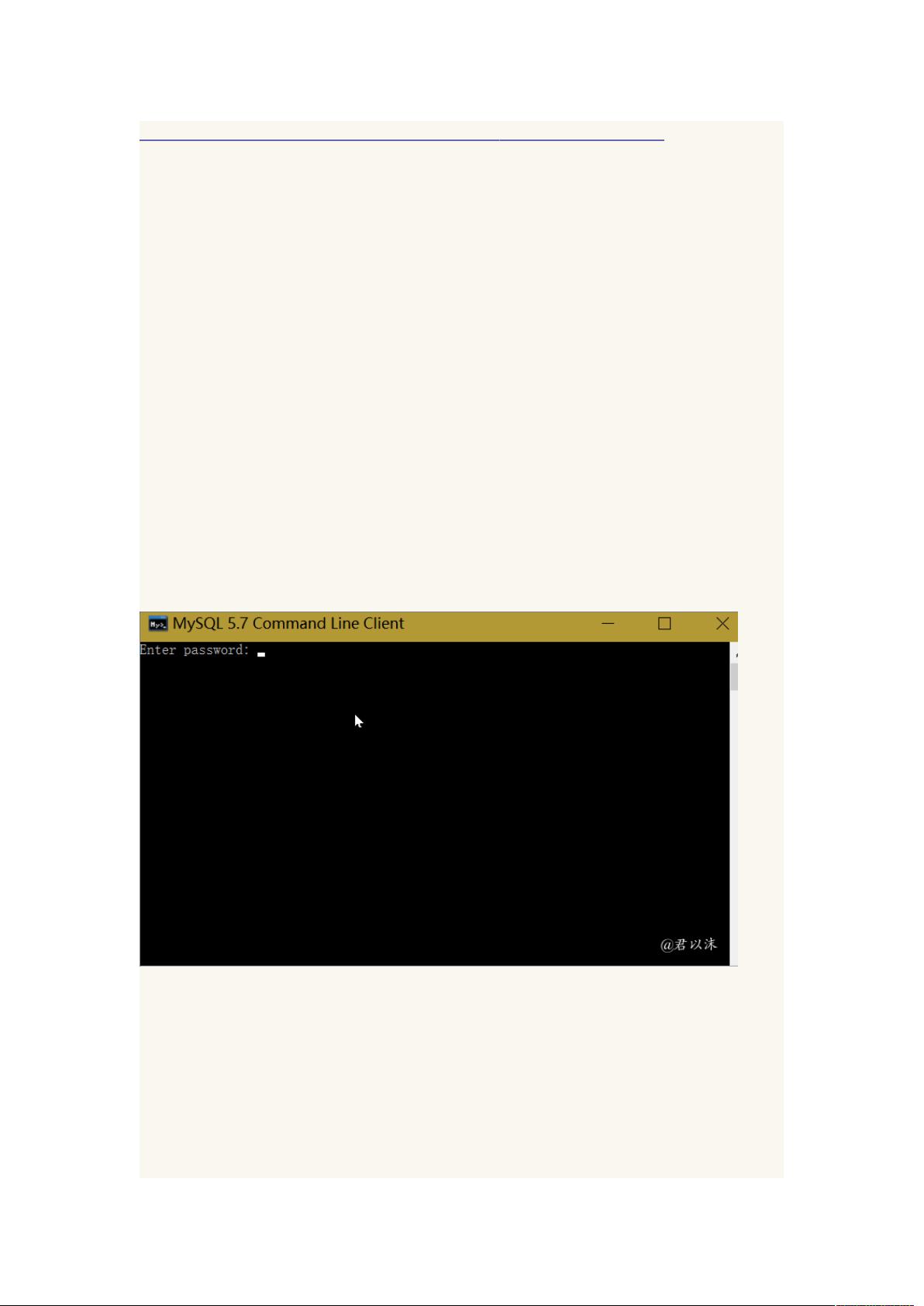

启动服务之后,我们可以选择打开“MySQL 5.7 Command Line Client”小黑框,需要先

输入你的数据库的密码,安装的时候定义过,在这里可以进行数据库操作。

下面开始上正餐。

一、Python 爬虫抓取网页数据并保存到本地数据文件中

首先导入需要的数据模块,定义函数:

#导入需要使用到的模块

import urllib

import re

import pandas as pd

import pymysql

import os

#爬虫抓取网页函数

def getHtml(url):

html = urllib.request.urlopen(url).read()

html = html.decode('gbk')

return html

#抓取网页股票代码函数

def getStackCode(html):

s = r'<li><a target="_blank" href="http://quote.eastmoney.com/\

S\S(.*?).html">'

pat = re.compile(s)

code = pat.8ndall(html)

return code

真正干活的代码块:

Url = 'http://quote.eastmoney.com/stocklist.html'#东方财富网股票数

据连接地址

8lepath = 'D:\\data\\'#定义数据文件保存路径

#实施抓取

code = getStackCode(getHtml(Url))

#获取所有股票代码(以 6 开头的,应该是沪市数据)集合

CodeList = []

for item in code:

if item[0]=='6':

CodeList.append(item)

#抓取数据并保存到本地 csv 文件

for code in CodeList:

print('正在获取股票%s 数据'%code)

url = 'http://quotes.money.163.com/service/chddata.html?

code=0'+code+\

'&end=20161231&8elds=TCLOSE;HIGH;LOW;TOPEN;LCLOSE;CHG;P

CHG;TURNOVER;VOTURNOVER;VATURNOVER;TCAP;MCAP'

urllib.request.urlretrieve(url, 8lepath+code+'.csv')

以上代码实现了爬虫网页抓取股票数据,并保存到本地文件中。关于爬虫的东西,有很多

资料可以参考,大都是一个套路,不再多说。同时,本文实现过程中也参考了很多的网页

资源,在此对所有原创者表示感谢!

先看下抓取的结果。CodeList 是抓取到的所有股票代码的集合,我们看到它共包含 1416

条元素,即 1416 支股票数据。因为股票太多,所以抓取的是以 6 开头的,貌似是沪市股

票数据(原谅我不懂金融)。

抓取到的股票数据会分别存储到 csv 文件中,一只股票数据一个文件。理论上会有 1416

个 csv 文件,和股票代码数一致。但原谅我的渣网速,下载一个都费劲,也是呵呵了。

剩余11页未读,继续阅读

外星人1234

- 粉丝: 3

- 资源: 5

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论7