决策树—回归

作者:归去来兮 2018.8.19

核心:划分点选择 + 输出值确定。

一、概述

决策树是一种基本的分类与回归方法,本文叙述的是回归部分。回归决策树主要指

CART(classification and regression tree)算法,内部结点特征的取值为“是”和“否”, 为二叉树

结构。

所谓回归,就是根据特征向量来决定对应的输出值。回归树就是将特征空间划分成若干

单元,每一个划分单元有一个特定的输出。因为每个结点都是“是”和“否”的判断,所以划分

的边界是平行于坐标轴的。对于测试数据,我们只要按照特征将其归到某个单元,便得到对

应的输出值。

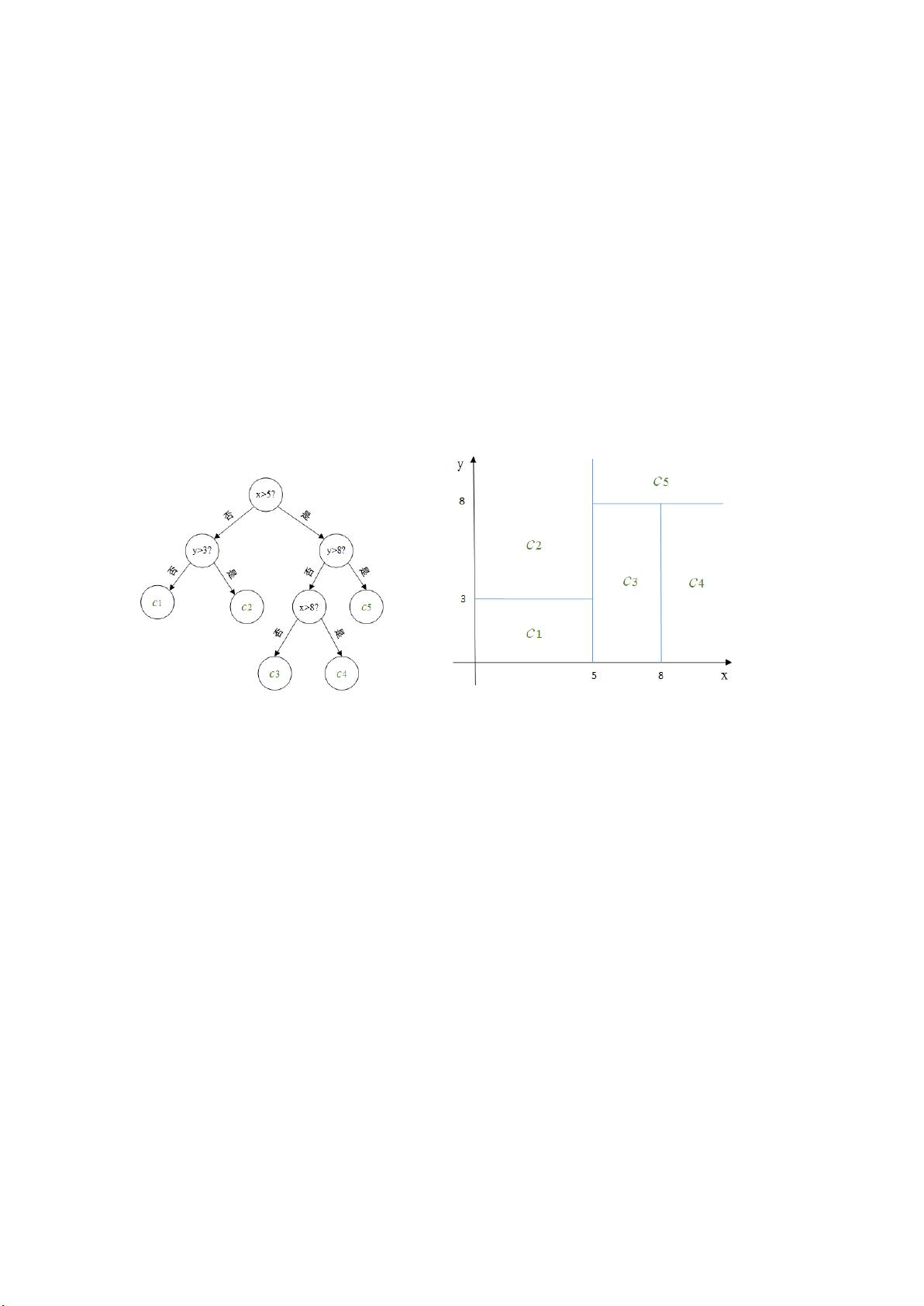

【例】左边为对二维平面划分的决策树,右边为对应的划分示意图,其中

,

,

,

,

是对应每个划分单元的输出。

比如现在对一个新的向量(6,6)决定它对应的输出。第一维分量 6 介于 5 和 8 之间,第二

维分量 6 小于 8,根据此决策树很容易判断(6,6)所在的划分单元,其对应的输出值为

.

划分的过程也就是建立树的过程,每划分一次,随即确定划分单元对应的输出,也就多

了一个结点。当根据停止条件划分终止的时候,最终每个单元的输出也就确定了,也就是叶

结点。

二、回归树建立

既然要划分,切分点怎么找?输出值又怎么确定?这两个问题也就是回归决策树的核心。

[切分点选择:最小二乘法]; [输出值:单元内均值].

1. 原理

假设 X 和 Y 分别为输入和输出变量,并且 Y 是连续变量,给定训练数据集为

, 其中

为输入实例(特征向量),n 为特

征个数,,N 为样本容量。

对特征空间的划分采用启发式方法,每次划分逐一考察当前集合中所有特征的所有取值,

根据平方误差最小化准则选择其中最优的一个作为切分点。如对训练集中第个特征变量

和它的取值 s,作为切分变量和切分点,并定义两个区域

和

,为找出最优的 j 和 s,对下式求解

评论0

最新资源