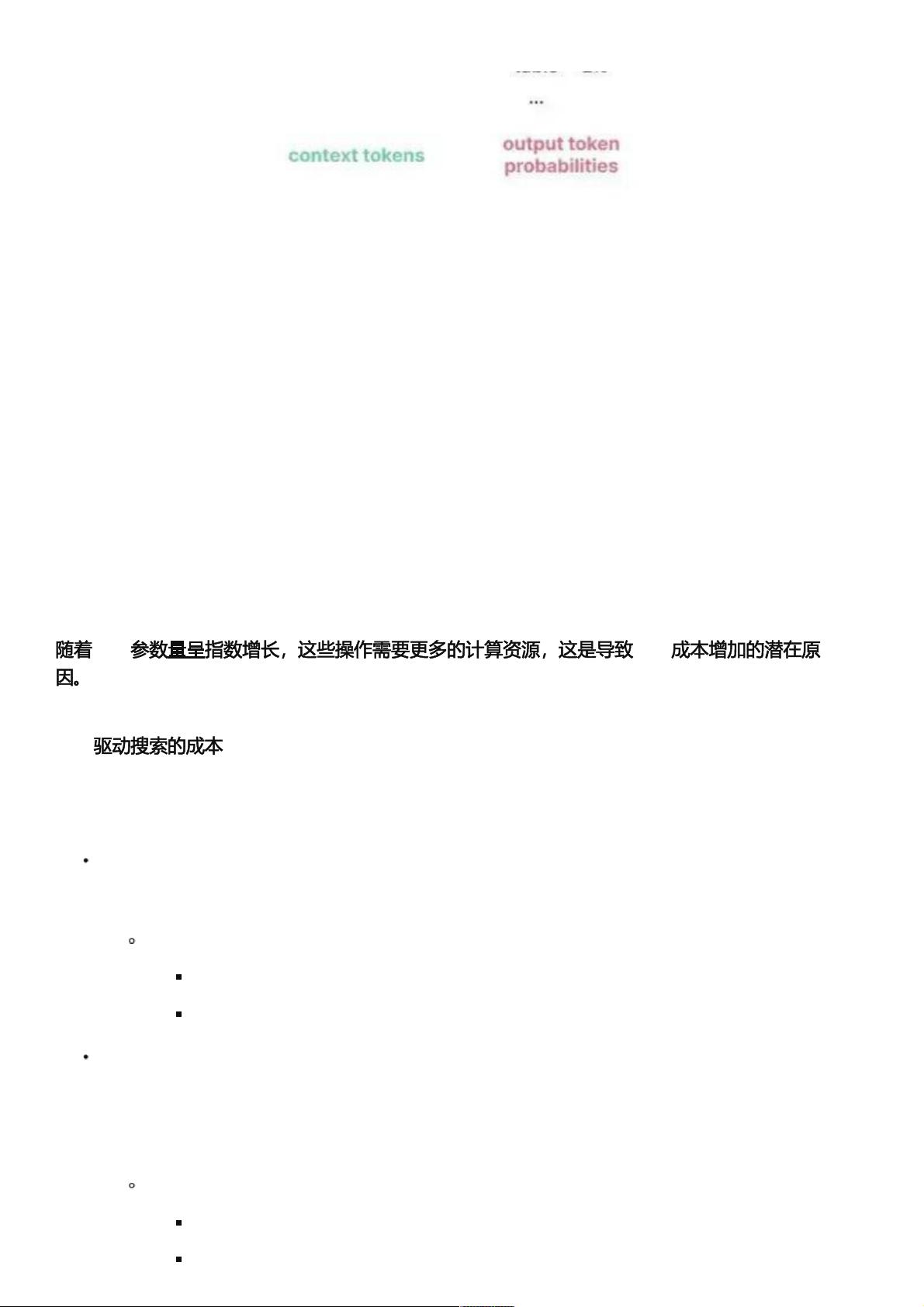

自 回归语言模型(

Autoregressive Language Model

)输入上下文和输出内容的图示(在实践

中,

token

通常是子词:即

“happy”

可能被分解为两个

token

,例如

“hap”

、

“-py”

)

为了生成文本,语言模型根据输出token的概率重复采样新token。例如,在像ChatGPT这样的服

务中,模型从一个初始prompt开始,该prompt将用户的查询作为上下文,并生成token来构建响

应(response)。新token生成后,会被附加到上下文窗口以提示下一次迭代。

语言模型已经存在了几十年。当下LLM性能的背后是数十亿参数的高效深度神经网络(DNN)驱

动。参数是用于训练和预测的矩阵权重,浮点运算(FLOPS)的数值通常与参数数量

(parameter count)成比例。这些运算是在针对矩阵运算优化的处理器上计算的,例如GPU、

TPU和其他专用芯片。

随着LLM参数量呈指数增长,这些操作需要更多的计算资源,这是导致LLM成本增加的潜在原

因。

3

LLM驱动搜索的成本

本节,我们将估算运行LLM驱动搜索引擎的成本。应该如何实施这样的搜索引擎仍是一个活跃的

研究领域,我们这里主要考虑两种方法来评估提供此类服务的成本范围:

ChatGPT Equivalent:一个在庞大训练数据集上训练的LLM,它会将训练期间的知识存储

到模型参数中。在推理过程中(使用模型生成输出), LLM无法访问外部知识[6]。

这种方法有如下两大缺点:

容易“幻想”事实。

模型知识滞后,仅包含最后训练日期之前的可用信息。

2-Stage Search Summarizer:一种架构上类似的LLM,可以在推理时访问Google或Bing

等传统搜索引擎。在这种方法的第一阶段,我们通过搜索引擎运行查询以检索前K个结

果。在第二阶段,通过LLM运行每个结果以生成K个响应,该模型再将得分最高的响应返回

给用户[7]。

相比ChatGPT Equivalent,这种方法的优点是:

能够从检索到的搜索结果中引用其来源。

能获取最新信息。