没有合适的资源?快使用搜索试试~ 我知道了~

资源推荐

资源详情

资源评论

13-11-25

支持向量机通俗导论(理解SVM的三层境界) - 结构之法 算法之道 - 博客频道 - CSDN.NET

blog.csdn.net/v_july_v/article/details/7624837

1/36

结构之法 算法之道

分类: 30.Machine L&Data Mining

目录(?) [+]

博文代码可自动存入CODE啦了! 文思海辉第一届在线编程大赛 消灭0回答,赢下载分 订阅CSDN社区周刊,及时了解社区

精华内容 办公大师系列经典丛书 诚聘译者

支持向量机通俗导论(理解SVM的三层境界)

2012-06-01 22:48 133143人阅读 评论(250) 收藏 编辑 删除

hyper vector 算法 优化 数据挖掘

支持向量机通俗导论(理解SVM的三层境界)

作者:July、pluskid ;致谢:白石、JerryLead

出处:结构之法算法之道blog。

前言

动笔写这个支持向量机(support vector machine)是费了不少劲和困难的,原因很简单,一者这个东西本身就

并不好懂,要深入学习和研究下去需花费不少时间和精力,二者这个东西也不好讲清楚,尽管网上已经有朋友写

得不错了(见文末参考链接),但在描述数学公式的时候还是显得不够。得益于同学白石的数学证明,我还是想尝试

写一下,希望本文在兼顾通俗易懂的基础上,真真正正能足以成为一篇完整概括和介绍支持向量机的导论性的文

章。

本文在写的过程中,参考了不少资料,包括《支持向量机导论》、《统计学习方法》及网友pluskid的支持向量

机系列等等,于此,还是一篇学习笔记,只是加入了自己的理解和总结,有任何不妥之处,还望海涵。全文宏观上整体认识支

持向量机的概念和用处,微观上深究部分定理的来龙去脉,证明及原理细节,力求深入浅出 & 通俗易懂。

同时,阅读本文时建议大家尽量使用chrome等浏览器,如此公式才能更好的显示,再者,阅读时可拿张纸和笔

出来,把本文所有定理.公式都亲自推导一遍或者直接打印下来(可直接打印网页版,享受随时随地思考、演算的

极致快感),在文稿上演算。

Ok,还是那句原话,有任何问题,欢迎任何人随时不吝指正 & 赐教,感谢。

第一层、了解SVM

1.0、什么是支持向量机SVM

要明白什么是SVM,便得从分类说起。

分类作为数据挖掘领域中一项非常重要的任务,它的目的是学会一个分类函数或分类模型(或者叫做分类器),

而支持向量机本身便是一种监督式学习的方法(至于具体什么是监督学习与非监督学习,请参见此系列Machine L&Data

Mining第一篇),它广泛的应用于统计分类以及回归分析中。

支持向量机(SVM)是90年代中期发展起来的基于统计学习理论的一种机器学习方法,通过寻求结构化风险最小

来提高学习机泛化能力,实现经验风险和置信范围的最小化,从而达到在统计样本量较少的情况下,亦能获得良

好统计规律的目的。

对于不想深究SVM原理的同学或比如就只想看看SVM是干嘛的,那么,了解到这里便足够了,不需上层。而对

于那些喜欢深入研究一个东西的同学,甚至究其本质的,咱们则还有很长的一段路要走,万里长征,咱们开始迈

第一步吧,相信你能走完。

原创:140篇 转载:0篇

译文:5篇 评论:11271条

个人资料

v_JULY_v

访问:5397955次

积分:28602分

排名:第45名

博客公告

①.本blog开通于2010年10月11

日,高级C++/算法交流群:

128691433;北京程序员联盟:

172727781。②.狂热算法,热爱数

据挖掘,关注机器学习、统计分

析,爱好文学数学。③.微博:@研

究者July,邮箱:

zhoulei97@aliyun.com,或

zhoulei0907@yahoo.cn,July,二

零一三年八月七日。

我的微博

研究者July

北京 朝阳区

加关注

加关注

34分钟前 转发(1) | 评论(7)

上午瞥了一下,格式稍有错乱

,某些图片符号公式链接无法

正常显示,下次请记得给出原

文地址:http://t.cn/zOeaL7j,

至少当显示出了问题时,有原

文可考,谢谢。[转]:SVM研究

人员必读:<理解SVM的三层

境界-支持向量机通俗导论> ht

tp://t.cn/8kA7IQA

文章分类

03.Algorithms(实现) (9)

01.Algorithms(研究) (27)

02.Algorithms(后续) (22)

04.Algorithms(讨论) (1)

05.MS 100' original (7)

06.MS 100' answers (13)

07.MS 100' classify (4)

Google或baidu搜索:“结构之法”,进入本博客

目录视图 摘要视图 订阅 管理博客 写新文章

v_JULY_v 我的: 收件箱(5) 资源 博客 空间 设置 | 帮助 | 退出首页 业界 移动 云计算 研发 论坛 博客 下载 更多

您有21条新通知

13-11-25

支持向量机通俗导论(理解SVM的三层境界) - 结构之法 算法之道 - 博客频道 - CSDN.NET

blog.csdn.net/v_july_v/article/details/7624837

2/36

1.1、线性分类

OK,在讲SVM之前,咱们必须先弄清楚一个概念:线性分类器(也可以叫做感知机,这里的机表示的是一种算

法,本文第三部分、证明SVM中会详细阐述)。

1.1.1、分类标准

这里我们考虑的是一个两类的分类问题,数据点用 来表示,这是一个 维向量,w^T中的T代表转置,而类

别用 来表示,可以取 1 或者 -1 ,分别代表两个不同的类。一个线性分类器就是要在 维的数据空间中找到一

个超平面,其方程可以表示为:

上面给出了线性分类的定义描述,但或许读者没有想过:为何用y取1 或者 -1来表示两个不同的类别呢?其

实,这个1或-1的分类标准起源于logistic回归,为了完整和过渡的自然性,咱们就再来看看这个logistic回归。

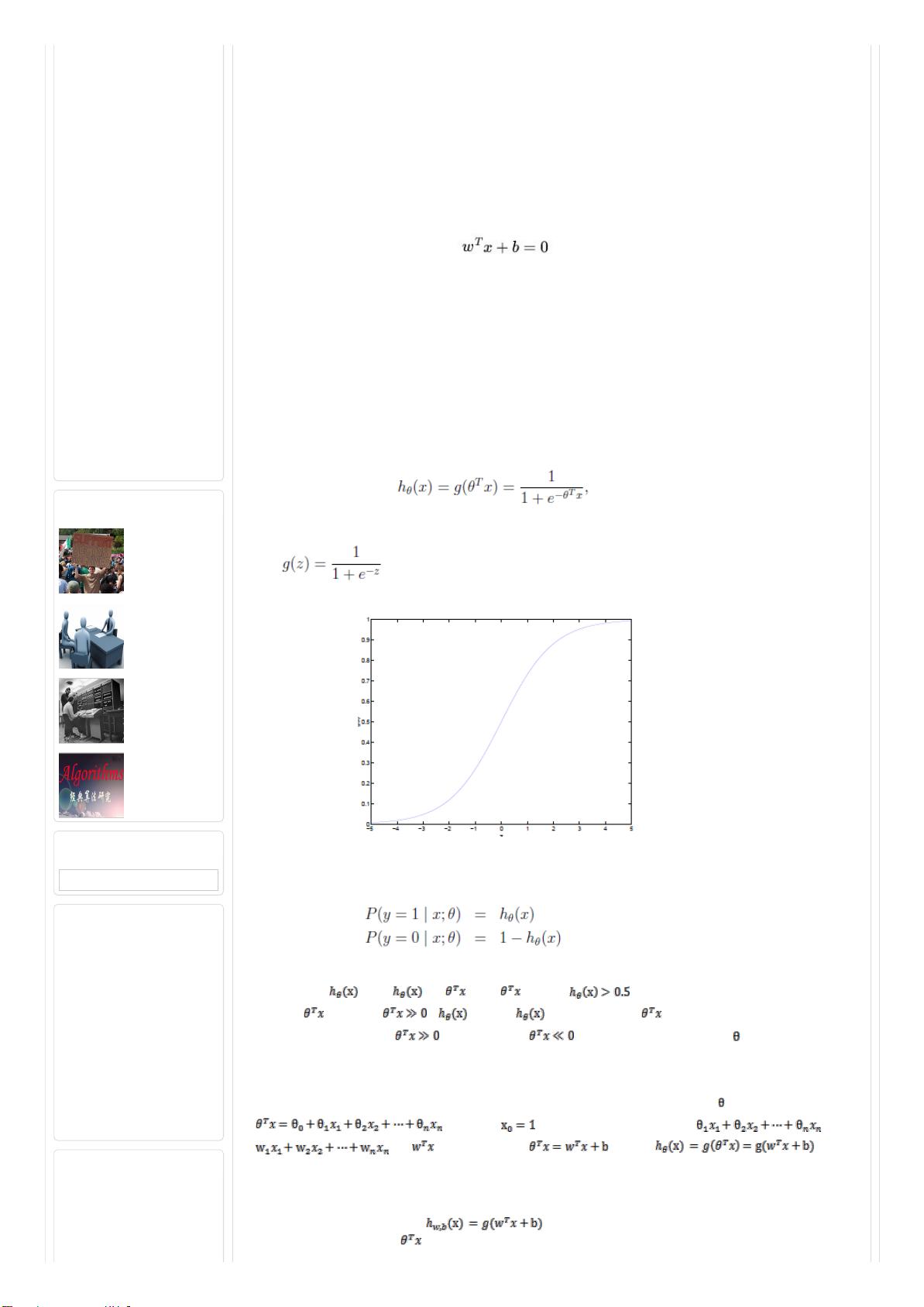

1.1.2、1或-1分类标准的起源:logistic回归

Logistic回归目的是从特征学习出一个0/1分类模型,而这个模型是将特性的线性组合作为自变量,由于自变量

的取值范围是负无穷到正无穷。因此,使用logistic函数(或称作sigmoid函数)将自变量映射到(0,1)上,映射后

的值被认为是属于y=1的概率。

形式化表示就是

假设函数

其中x是n维特征向量,函数g就是logistic函数。

而 的图像是

可以看到,将无穷映射到了(0,1)。

而假设函数就是特征属于y=1的概率。

当我们要判别一个新来的特征属于哪个类时,只需求,若大于0.5就是y=1的类,反之属于y=0类。

再审视一下 ,发现 只和 有关, >0,那么 ,g(z)只不过是用来映射,真实的类别决

定权还在 。还有当时 , =1,反之 =0。如果我们只从 出发,希望模型达到的目标无非就

是让训练数据中y=1的特征 ,而是y=0的特征 。Logistic回归就是要学习得到 ,使得正例的特征远

大于0,负例的特征远小于0,强调在全部训练实例上达到这个目标。

1.1.3、形式化标示

我们这次使用的结果标签是y=-1,y=1,替换在logistic回归中使用的y=0和y=1。同时将 替换成w和b。以前的

,其中认为 。现在我们替换为b,后面替换 为

(即 )。这样,我们让 ,进一步 。也

就是说除了y由y=0变为y=-1,只是标记不同外,与logistic回归的形式化表示没区别。

再明确下假设函数

上面提到过我们只需考虑 的正负问题,而不用关心g(z),因此我们这里将g(z)做一个简化,将其简单映射到

(249356)

(205613)

(185584)

(161921)

(146780)

(133063)

(128746)

(102545)

(101295)

(93441)

(431)

(371)

(342)

(322)

08.MS 100' one Keys (6)

09.MS 100' follow-up (4)

10.MS 100' comments (4)

11.TAOPP(编程艺术) (30)

12.TAOPP string (8)

13.TAOPP array (12)

14.TAOPP list (2)

15.stack/heap/queue (0)

16.TAOPP tree (1)

17.TAOPP c/c++ (2)

18.TAOPP function (2)

19.TAOPP algorithms (8)

20.number operations (1)

21.Essays (8)

22.Big Data Processing (5)

23.Redis/MongoDB (0)

24.data structures (12)

25.Red-black tree (7)

26.Image Processing (3)

27.Architecture design (4)

28.Source analysis (3)

29.Recommend&Search (4)

30.Machine L&Data Mining (5)

博客专栏

数据挖掘十大算法

系列

文章:5篇

阅读:334580

微软面试100题系

列

文章:18篇

阅读:1629362

程序员编程艺术

文章:28篇

阅读:1169557

经典算法研究

文章:32篇

阅读:1401832

文章搜索

阅读排行

程序员面试、算法研究、编程艺术、红黑树、数据挖掘5大系列集锦

教你如何迅速秒杀掉:99%的海量数据处理面试题

九月十月百度人搜,阿里巴巴,腾讯华为笔试面试八十题(第331-410题)

从B树、B+树、B*树谈到R 树

横空出世,席卷互联网--评微软等公司数据结构+算法面试100题

支持向量机通俗导论(理解SVM的三层境界)

十道海量数据处理面试题与十个方法大总结

十一、从头到尾彻底解析Hash表算法

九月腾讯,创新工场,淘宝等公司最新面试三十题(第171-200题)

微软公司等数据结构+算法面试100题(第1-100题)全部出炉

评论排行

程序员面试、算法研究、编程艺术、红黑树、数据挖掘5大系列集锦

九月十月百度人搜,阿里巴巴,腾讯华为笔试面试八十题(第331-410题)

九月腾讯,创新工场,淘宝等公司最新面试三十题(第171-200题)

当今世界最为经典的十大算法--投票进行时

x

n

y

n

13-11-25

支持向量机通俗导论(理解SVM的三层境界) - 结构之法 算法之道 - 博客频道 - CSDN.NET

blog.csdn.net/v_july_v/article/details/7624837

3/36

y=-1和y=1上。映射关系如下:

于此,想必已经解释明白了为何线性分类的标准一般用1 或者-1 来标示。

注:上小节来自jerrylead所作的斯坦福机器学习课程的笔记。

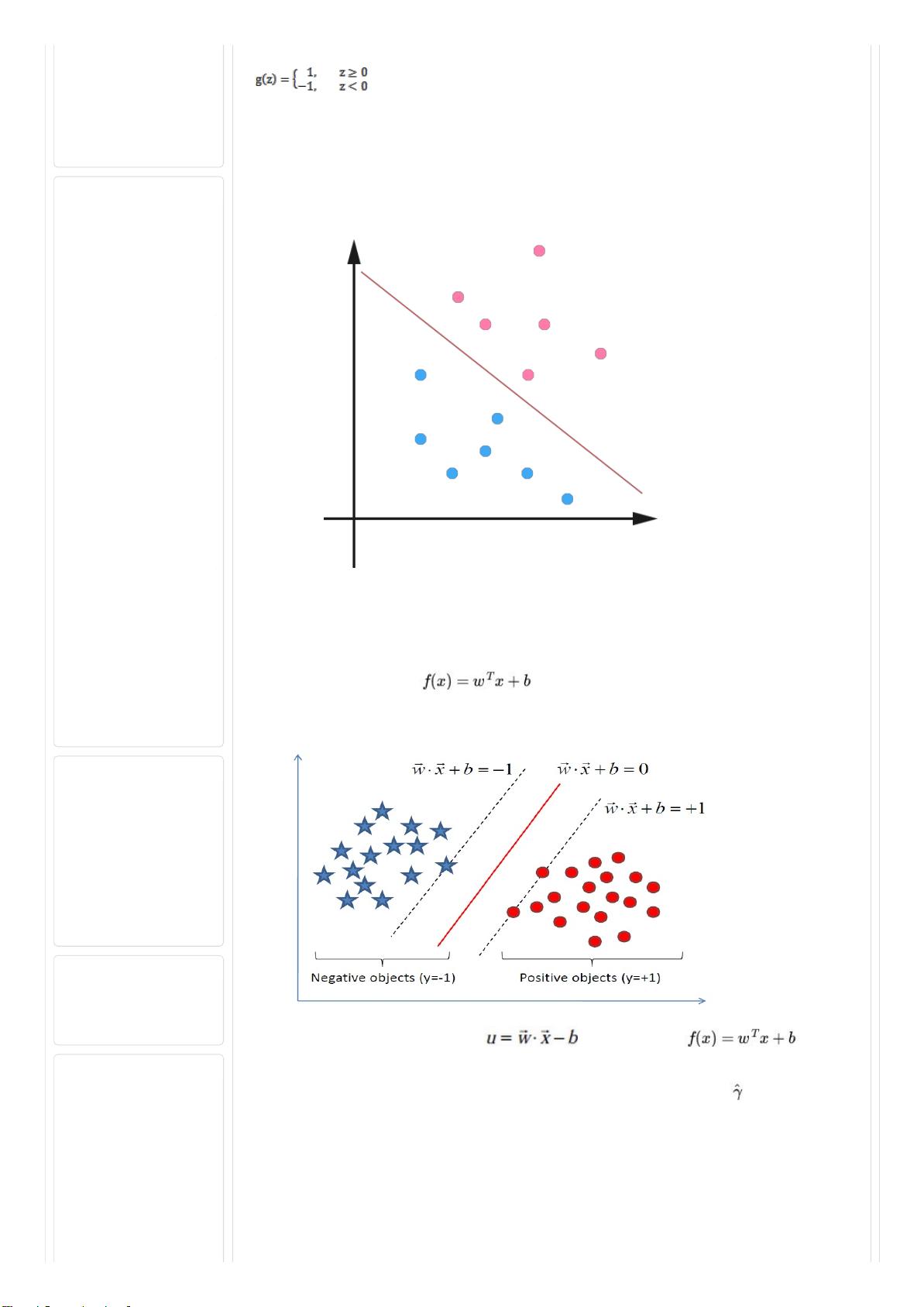

1.2、线性分类的一个例子

下面举个简单的例子,一个二维平面(一个超平面,在二维空间中的例子就是一条直线),如下图所示,平面上

有两种不同的点,分别用两种不同的颜色表示,一种为红颜色的点,另一种则为蓝颜色的点,红颜色的线表示一

个可行的超平面。

从上图中我们可以看出,这条红颜色的线把红颜色的点和蓝颜色的点分开来了。而这条红颜色的线就是我们上

面所说的超平面,也就是说,这个所谓的超平面的的确确便把这两种不同颜色的数据点分隔开来,在超平面一边

的数据点所对应的 全是 -1 ,而在另一边全是 1 。

接着,我们可以令分类函数(提醒:下文很大篇幅都在讨论着这个分类函数):

显然,如果 ,那么 是位于超平面上的点。我们不妨要求对于所有满足 的点,其对

应的 等于 -1 ,而 则对应 的数据点。

注:上图中,定义特征到结果的输出函数 ,与我们之前定义的 实质是一

样的。

(有一朋友飞狗来自Mare_Desiderii,看了上面的定义之后,问道:请教一下SVM functional margin 为 =y(w Tx+b)=yf(x)中

的Y是只取1和-1 吗?y的唯一作用就是确保functional margin的非负性?真是这样的么?当然不是,详情请见本文评论下第43楼)

当然,有些时候,或者说大部分时候数据并不是线性可分的,这个时候满足这样条件的超平面就根本不存在(不

过关于如何处理这样的问题我们后面会讲),这里先从最简单的情形开始推导,就假设数据都是线性可分的,亦即

这样的超平面是存在的。

更进一步,我们在进行分类的时候,将数据点 代入 中,如果得到的结果小于 0 ,则赋予其类别 -1 ,

如果大于 0 则赋予类别 1 。如果 ,则很难办了,分到哪一类都不是。

请读者注意,下面的篇幅将按下述3点走:

(293)

(273)

(250)

(246)

(233)

(218)

从B树、B+树、B*树谈到R 树

横空出世,席卷互联网--评微软等公司数据结构+算法面试100题

支持向量机通俗导论(理解SVM的三层境界)

我的大学生涯

程序员编程艺术:第一章、左旋转字符串

十三个经典算法研究与总结、目录+索引

最新评论

程序员编程艺术:第三章、寻找最小的k个数

qw345: @qw345:包括后面的

GetMin也是一样的

程序员编程艺术:第三章、寻找最小的k个数

qw345: 第一段代码HeapAdjust 有

点问题吧,child应该为 2i 而不是

2i+1, 不然child...

Machine Learning读书会, 面试&算法讲座集锦(13年第4场PPT公布)

v_JULY_v: @u012653791:哈,欢

迎微博晒书,和下次再来。

Machine Learning读书会, 面试&算法讲座集锦(13年第4场PPT公布)

L_J_SHOU: 多谢楼主昨天在计算所

赠的书,是本好书,多谢。。。

支持向量机通俗导论(理解SVM的三层境界)

v_JULY_v: @huangguandxf:这小段

代码实现的是上文中的η,不理解?

支持向量机通俗导论(理解SVM的三层境界)

huangguandxf: 关于你提供的参考

的代码中,下面的代码片段怎么理

解:/* * 如果eta等于0或者大于0

则...

我的大学生涯

lxkuk: 你是学计算机的天才!真的

发现,应试教育一个大缺陷就是会

埋没你这样的人才!

Machine Learning读书会, 面试&算法讲座集锦(13年第4场PPT公布)

罗liexin: 楼猪啊,请问哪个时候才

能达到你们这些大牛的水平,感觉

好遥远 T_T 。。。现在已经是大二

了,还是个菜...

红黑树从头至尾插入和删除结点的全程演示图

罗liexin: 楼主啊,看完插入的全过

程后终于明白了,回去小试一

下。。。我有个疑问,红黑树的删

除算法和普通二叉树有差...

六之续、由KMP算法谈到BM算法

diaolingle: BM算法后面的几个图看

不懂

01、本blog索引

3、微软100题维护地址

1、微软100题横空出世

5、经典算法研究系列

7、红黑树系列集锦

6、程序员编程艺术系列

2、微软面试全部100题

0、经典5大原创系列集锦

4、微软100题下载地址

02、Google or baidu?

Google搜--"结构之法"(My

BLOG)

baidu 搜--"结构之法"(My BLOG)

03、我的驻点

01. 我的新浪微博

02、Harry

03、NoSQLFan

04、酷勤网

05、52nlp

06、IT面试论坛

07、北大朋友的挖掘乐园

08、跟Sophia_qing一起读硕士

08、caopengcs

y

f(x) = 0

x

f(x) < 0

y

f(x) > 0

y = 1

x

f(x)

f(x) = 0

13-11-25

支持向量机通俗导论(理解SVM的三层境界) - 结构之法 算法之道 - 博客频道 - CSDN.NET

blog.csdn.net/v_july_v/article/details/7624837

4/36

1. 咱们就要确定上述分类函数f(x) = w.x + b(w.x表示w与x的内积)中的两个参数w和b,通俗理解的话w是

法向量,b是截距(再次说明:定义特征到结果的输出函数 ,与我们最开始定义的

实质是一样的);

2. 那如何确定w和b呢?答案是寻找两条边界端或极端划分直线中间的最大间隔(之所以要寻最大间隔是为了

能更好的划分不同类的点,下文你将看到:为寻最大间隔,导出1/2||w||^2,继而引入拉格朗日函数和对

偶变量a,化为对单一因数对偶变量a的求解,当然,这是后话),从而确定最终的最大间隔分类超平面

hyper plane和分类函数;

3. 进而把寻求分类函数f(x) = w.x + b的问题转化为对w,b的最优化问题,最终化为对偶因子的求解。

总结成一句话即是:从最大间隔出发(目的本就是为了确定法向量w),转化为求对变量w和b的凸二次规划问

题。亦或如下图所示(有点需要注意,如读者@酱爆小八爪所说:从最大分类间隔开始,就一直是凸优化问题):

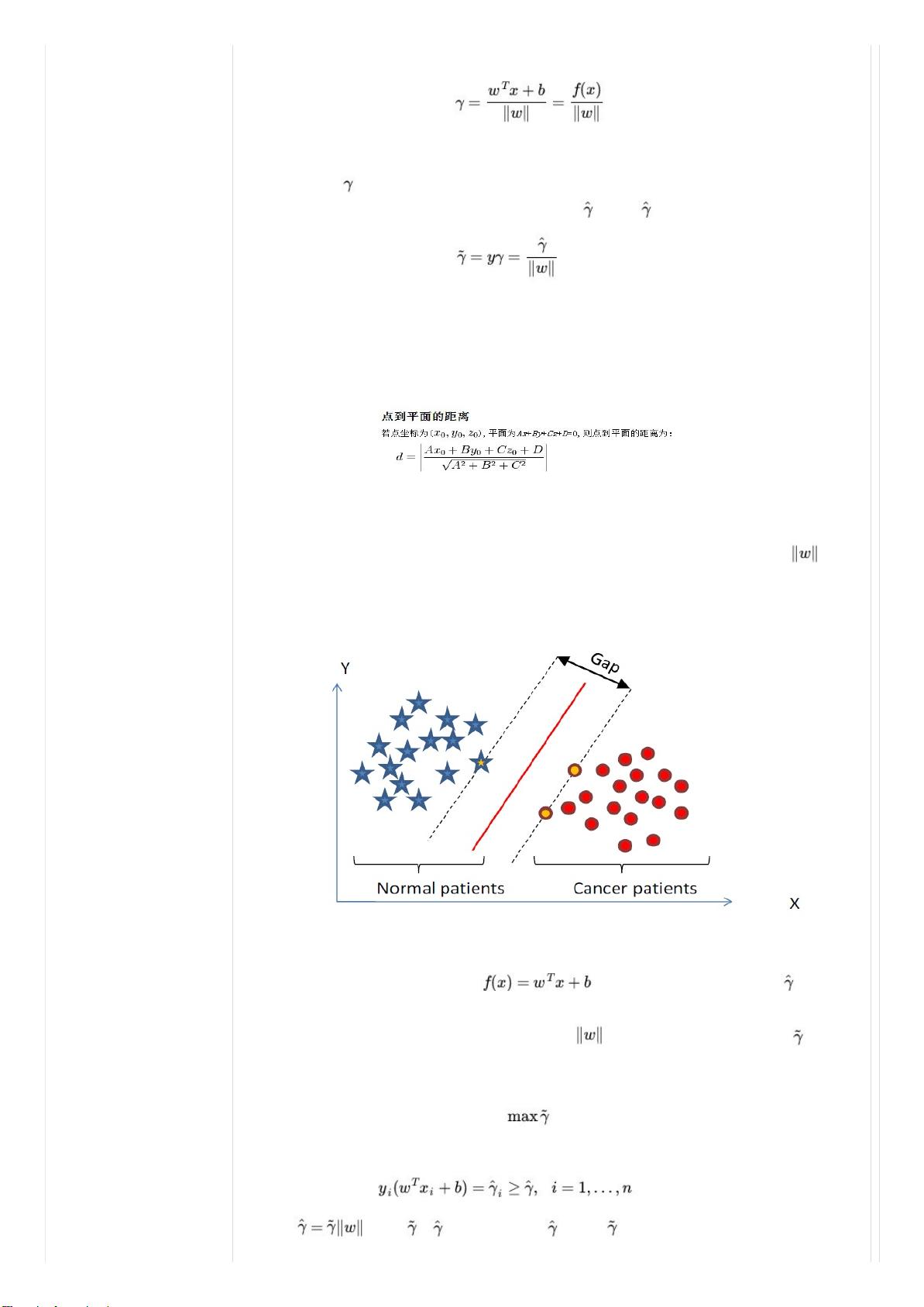

1.3、函数间隔Functional margin与几何间隔Geometrical margin

一般而言,一个点距离超平面的远近可以表示为分类预测的确信或准确程度。

在超平面w*x+b=0确定的情况下,|w*x+b|能够相对的表示点x到距离超平面的远近,而w*x+b的符号与

类标记y的符号是否一致表示分类是否正确,所以,可以用量y*(w*x+b)的正负性来判定或表示分类的正确

性和确信度。

于此,我们便引出了定义样本到分类间隔距离的函数间隔functional margin的概念。

1.3.1、函数间隔Functional margin

我们定义函数间隔functional margin 为:

接着,我们定义超平面(w,b)关于训练数据集T的函数间隔为超平面(w,b)关于T中所有样本点(xi,yi)的函数

间隔最小值,其中,x是特征,y是结果标签,i表示第i个样本,有:

= min i (i=1,...n)

然与此同时,问题就出来了。上述定义的函数间隔虽然可以表示分类预测的正确性和确信度,但在选择分类超

平面时,只有函数间隔还远远不够,因为如果成比例的改变w和b,如将他们改变为2w和2b,虽然此时超平面没有

改变,但函数间隔的值f(x)却变成了原来的4倍。

其实,我们可以对法向量w加些约束条件,使其表面上看起来规范化,如此,我们很快又将引出真正定义点到

超平面的距离--几何间隔geometrical margin的概念(很快你将看到,几何间隔就是函数间隔除以个||w||,即yf(x) /

||w||)。

1.3.2、点到超平面的距离定义:几何间隔Geometrical margin

在给出几何间隔的定义之前,咱们首先来看下,如上图所示,对于一个点 ,令其垂直投影到超平面上的对应

的为 ,由于 是垂直于超平面的一个向量, 为样本x到分类间隔的距离,我们有

(||w||表示的是范数,关于范数的概念参见这里)

展开

09、面试问答社区51nod

10、韩寒

11、曾经的叛逆与年少

12、老D之MongoDB源码分析

14、code4app:iOS代码示例

17、斯坦福机器学习公开课

18、TheItHome算法版块版主

19、Memory Model与并发编程

20、德问--编程是一种艺术创作

22、百度搜索研发部

23、淘宝搜索技术博客

24、interviewstreet

25、LeetCode

26、Team_Algorithms人人小组

文章存档

2013年09月 (2)

2013年08月 (2)

2013年06月 (1)

2013年03月 (1)

2012年12月 (1)

x

x

0

w

f( ) = 0

0

13-11-25

支持向量机通俗导论(理解SVM的三层境界) - 结构之法 算法之道 - 博客频道 - CSDN.NET

blog.csdn.net/v_july_v/article/details/7624837

5/36

又由于 是超平面上的点,满足 ,代入超平面的方程即可算出:

(有的书上会写成把||w|| 分开相除的形式,如本文参考文献及推荐阅读条目11,其中,||w||为w的二阶泛数)

不过这里的 是带符号的,我们需要的只是它的绝对值,因此类似地,也乘上对应的类别 即可,因此实际

上我们定义 几何间隔geometrical margin 为(注:别忘了,上面 的定义, =y(w Tx+b)=yf(x) ):

(代人相关式子可以得出:yi*(w/||w|| + b/||w||))

正如本文评论下读者popol1991留言:函数间隔y*(wx+b)=y*f(x)实际上就是|f(x)|,只是人为定义的一个间隔

度量;而几何间隔|f(x)|/||w||才是直观上的点到超平面距离。

想想二维空间里的点到直线公式:假设一条直线的方程为ax+by+c=0,点P的坐标是(x0,y0),则点到直线距离

为|ax0+by0+c|/sqrt(a^2+b^2)。如下图所示:

那么如果用向量表示,设w=(a,b),f(x)=wx+c,那么这个距离正是|f(p)|/||w||。

1.4、最大间隔分类器Maximum Margin Classifier的定义

于此,我们已经很明显的看出,函数间隔functional margin 和 几何间隔geometrical margin 相差一个 的缩

放因子。按照我们前面的分析,对一个数据点进行分类,当它的 margin 越大的时候,分类的 confidence 越大。

对于一个包含 个点的数据集,我们可以很自然地定义它的 margin 为所有这 个点的 margin 值中最小的那

个。于是,为了使得分类的 confidence 高,我们希望所选择的超平面hyper plane 能够最大化这个 margin 值。

通过上节,我们已经知道:

1、functional margin 明显是不太适合用来最大化的一个量,因为在 hyper plane 固定以后,我们可以等比例

地缩放 的长度和 的值,这样可以使得 的值任意大,亦即 functional margin 可以在

hyper plane 保持不变的情况下被取得任意大,

2、而 geometrical margin 则没有这个问题,因为除上了 这个分母,所以缩放 和 的时候 的值是

不会改变的,它只随着 hyper plane 的变动而变动,因此,这是更加合适的一个 margin 。

这样一来,我们的 maximum margin classifier 的目标函数可以定义为:

当然,还需要满足一些条件,根据 margin 的定义,我们有

其中 (等价于 = /||w||,故有稍后的 =1 时, = 1 / ||w||),处于方便推导和优化的目的,

x

0

f( ) = 0

x

0

y

n

n

w

b

w

b

剩余35页未读,继续阅读

luckystarxiaole

- 粉丝: 1

- 资源: 8

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

- 1

- 2

- 3

前往页