没有合适的资源?快使用搜索试试~ 我知道了~

chap-深度强化学习.pdf

温馨提示

试读

28页

由于卷积神经网络对图像处理拥有天然的优势,将卷积神经网络与强化学习结合处理图像数据的感知决策任务成了很多学者的研究方向。 深度Q网络是深度强化学习领域的开创性工作。它采用时间上相邻的4帧游戏画面作为原始图像输入,经过深度卷积神经网络和全连接神经网络,输出状态动作Q函数,实现了端到端的学习控制。

资源推荐

资源详情

资源评论

第 14 章 深度强化学习

除了试图直接去建立一个可以模拟成人大脑的程序之外,

为什么不试图建立一个可以模拟小孩大脑的程序呢?如果它接

受适当的教育,就会获得成人的大脑。

— 阿兰 · 图灵

在之前的章节中,我们主要关注于监督学习,而监督学习一般需要一定数

量的带标签的数据。在很多的应用场景中,通过人工标注的方式来给数据打标

签的方式往往行不通。比如我们通过监督学习来训练一个模型可以来自动下围

棋,就需要将当前棋盘的状态作为输入数据,其对应的最佳落子位置(动作)作

为标签。训练一个好的模型就需要收集大量的不同棋盘状态以及对应动作。这

种做法实践起来比较困难,一是对于每一种棋盘状态,即使是专家也很难给出

“正确”的动作,二是获取大量数据的成本往往比较高。对于下棋这类任务,虽

然我们很难知道每一步的“正确”动作,但是其最后的结果(即赢输)却很容

易判断。因此,如果可以通过大量的模拟数据,通过最后的结果(奖励)来倒

推每一步棋的好坏,从而学习出“最佳”的下棋策略,这就是强化学习。

强化学习(Reinforcement Learning,RL),也叫增强学习,是指一类从(与

环境)交互中不断学习的问题以及解决这类问题的方法。强化学习问题可以描

述为一个智能体从与环境的交互中不断学习以完成特定目标(比如取得最大奖

励值)。和深度学习类似,强化学习中的关键问题也是贡献度分配问题 [Minsky,

1963],每一个动作并不能直接得到监督信息,需要通过整个模型的最终监督信

息(奖励)得到,并且有一定的延时性。

贡献度分配问题即一个系统

中不同的组件(components)

对最终系统输出结果的贡献

或影响。

强化学习也是机器学习中的一个重要分支。强化学习和监督学习的不同在

于,强化学习问题不需要给出“正确”策略作为监督信息,只需要给出策略的

(延迟)回报,并通过调整策略来取得最大化的期望回报。

334 2019 年 4 月 6 日 第 14 章 深度强化学习

14.1 强化学习问题

强化学习广泛应用在很多领域,比如电子游戏、棋类游戏、迷宫类游戏、控

制系统、推荐等。这里我们介绍几个比较典型的强化学习例子。

14.1.1 典型例子

多臂赌博机问题 给定 K 个赌博机,拉动每个赌博机的拉杆(arm),赌博机会

按照一个事先设定的概率掉出一块钱或不掉钱。每个赌博机掉钱的概率不一样。

多臂赌博机问题(multi-armed bandit problem)是指,给定有限的机会次数 T ,

如何玩这些赌博机才能使得期望累积收益最大化。多臂赌博机问题在广告推荐、

也称为 K 臂赌博机问题(K-

armed bandit problem)。

投资组合等领域有着非常重要的应用。

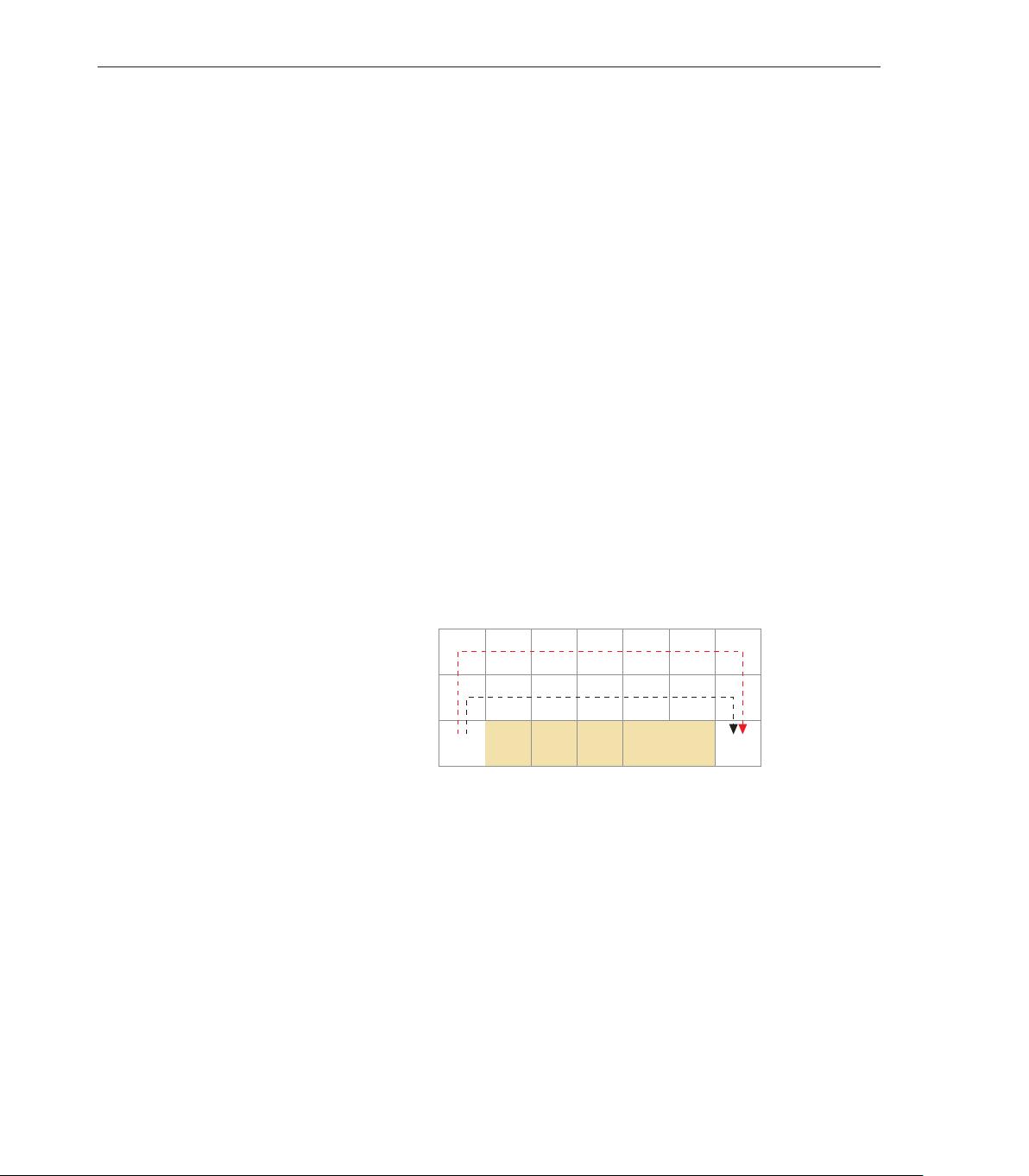

悬崖行走问题 在一个网格世界(grid world)中,每个格子表示一个状态。如14.1所

示的一个网格世界,每个状态为 (i, j), 1 ≤ i ≤ 7, 1 ≤ j ≤ 3,其中格子 (2, 1) 到

(6, 1) 是悬崖(cliff)。有一个醉汉,从左下角的开始位置 S,走到右下角的目标

位置 E。如果走到悬崖,醉汉会跌落悬崖并死去。醉汉可以选择行走的路线,即

在每个状态时,选择行走的方向:上下左右。动作空间 A = {↑, ↓, ←, →}。但每

走一步,都有一定的概率滑落到周围其他的格子。醉汉的目标是如何安全地到

达目标位置。

S

E

1

2

3

1 2

3

4

5 6

7

图 14.1 醉汉悬崖问题

14.1.2 强化学习定义

现在我们描述下强化学习的任务定义。在强化学习中,有两个可以进行交

互的对象:智能体和环境。

• 智能体(agent)可以感知外界环境的状态(state)和反馈的奖励(reward),

并进行学习和决策。

智能体的决策功能是指根据外界环境的状态来做出不同的动作(action),

而学习功能是指根据外界环境的奖励来调整策略。

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

14.1 强化学习问题 2019 年 4 月 6 日 335

• 环境(environment)是智能体外部的所有事物,并受智能体动作的影响

而改变其状态,并反馈给智能体相应的奖励。

在强化学习中的基本要素包括:

• 状态 s 是对环境的描述,可以是离散的或连续的,其状态空间为 S;

• 动作 a 是对智能体行为的描述,可以是离散的或连续的,其动作空间为 A;

• 策略 π(a|s) 是智能体根据环境状态 s 来决定下一步的动作 a 的函数;

• 状态转移概率 p(s

′

|s, a) 是在智能体根据当前状态 s 做出一个动作 a 之后,

环境在下一个时刻转变为状态 s

′

的概率;

• 即时奖励 r(s, a, s

′

) 是一个标量函数,即智能体根据当前状态 s 做出动作 a

之后,环境会反馈给智能体一个奖励,这个奖励也经常和下一个时刻的状

态 s

′

有关。

策略 智能体的

策略

(

policy

)就是智能体如何根据环境状态

s

来决定下一步的动

作a,通常可以分为确定性策略(Deterministic Policy)和随机性策略(Stochastic

Policy)两组。

确定性策略是从状态空间到动作空间的映射函数 π : S → A。随机性策略

表示在给定环境状态时,智能体选择某个动作的概率分布。

π(a|s) , p(a|s), (14.1)

a∈A

π(a|s) = 1. (14.2)

通常情况下,强化学习一般使用随机性的策略。随机性的策略可以有很多

优点。比如在学习时可以通过引入一定随机性更好地探索环境。二是使得策略

参考利用-探索策略。

更加地多样性。比如在围棋中,确定性策略总是会在同一个位置上下棋,会导

致你的策略很容易被对手预测。

14.1.3 马尔可夫决策过程

为了简单起见,我们将智能体与环境的交互看作是离散的时间序列。图14.2给

出了智能体与环境的交互。

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

336 2019 年 4 月 6 日 第 14 章 深度强化学习

智能体

环境

动作 a

t

状态 s

t

奖励 r

t+1

图 14.2 智能体与环境的交互

智能体从感知到的初始环境 s

0

开始,然后决定做一个相应的动作 a

0

,环境

相应地发生改变到新的状态 s

1

,并反馈给智能体一个即时奖励 r

1

,然后智能体

又根据状态 s

1

做一个动作 a

1

,环境相应改变为 s

2

,并反馈奖励 r

2

。这样的交互

可以一直进行下去。

s

0

, a

0

, s

1

, r

1

, a

1

, · · · , s

t−1

, r

t−1

, a

t−1

, s

t

, r

t

, · · · , (14.3)

其中 r

t

= r(s

t−1

, a

t−1

, s

t

) 是第 t 时刻的即时奖励。

智能体与环境的交互的过程可以看作是一个马尔可夫决策过程。

马尔可夫过程(Markov Process)是具有马尔可夫性的随机变量序列s

0

, s

1

, · · · ,

s

t

∈ S,其下一个时刻的状态 s

t+1

只取决于当前状态 s

t

,

p(s

t+1

|s

t

, · · · , s

0

) = p(s

t+1

|s

t

), (14.4)

其中 p(s

t+1

|s

t

) 称为状态转移概率,

s

t+1

∈S

p(s

t+1

|s

t

) = 1。

马 尔 可 夫 过 程 参 见

第D.3.1节。

马尔可夫决策过程(Markov Decision Process,MDP)在马尔可夫过程中

加入一个额外的变量:动作 a,即下一个时刻的状态 s

t+1

和当前时刻的状态 s

t

以及动作 a

t

相关,

p(s

t+1

|s

t

, a

t

, · · · , s

0

, a

0

) = p(s

t+1

|s

t

, a

t

), (14.5)

其中 p(s

t+1

|s

t

, a

t

) 为状态转移概率。

给定策略 π(a|s),马尔可夫决策过程的一个轨迹(trajectory)

τ = s

0

, a

0

, s

1

, r

1

, a

1

, · · · , s

T −1

, a

T −1

, s

T

, r

T

的概率为

p(τ) = p(s

0

, a

0

, s

1

, a

1

, · · · ), (14.6)

= p(s

0

)

T −1

t=0

π(a

t

|s

t

)p(s

t+1

|s

t

, a

t

). (14.7)

邱锡鹏:《神经网络与深度学习》 https://nndl.github.io/

剩余27页未读,继续阅读

资源评论

陈游泳2023-07-26这本《chap-深度强化学习.pdf》用清晰简明的表达,使得复杂的概念易于理解,对于初学者也很友好。

陈游泳2023-07-26这本《chap-深度强化学习.pdf》用清晰简明的表达,使得复杂的概念易于理解,对于初学者也很友好。 VashtaNerada2023-07-26这本《chap-深度强化学习.pdf》循序渐进地讲解了深度强化学习的基础知识,适合初学者入门。

VashtaNerada2023-07-26这本《chap-深度强化学习.pdf》循序渐进地讲解了深度强化学习的基础知识,适合初学者入门。 daidaiyijiu2023-07-26这本《chap-深度强化学习.pdf》是非常值得一读的,详尽地介绍了深度强化学习的核心概念和应用案例。

daidaiyijiu2023-07-26这本《chap-深度强化学习.pdf》是非常值得一读的,详尽地介绍了深度强化学习的核心概念和应用案例。 书看不完了2023-07-26这本《chap-深度强化学习.pdf》讲解深度强化学习的角度独特,对于学习者来说十分实用。

书看不完了2023-07-26这本《chap-深度强化学习.pdf》讲解深度强化学习的角度独特,对于学习者来说十分实用。 学习呀三木2023-07-26这本《chap-深度强化学习.pdf》以通俗易懂的方式,给出了很多实践建议,对于想要实际运用深度强化学习的人来说非常实用。

学习呀三木2023-07-26这本《chap-深度强化学习.pdf》以通俗易懂的方式,给出了很多实践建议,对于想要实际运用深度强化学习的人来说非常实用。

白杨树~

- 粉丝: 51

- 资源: 21

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功