没有合适的资源?快使用搜索试试~ 我知道了~

资源详情

资源评论

资源推荐

作者

小 c

爬虫笔记

urllib_库的使用

urllib_基本使用

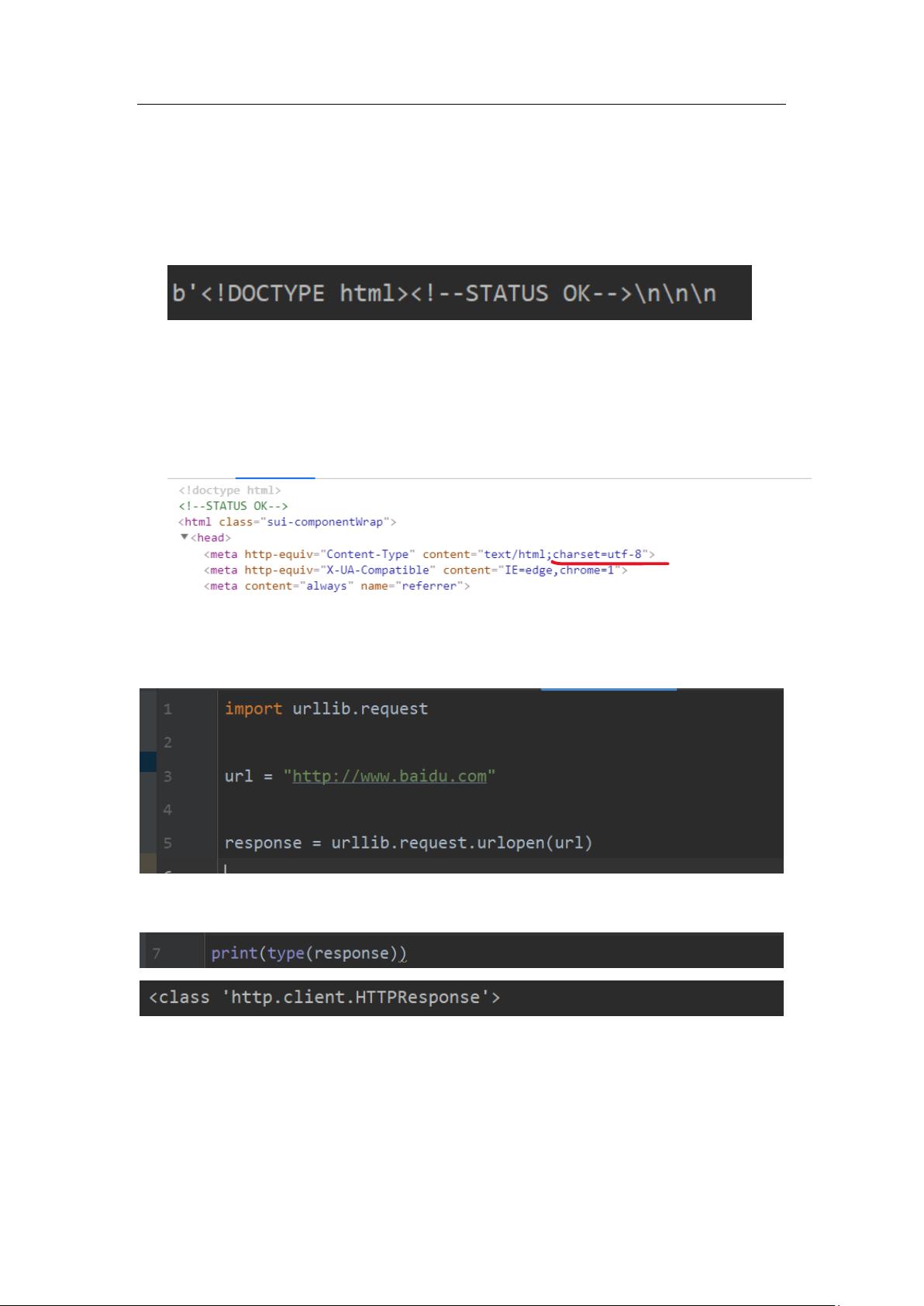

获取百度首页的源码

总结知识点:

1. url 表示定义所要访问的网络页面的网络地址

2. 在进行网络爬虫时,需要在连接网络的前提下进行。

作者

小 c

3. url 通常定义目标地址的变量名,response 通常定义服务器返回响应的变量名,content

通常定义爬到的网络源码

4. 在不进行解码的时候,read()方法返回的是 2 进制数据(2 进制数据标记源码首行有 b’)

5. 在对二进制进行解码时,可以使用.decode(“解码格式”) 进行解码,虽然说目前网络绝大

部分网络都采用了 utf -8 编码,但也有小部分别的,可以通过网页 F12 快捷键找到以下

代码可知道该网站使用了什么样的编码语言,从而对应解码。

urllib 的一个属性和六个方法

➢ 一个属性 :响应的类型:HTTPResponse

➢ 六个方法:read()/read(n), readline(),readlines(),geturl(),getcode(),getheaders()

1. read() / read(n): 两个重载的方法

1.1 read():一个字节一个字节的爬取,直到末尾结束

作者

小 c

1.2 read(n):只爬取 n 个字节

2. readline():只爬取一行

3. readlines():一行一行的爬取,直到末尾结束

4. geturl():获取响应的 url

作者

小 c

5. getcode():获取响应的状态码,从而判断自己的代码逻辑是否有误,正常情况下:

200

6. getheaders():获取响应头的状态信息

urllib_下载

1. 下载网页

2. 下载照片

地址查找:

作者

小 c

3. 下载视频

如何查找地址:

剩余62页未读,继续阅读

c66666688888888

- 粉丝: 0

- 资源: 4

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论0