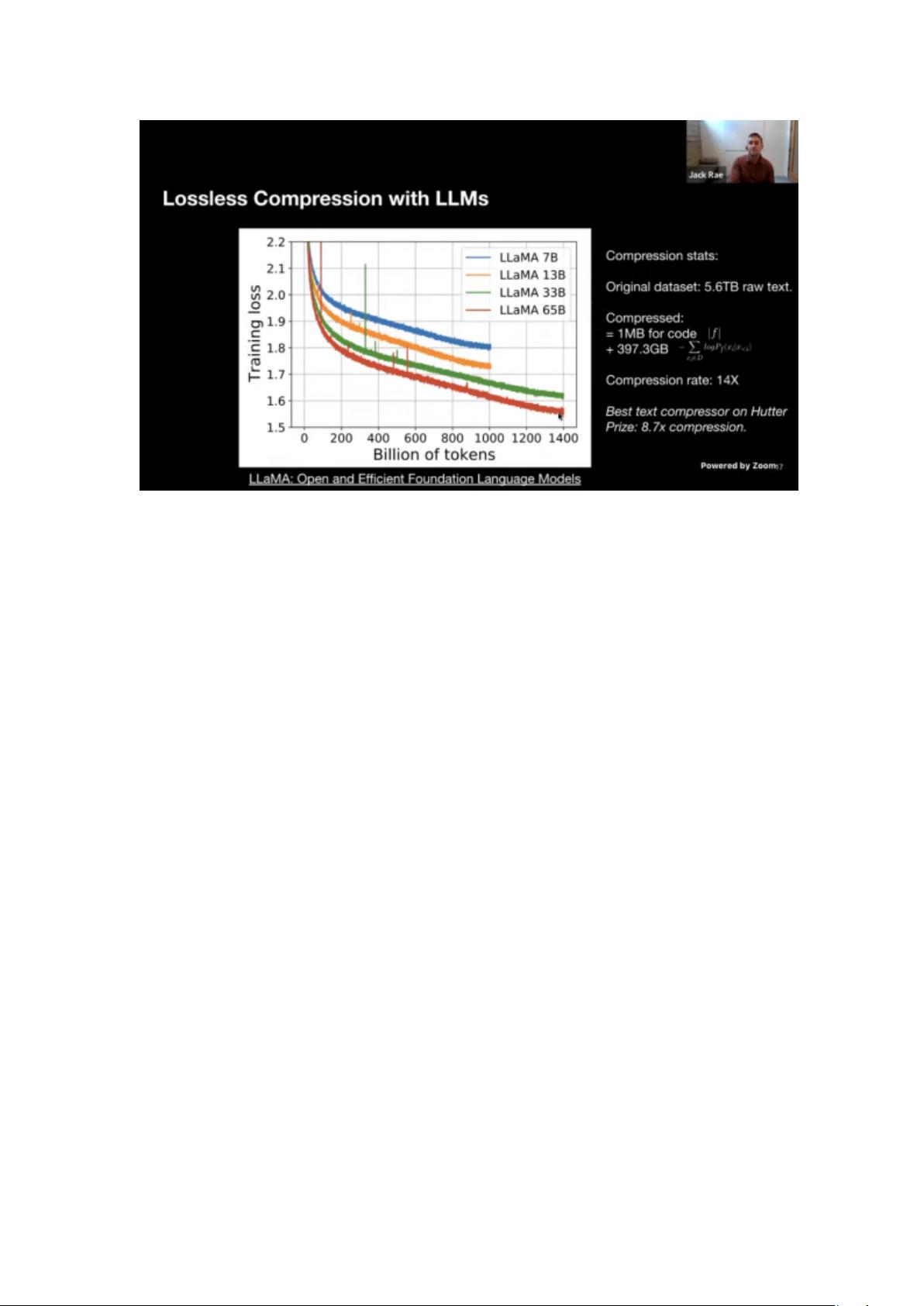

2 月 28 日,OpenAI 的核心研发人员 Jack Rae 在参加 Stanford MLSys

Seminar 的访谈时进行了一个名为 Compression for AGI 的 主 题 分 享 ,

其核心观点为:AGI 基础模型的目标是实现对有效信息最大限度的无损压

缩。并同时给出了为什么这个目标是合理的逻辑分析,以及 OpenAI 是

如何在这个目标下开展工作的行动原则。

我们认为这个不到 1 小时的 talk 是从去年 11 月 ChatGPT 出现以来,

让人能够最大限度理解 OpenAI 工作思路的一个纲领性内容,在深入了

解这个 talk 后,我们会对 OpenAI 的历史行为产生全新的认知,甚至

有可能对其未来的动作进行某种程度的预测。

目前这个 talk 在 YouTube 上的播放量不高(截至 3 月 25 日的播放量

是 4.5k),在国内的讨论更是寥寥无几,OneMoreAI 的学习小组对此

内容进行了深入的学习讨论后形成了一些有趣的想法,在此与各位分享。

一、来自 OpenAI 的观点

让我们先来回顾一下这次 talk 的主要内容,在回顾之前我们介绍一下分

享者:

Jack Rae 是 OpenAI 的团队负责人,主要研究大型语言模型和远程记忆。

此前,他在 DeepMind 工作了 8 年,领导大型语言模型(LLM)研究