没有合适的资源?快使用搜索试试~ 我知道了~

Scikit-learn 使用手册中文版(官方手册中文版)

温馨提示

试读

53页

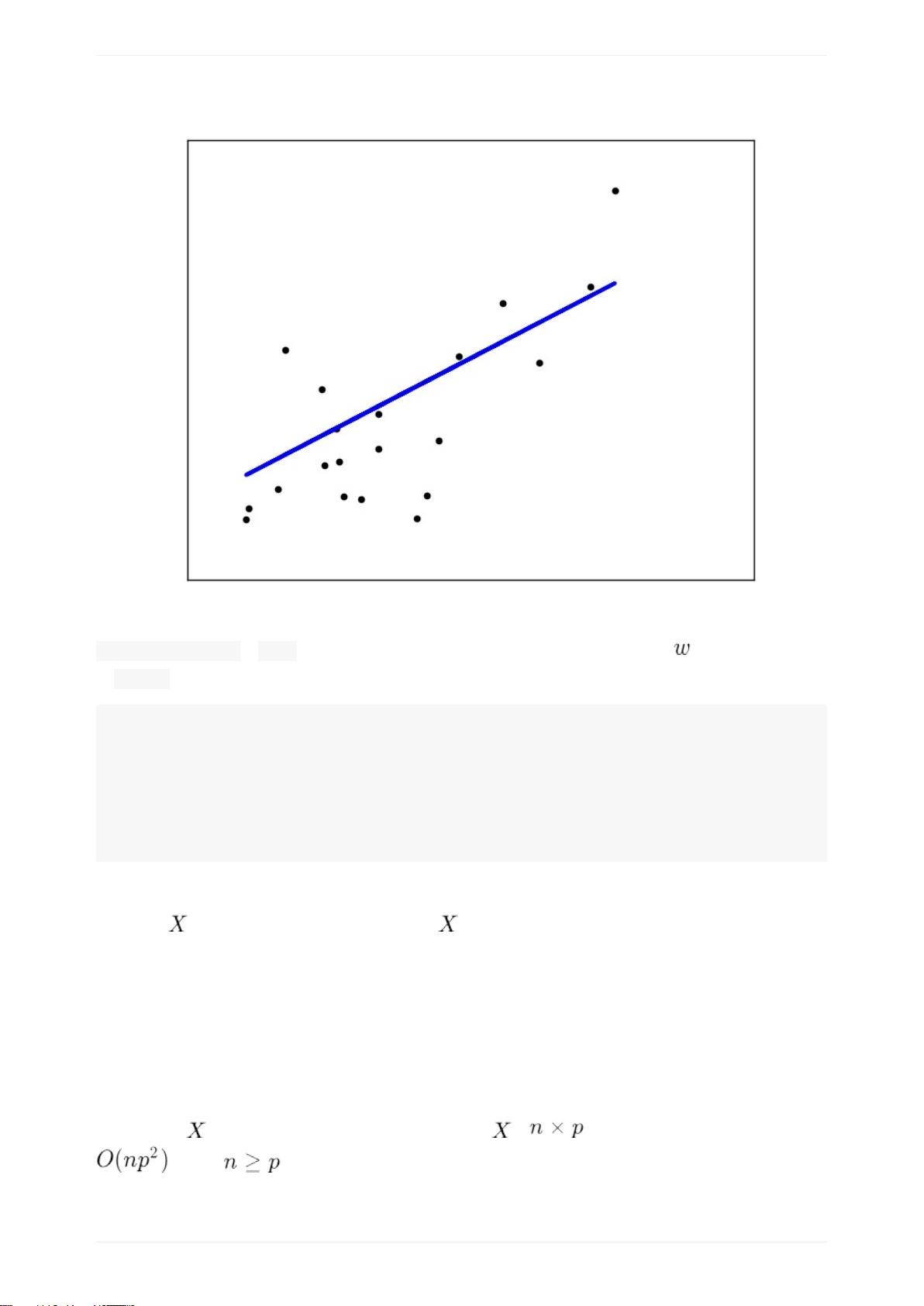

Scikit-learn 使用手册中文版 有监督学习 广义线性模型 11.广义线性模型 英文原文 以下介绍的方法均是用于求解回归问题,其目标值预计是输入变量的一个线性组合。写成数 学语言为:假设!是预测值,则有 y(,x)=0+u1x1+.p 在本节中’称向量=(1,…,n)为ce-·、%ma%W%nma%为 intercept 若要将通用的线性模型用于分类问题,可参见 Logistic回归 1.11普通最小二乘法 Linear使用系数=(1,…,mp)拟合一个线性模型。拟合的目标是要将线性 逼近预測值(XU)和数据集中观察到的值(y)两者之差的平方和尽量降到最小。写成数学 公式即是要解决以下形式的问题 IXw-yl2 广义线性模型 LinearRegression的fit方法接受数组Ⅹ和y作为输入’将线性模型的乐数ω存在成员变

资源推荐

资源详情

资源评论

Thisbookistranslatedfromofficialuserguideofscikit-learn.

绪言

2

有监督学习

3

LinearRegression的fit方法接受数组X和y作为输入,将线性模型的系数 存在成员变

量 coef_中:

>>>fromsklearnimportlinear_model

>>>clf=linear_model.LinearRegression()

>>>clf.fit([[0,0],[1,1],[2,2]],[0,1,2])

LinearRegression(copy_X=True,fit_intercept=True,n_jobs=1,normalize=False)

>>>clf.coef_

array([0.5,0.5])

需要注意的是,普通最小二乘法的系数预测取决于模型中各个项的独立性。假设各个项相

关,矩阵 的列总体呈现出线性相关,那么 就会很接近奇异矩阵,其结果就是经过最小二

乘得到的预测值会对原始数据中的随机误差高度敏感,从而每次预测都会产生比较大的方

差。这种状况称为重共线性。例如,在数据未经实验设计就进行收集时就会发生重共线性。

线性回归的例子

1.1.1.1普通最小二乘法的复杂度

此方法使用 的奇异值分解来求解最小二乘。如果 是 矩阵,则算法的复杂度为

,假设 。

广义线性模型

5

剩余52页未读,继续阅读

资源评论

Elijah_Yi2017-06-30坑到死 就几页

Elijah_Yi2017-06-30坑到死 就几页 rainblue2018-02-22这应该不是完整的把

rainblue2018-02-22这应该不是完整的把 qq_378049682018-10-26还是很谢谢分享的

qq_378049682018-10-26还是很谢谢分享的 hame02452018-08-10谢谢分享!!!!

hame02452018-08-10谢谢分享!!!! bickys2018-05-03那么贵,而且才翻译一部分。不值得

bickys2018-05-03那么贵,而且才翻译一部分。不值得

noplacelikehome

- 粉丝: 1

- 资源: 1

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

前往需求广场,查看用户热搜

前往需求广场,查看用户热搜安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功