信息论

实验一 计算信息熵及其互信息

实验者:

班级:学号:

2009 年 10 月 20 日

实验一 计算信息熵及其互信息

一.实验目的

1.理解信源的概念。

2.了解如何获得图片信息。

3.学会计算图片信息熵。

4.学会计算两个图片信息的互信息。

二.实验原理

1.信息论是运用概率论与数理统计的方法研究信息、信息熵、通信系统、

数据传输、密码学、数据压缩等问题的应用数学学科。

信息论将信息的传递作为一种统计现象来考虑,给出了估算通信信道容量

的方法。信息传输和信息压缩是信息论研究中的两大领域。这两个方面又由信

息传输定理、信源-信道隔离定理相互联系。

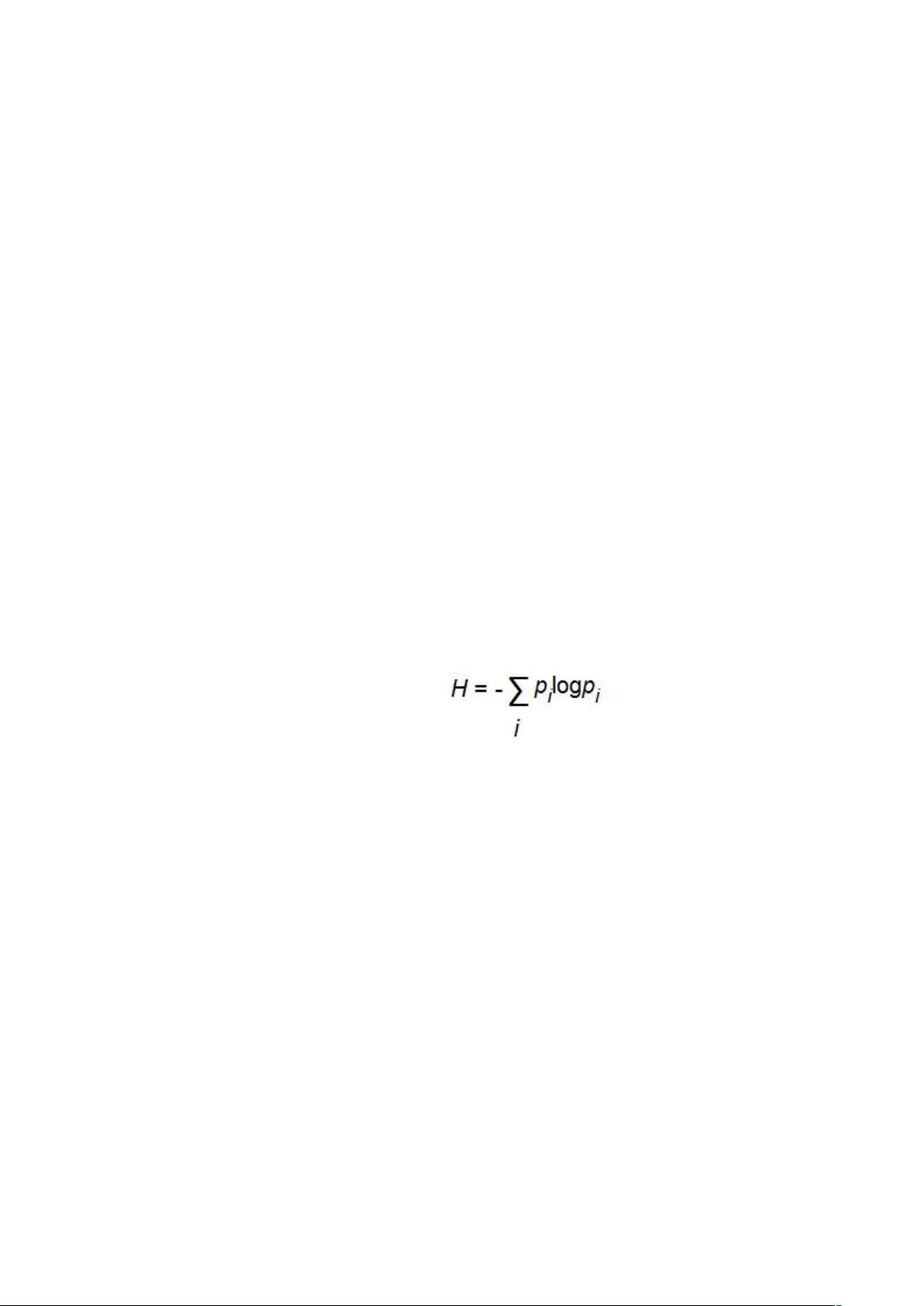

香农(Claude Shannon)被称为是“信息论之父”。人们通常将香农于 1948 年 10

月发表于《贝尔系统技术学报》上的论文《A Mathematical Theory of

Communication》(通信的数学理论)作为现代信息论研究的开端。这一文章部

分基于哈里·奈奎斯特和拉尔夫·哈特利先前的成果。在该文中,香农给出了信

息熵(以下简称为“熵”)的定义:

这一定义可以用来推算传递经二进制编码后的原信息所需的信道带宽。熵

度量的是消息中所含的信息量,其中去除了由消息的固有结构所决定的部分,

比如,语言结构的冗余性以及语言中字母、词的使用频度等统计特性。

信息论中熵的概念与物理学中的热力学熵有着紧密的联系。玻尔兹曼与吉

布斯在统计物理学中对熵做了很多的工作。信息论中的熵也正是受之启发。

互信息(Mutual Information)是另一有用的信息度量,它是指两个事件集合之

间的相关性。两个事件 X 和 Y 的互信息定义为:

I(X,Y) = H(X) + H(Y) - H(X,Y)

其中 H(X,Y) 是联合熵(Joint Entropy),其定义为:

评论7